愛因斯坦對於宇宙的理解錯了嗎?

愛因斯坦的廣義相對論重新改寫我們對於時間、空間、與質量的認知,也開啟我們對廣大宇宙研究的大門。

在宇宙物理學如同大霹靂快速發展之時,我們也發現愛因斯坦最早提出的宇宙模型,可能並不完全正確。

正確來說,我們發現我們過去對宇宙的理解,可能真的太少了。少到我們至今所觀測到的所有物質,可能仍不到整個宇宙組成的百分之五。並不是說這些能量或物質距離我們太過遙遠,而是他們可能就在附近,而我們卻全然不了解它。

其中佔了將近宇宙組成七成的「暗能量」,到底是什麼來頭?我們能徹底了解它,同時能為我們宇宙的存在,提供一個正確的解釋模型嗎?又或者我們能掌握它,來改變宇宙的未來嗎?

暗能量(dark energy)到底是什麼?這聽起來有夠中二的名字,難道是暗影大人的新能力嗎?

其實暗能量的「暗」,指的是我們看不到也摸不到,用上各種波段的電磁波都察覺不到,甚至現今沒有任何儀器能偵測到它的存在。因為我們無法感受到它、不知道他們的型態,所以稱為暗能量。也就是說,如果暗影大人或是哪個最終 BOSS 的絕招是「暗能量波動」,當巨大的能量朝你襲來,不用擔心,站在原地就好,因為它只會穿過你的身體,打不中你的。同樣的,你可能聽過的「暗物質」,指的也是我們無法探知的未知物質。也就是說,暗物質並不是指某種特定物質叫做暗物質,任何我們現在還無法探測到的,都可能是暗物質的其中一種。題外話,近年某些暗物質面紗底下的容貌,已經逐漸能被我們窺見,例如微中子。這部分,之後我們介紹暗物質的節目中,再來好好討論,今天先來和大家聊聊佔了宇宙質能 7 成的暗能量。

矛盾大對決來了,既然我們摸不到,也看不到,我們怎麼知道暗能量存在,還是僅存在我們的中二想像中呢?我們得將時間回推到最早認為宇宙中有未知能量存在的那個人,他不是別人,就是鼎鼎大名的愛因斯坦。

1916 年愛因斯坦推導出廣義相對論,解釋物質和能量如何影響時空的彎曲和演化。愛因斯坦當時認為,宇宙應該是靜態的,但是若宇宙中只有物質,宇宙應該會受重力吸引而塌縮,因此需要與反向的能量來平衡重力,這股能量平均地存在在空間當中。愛因斯坦當時引入了宇宙常數 Λ 來平衡他的靜態宇宙模型,而直到非常近期的 1998 年,暗能量 (dark energy) 這個詞才由物理學家麥可.特納提出。

在愛因斯坦之後,著名宇宙學家傅里德曼提出不同看法,他認為宇宙不一定是平衡的,也可能正在收縮或膨脹當中,並根據廣義相對論推導出 Fridemann 方程式,關於 Fridemann 方程式的故事,先前我們有好好介紹過。

暗能量不只存在於理論上的預測,同時期天文學家開始發現我們熟知的銀河系,並無法代表整個宇宙,原來夜空中很多像星雲的天體,其實是遙遠的星系!宇宙遠比以前認為得大的太多了!1929 年,哈伯進一步發現,這些星系竟然正在遠離我們而去,而且距離我們愈遠的星系,遠離的速度就愈快!宇宙竟然真的是以地球為中心,而地球利用強大的排斥力,將其他星系用力向外推開嗎?當然不是,想像一下,宇宙就像一個葡萄乾麵包,上面布滿的葡萄乾就是各種天體,當麵包發酵膨脹時,不論站在哪顆葡萄乾的視角,所有天體的距離都是互相拉遠,而且距離愈遠的天體,彼此遠離的速度就愈快。

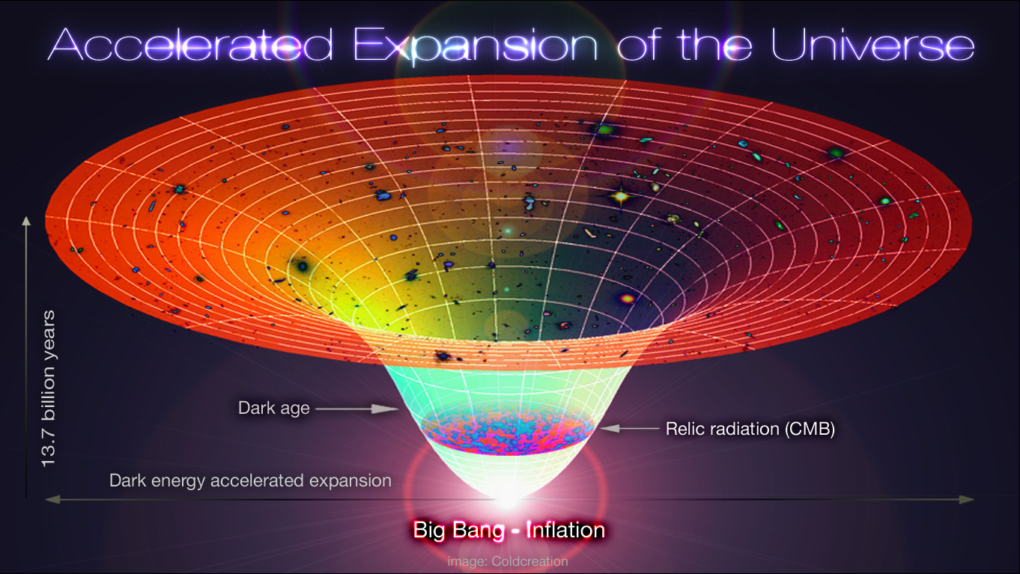

也就是說,哈伯觀測到的結果顯示整個宇宙正在膨脹。但還有一個問題,就是這個宇宙的膨脹速度,是隨著時間經過越來越快的加速膨脹,還是膨脹速度正隨著時間在趨緩的減速膨脹呢?為什麼這個問題很重要?因為如果是減速膨脹,靠現有的重力理論就可以解釋,宇宙中天體所提供的重力,正在使宇宙減速膨脹,甚至宇宙的結局可能會是宇宙重新塌縮。但如果宇宙正在加速膨脹,那麼只考慮重力就不夠了,為了抵抗向內塌縮的重力,勢必要有一股力量要將宇宙向外加速推開。這時,就需要加入暗能量的存在了。

宇宙真的正在加速膨脹?

為了確認宇宙正在減速或加速膨脹,好推算暗能量是否存在,科學家再次將目光投向宇宙深處。隨著觀測技術愈來愈進步,天文學家可以透過不同方式,觀測更早期的宇宙。

愈遠的天體發出的光,需要經過愈長的時間才能傳到地球。假設我們觀察離地球1億光年遠的星球,由於我們看到的影像是從星球出發後,經過 1 億年後才到達地球,因此在望遠鏡中看到的,其實是該星球一億年前的樣子。只要利用這點,如果我們將望遠鏡頭對向更加遙遠的宇宙深處,就能看到更早期的宇宙樣貌,幫助我們了解宇宙過去的樣子。

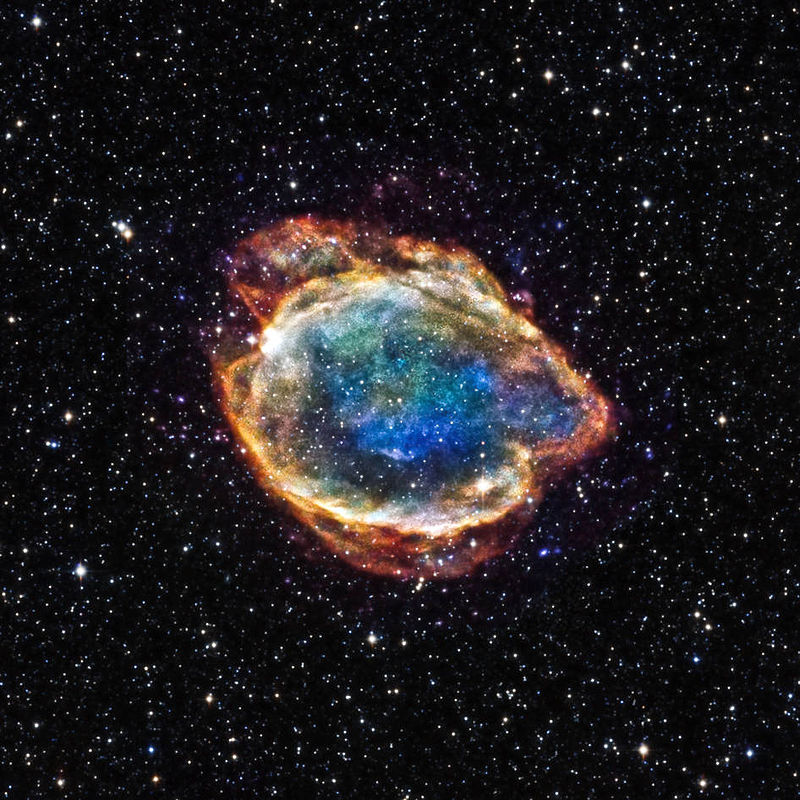

科學家主要透過三種方法,分別用來觀測晚期、中期、到早期的宇宙。第一種方法是觀測 Ia 型超新星爆炸,它指的是當一顆緻密白矮星到了生命末期,吸收大量鄰近伴星的氣體,使得內部重力超過某個極限,引發失控的核融合而形成的超新星爆炸。這個爆炸會在瞬間釋放出許多能量,亮度甚至可以媲美整個星系,因此即使是很遙遠的超新星也可以被地球觀測到。最受天文學家關注的是,因為每個 Ia 型超新星爆炸時產生的尖峰光度都相同,可以直接作為觀測或是亮度的比對參考點,又稱為標準燭光。當它離我們愈遠亮度就愈小,只要觀測亮度就可以得知它離我們的距離。

接著,透過光譜分析,我們還能得到這個超新星遠離我的的速度。這就像是救護車在靠近和遠離我們的時候,警笛的聲音頻率會因為我們和救護車相對速度的改變而產生變化,同樣的道理放在電磁波上,當超新星遠離我們,電磁波頻譜的頻率會下降,我們稱為頻譜「紅移」。最後,只要我們同時觀測好幾顆超新星,並且量測每一顆的距離和遠離我們的速度,看看是不是真的離我們越遠的超新星離開的速度越快,就可以知道宇宙正在加速或是減速膨脹。

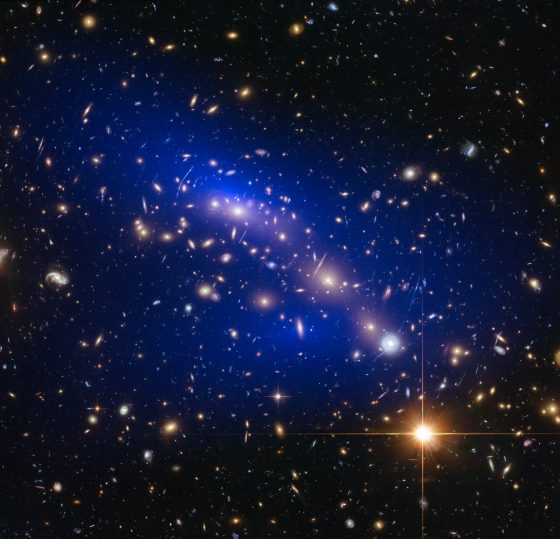

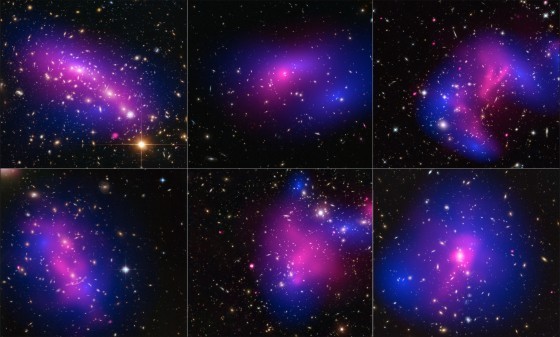

第二種方法是觀測宇宙大尺度結構,宇宙中星系的分佈其實是不均勻的,有些地方有星系團,也有一些地方是孔洞,整個宇宙就像是網子一樣。這是因為宇宙在形成星系時,向內的重力以及向外的氣體與光壓力會彼此抗衡,就像我們在擠壓彈力球一樣,向內壓時內部壓力會增強,導致物質向外拋射,壓力減弱後又會停止拋射,這樣來回震盪的過程,就在宇宙中形成一個個震波漣漪,稱為重子聲學振盪(BAO,baryon acoustic oscillations)。有趣的是,當好幾個地方都在震盪,就會產生類似好幾個水波互相撞在一起的干涉現象。而這個宇宙規模的超大水波槽中,波腹部份聚集較多物質就會形成星系團,波節部份不足以形成星系就形成孔洞,是不是覺得我們的宇宙就像是一鍋湯,而我們只是裡面毫不起眼的一顆胡椒粒呢?不過即使是連一粒胡椒都不如的我們,透過觀測宇宙星系分布並透過理論計算,人類科學家還是可以得知這些結構的大小,並且推知這些結構上的星系距離我們多遠,最後再搭配紅移光譜,一樣可以算出宇宙膨脹的速度。今年七月升空,11 月 8 號從太空傳回第一張照片的歐幾里得太空望遠鏡,它的其中一項任務,就是專門觀測重子聲學振盪,來研究宇宙大尺度結構。歐幾里得太空望遠鏡有望帶給我們對宇宙的全新認知,關於這一部分,我們很快會再來深入介紹。

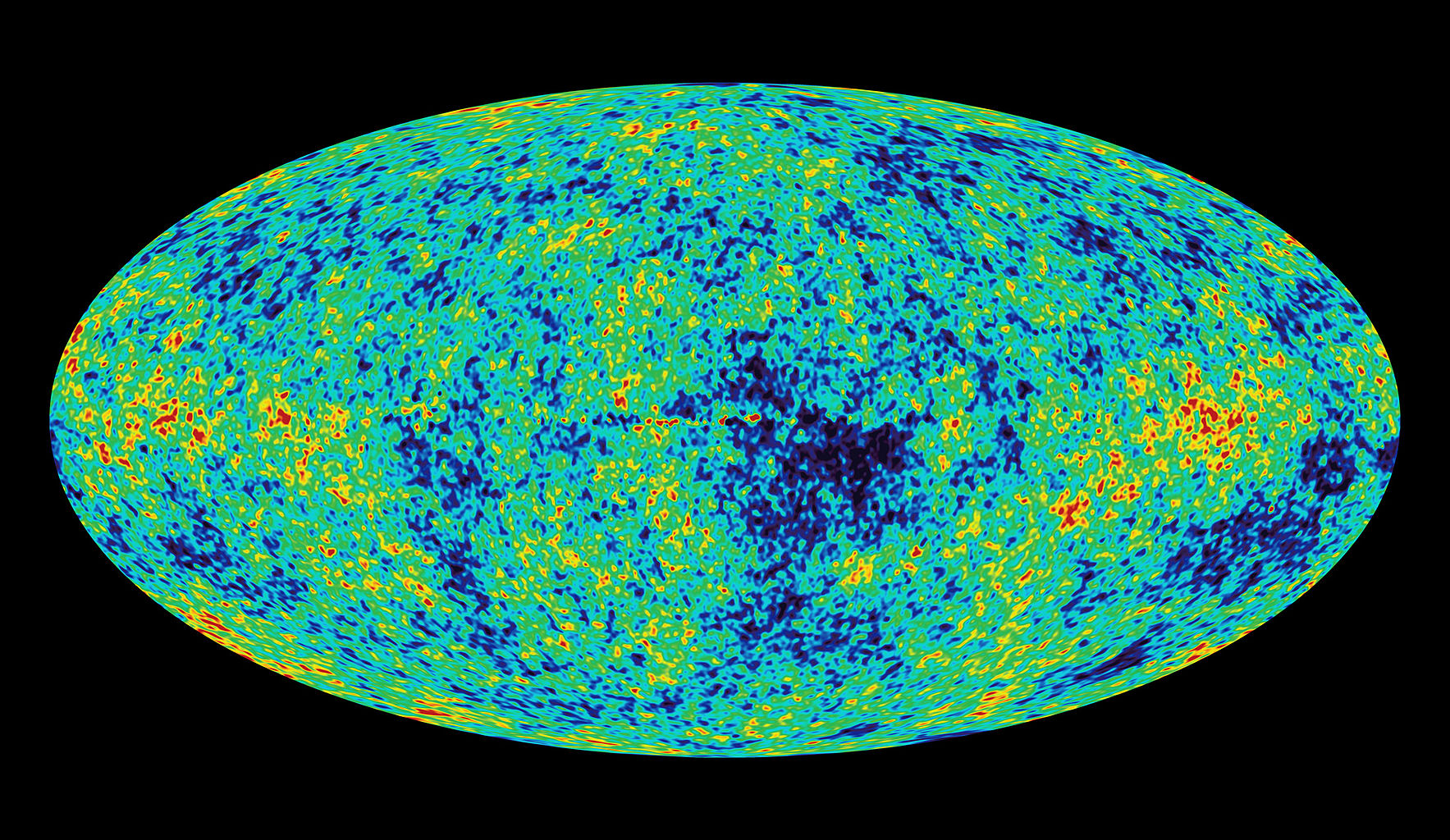

第三種方法是透過觀測宇宙微波背景輻射,它是宇宙的第一道曙光,在此以前,宇宙能量很高,光和電漿相互作用,不會走直線。但是到了宇宙三十八萬歲時,宇宙已經冷卻到足以讓電子與原子核結合,宇宙終於變得乾淨了,光也終於可以走直線。而三十八萬歲時的早期宇宙的畫面,至今仍不斷經過遙遙 137 億年的時間抵達地球,被我們觀測到,稱為宇宙微波背景輻射。有趣的是,根據這些照片,我們能發現早在 137 億年前,宇宙各處就不是均勻的。透過分析這些微波的分布,科學家能計算出當時宇宙的組成成份。這時我們發現,目前的已知物質,也就是元素週期表上看得到的原子,只佔所有能量的 4.93%,而看不到的暗物質,佔 27.17%,那還有 67.9%,將近七成的組成分是什麼?科學家認為就是暗能量。

哇!暗能量佔的比例這麼高?那我們未來有機會從空間中汲取無限的能量嗎?先不要想的這麼美,其實暗能量在宇宙中的密度很低,依照質能等價公式,質量跟能量是可以互相換算的。換算下來暗能量每立方公分只有 10 的負 24 次方公克,相比之下,水的密度是立方公分 1 公克!真的微乎其微。之所以暗能量在宇宙中佔的能量比這麼大,是因為它均勻的存在在廣大無垠的宇宙中,不像一般的物質,只集中在一些星系和星體中。

現在我們知道暗能量存在,而且量也不少,但回到最關鍵問題,這些暗能量到底是怎麼來的呢?

宇宙與暗能量的未來

科學家普遍認為暗能量是來自「真空能量」,根據量子力學,我們過往認為的真空,其實會不斷短暫的出現粒子並消失。而這些量子漲落便會產生真空能量。雖然這聽起來很玄,但各位看完我們的影片並按下訂閱之後,這些訂閱數就一定會是真的。都看到影片最後一段了,就拜託大家再多動一下手指吧!

而量子力學除了能在真空中產生真空能量以外,這個過程甚至可能幫助我們開啟蟲洞!關於真空能量與時空旅行的關係,可以參考我們的這一集哦(閃電俠)。

為了重新認識我們的宇宙,科學家此時再次拿出了宇宙常數 Λ 和 Fridemann 方程式,建立了一個可以完美解釋前面三種觀測結果的模型-ΛCDM 模型。

ΛCDM 是近代在解釋宇宙微波背景輻射、宇宙大爆炸時,最常被使用的理論。目前對於宇宙歷史與加速膨脹的圖像,也都基於此模型。

不過 ΛCDM 理論仍有兩個致命的問題待解決。第一個是理論中的宇宙常數 Λ,應該要與位置、時間無關,是一個不隨時間變化的常數。然而針對觀測早期和晚期宇宙所計算出來的宇宙常數數值卻不一樣,要如何解釋這個觀測差異?第二個問題是,假設暗能量是真空中的量子漲落所造成,依此推算出的宇宙常數數值,還跟觀測差了 120 個數量級!也就是 10 後面有 120 個零,整個宇宙中的原子數量也才 82 個數量級而已!

因此科學家也提出其他可能的暗物質理論。比如認為暗能量不是來自真空能量,而是由一種未知的粒子場所驅動,而這個場與時間有關,導致早期和晚期宇宙的觀測結果有差異。還有人認為根本沒有暗能量存在,宇宙會膨脹,是因為愛因斯坦的廣義相對論在宇宙學這種大尺度中是不適用的!就像牛頓的萬有引力公式在地球上管用,到了太陽系規模就會出現誤差。或許在宇宙規模還有比廣義相對論更完備的其他理論等待我們發現!另一派科學家也認為沒有暗能量,我們會看到加速膨脹,只是因為銀河系剛好位於宇宙大尺度結構的孔洞中,也就是葡萄乾麵包裡面空氣比較多,口感比較鬆的地方,由於這個地方總體重力比較小,天體也就是葡萄乾之間向外膨脹的速度比較快,但不代表整個葡萄乾麵包都在加速膨脹,宇宙加速膨脹只是局部觀測的假象。

這些理論或許可以解釋部份的問題,但沒有一個能解釋所有觀測數據,而且由於觀測的限制,這些理論都缺乏數據的佐證。因此目前我們只能說,暗能量的效應確實存在,但我們還不知道它確切是什麼。

有人可能想問,研究暗物質對我們真的那麼重要嗎?其實,它不只影響了宇宙過去演化的歷史,也影響著我們將來的命運。由於宇宙膨脹,物質的密度會因為膨脹被稀釋,但如果暗能量是常數,就代表密度不會改變,因此宇宙會膨脹的愈來愈快,導致遙遠的星系加速離我們遠去,最後暗能量會超過所有的基本作用力,包括重力、電磁力和核力,星系、太陽系、地球都將被拉開,甚至中子和質子都互相分離,使原子不復存在,進入大撕裂時期,也將是宇宙最孤獨的結局。不過這是一百多億年後的事情,在那之前地球會先被死去的太陽吞沒,我們應該要先煩惱的是要如何移民其他星球才是。

最後總結一下,暗能量到底是什麼?很抱歉,經過了幾十年的努力,這個問題依舊是一個問號,但藉由宇宙學的研究,使我們更謙卑更加發覺自身的渺小,我們或許已經掌握許多物質運作的原理,也開發出許多高科技產品,但這些只是整個宇宙的 5% 仔,宇宙中還有許多未知等待我們去探索,而它深深關係到我們的過去和未來。

最後也想問問大家,你覺得當一切真相大白之時,我們會發現暗能量是什麼呢?

符合最直覺的 ΛCDM 理論,它就是宇宙加速膨脹的元凶!

它根本不存在,我們甚至需要比廣義相對論更強的理論來解釋!

依照人類這個物種的感知等級,可能永遠無法了解暗能量的真相!

我、我已經無法抑制我左手的暗能量了!啊啊啊~

歡迎訂閱 Pansci Youtube 頻道 獲取更多深入淺出的科學知識!

參考資料