- 首圖:Youtube影片截圖

- 相關資料由泛科學編輯部 y 編整理

台灣花蓮的多羅滿賞鯨船前幾天在花蓮外海拍攝到一鬚鯨影像,經日本東京國立自然史博物館山田格博士根據照片特徵判斷,幾乎確認是「角島鯨」的罕見活體紀錄!角島鯨究竟有多神秘?為什麼會引起熱烈的討論?一起來了解吧:

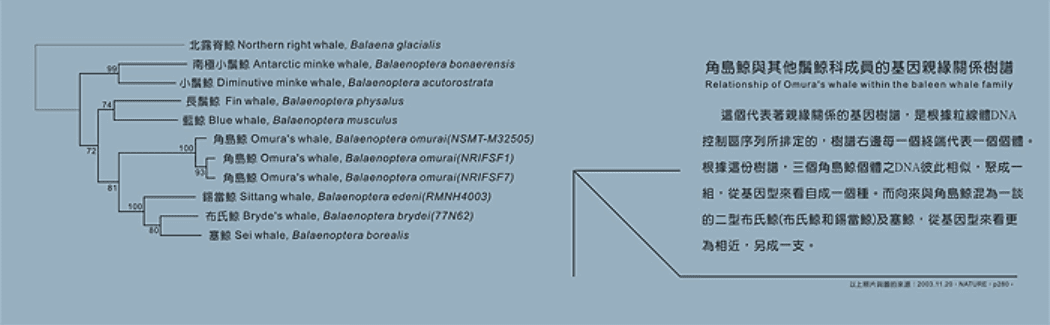

角島鯨(Balaenoptera omurai),於 2003 年由三位日本科學家:和田志郎、大石雅之、山田格命名並在《 Nature 》上發表,牠以 omurai 為名是為了紀念日本研究鯨類的重要學者、曾任日本鯨類研究所所長的大村秀雄博士。

角島鯨外型與長鬚鯨(Balaenoptera physalus)、布氏鯨(Balaenoptera brydei)等鬚鯨科(Balaenopteridae)的鯨魚相似,但長鬚鯨體型較長(約 18~26 公尺),而屬於中型鯨的角島鯨成年鯨的身長大約只有 11 公尺左右;角島鯨亦有不同於長鬚鯨的身體特徵,例如「角島鯨右側嘴喙偏白、左側嘴喙深色的不對稱特徵,以及胸鰭前端為白色等等」,但這些特徵往往在海上目擊時不容易被辨識。

- 資料補充:黑潮海洋文教基金會

由於極少找到角島鯨的活體,科學家是透過標本比對、DNA 分析鑑定等方式才確定了角島鯨為新種鯨魚;這期間他們跑遍了世界各地去紀錄、觀察並精細測量當地的角島鯨標本,其中亦包含國立台灣科學博物館從 1990 年以來搜集的四件在台灣死亡的角島鯨標本。

- 詳細的故事歡迎參考科博館網站:21世紀新發現的大型鯨—角島鯨

角島鯨很少在鏡頭下出現,之前僅有 2015 年海洋科學家曾在馬達加斯加外海捕捉到的活體角島鯨的身影。研究團隊最初是在 2011 年注意到了這隻角島鯨,之後數年亦在附近的海域觀察到了 44 組群體,透過採集皮膚樣本做 DNA 比對,確認證實這些鯨魚群體為角島鯨。這些研究觀察於 2015 年 10 月發表於《Royal Society Open Science》。

- 原文論文:Omura’s whales (Balaenoptera omurai) off northwest Madagascar: ecology, behaviour and conservation needs

- 關於當時詳細的報導歡迎參考台灣動物新聞網:神秘”角島鯨” 活體影像世界首見

這次(2017 年 5 月 22 日)在花蓮外海發現的角島鯨,一開始也被誤認為鬚鯨,後來有日本的鯨豚研究者 Daniel Yasutaka Imai 指出可能是角島鯨後,發現角島鯨的賞鯨業者即藉由黑潮海洋文教基金會與科博館姚秋如、以及其中一位角島鯨的命名學者日本東京國立自然史博物館山田格博士聯繫,透過照片分析特徵後目前認定影像中的鯨魚為角島鯨。

關於角島鯨還有很多的疑問和未知,牠的生活史、習性及食性都還需要有更多的觀察和研究才有可能漸漸明朗;生物多樣性資料庫系統建立與完善亦是其中重要的一環,期望這次的「鯨喜」不只是個驚喜。

相關資料: