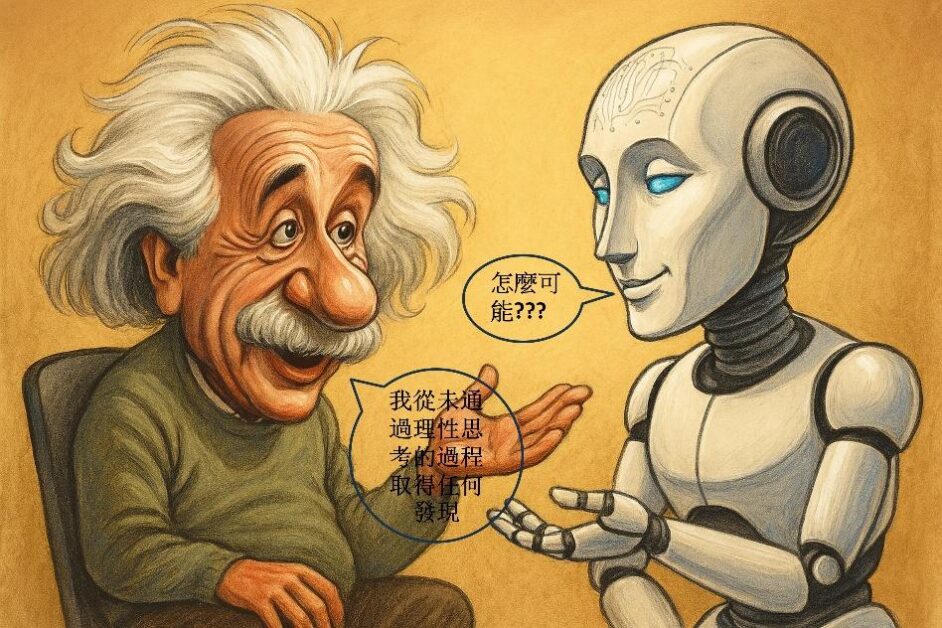

在發現的道路上,智慧(intellect)作用不大。意識(consciousness)━你可以稱之為直覺或其它任何你想用的詞━會發生一次飛躍,答案會突然出現在你面前,而你卻不知道它是如何或為什麼出現的。

-愛因斯坦(1879-1955),1921年諾貝爾物理獎

2025 年 10 月 13 日在參加建國中學高三 6 班畢業 66 週年的同學旅遊後,希望能瞭解一下投稿多年、從未謀面之《泛科學》的作業情形及發展計畫等,我決定到「泛科創新股份有限公司」參觀一下:沒想到知識長鄭國威竟然邀請我錄了一集「思想實驗室」。當被問及有關人工智慧(artificial intelligence,AI)的看法時,我突然冒出「因為科學的發現很多都是意外的,因此AI無法像人類一樣具有創造性」。沒想到這句話似乎成為這次訪問的主題,也引起比較熱烈的討論,因此我想在這裡補充一下。

AI(人工智慧)是否能青出於藍、更勝於藍地超越我們?這事實上也是專家爭論最多的話題。我不是專家,雖然知道「我思故我在」,但完全不知人類如何思想、大腦如何運作,更不瞭解上面愛因斯坦所提到之意識(consciousness)如何飛躍!但是已經被國威推上了這個平台,因此只好在這裡野人獻曝,依我所知的科學史提出懷疑。

回歸正題,上面問題的直覺反應答案是:人製造出來的怎麼可能比人聰明呢?但相信很多人都知道:人類所製造出來的圍棋軟體 AlphaGo 已經戰勝了所有的人類!其主人谷歌(Google)謂:它能戰勝人類是因為它利用策略網絡來推薦有希望的走法,並利用價值網絡來評估在給定局面下獲勝的機率,從而大幅縮小搜尋空間,使得它能夠「預想」數百萬步棋,並透過自身的對弈不斷學習,最終超越人類的層次。從這段話看來,我覺得 AlphaGo 能戰勝人類是基於高速地使用人類所設計出來之有路可循、亦有跡可尋的「邏輯策略」!

同樣地,如果我們給 AI 一含所有物質之性質的資料庫,然後告訴它如何尋找「規律」(pattern),相信它會非常勝任地發現許多具有某種特性的「新物質」、「新藥物」、甚或告訴我們如何製造它們(有機合成的資料庫)。但是 AI 雖然知道哈密瓜的所有性質(資料庫),可是它會想到哈密瓜含有能大量分泌青黴素的菌株、即時在第二次世界大戰中拯救了上百萬士兵的生命嗎(見後)?我覺得後者不是邏輯的問題,是沒辦法訓練的,因此 AI 不能「真正創造」不是依靠邏輯的發現。這正是本文所要談的:許多科學大突破都不是靠訓練或邏輯分析的!

視眾人所見視,思眾人所未思

牛頓的傳記《艾薩克·牛頓爵士生平回憶錄》(Memoirs of Sir Isaac Newton’s Life)於1752年出版;作者斯圖克利(William Stukeley)在書中轉述:「晚餐後,天氣溫暖,我們去了花園,在幾棵蘋果樹的樹蔭下喝茶……他(牛頓)告訴我,他當時的處境和以前一樣,剛剛想到萬有引力的概念。當他正沉思時,一個蘋果掉了下來。他心想:『為什麼蘋果總是垂直落到地上,永遠不會向上或向一側掉落呢?……』,這使他得出結論:地球一定具有『引力』,從而發展出他的萬有引力理論。」

早在西元前 4 世紀左右,亞里斯多德(Aristotle)及歐幾里德(Euclid)等希臘哲學家就為自然哲學和邏輯奠定了基礎。樹上的水果都是往地面掉,這是任何小孩都知道的「常識」,但為什麼卻等了 1700 年才引起牛頓的注意?我們不知道為何牛頓會想到這個問題,但 AI 也會注意到這個現象嗎?如果會,它會先想到萬有引力或是直接跳到更精確的愛因斯坦廣義相對論(見後)呢?

發現世上第一個抗生素的弗萊明(Alexander Fleming)度假回來後發現培養皿因未加蓋而發霉(見後),一般的研究者大多會將這些被黴菌孢子污染的培養皿丟掉;但弗萊明這次卻心血來潮……。他回憶說:

「基於先前「溶菌酶」的經驗,也像許多細菌學家那樣,我應該會把污染的培養皿丟掉,……某些細菌學家也有可能(早就)注意到我(那時)看到的相似變化,……但是在對天然產生的抗菌物質沒有任何興趣的情況下,都會順手地將培養物丟棄。……但(這次)我沒有找個藉口丟掉受污染的培養液;相反地,我做了進一步的探討。」

如果AI也能做實驗,它會像許多細菌學家那樣「順手地」丟棄培養物嗎?機會總是降臨在那些做好準備的「人」身上。

幸運的靈感/直覺

一位正在自由下落的人不會感覺到自己的重量,那不是等於漂浮在沒有任何重力的外太空空間嗎?如果加速度可以抵消重力,那麼在沒有重力的情況下,加速度本身不是可以模擬重力,產生與真實重力沒有區別的人造重力嗎?愛因斯坦稱上面這一發現為「等效原理」(Equivalence Principle):我們雖然不知道重力是什麼,但其現象可以用加速度來模擬!這一想法啟動了愛因斯坦嘗試改變牛頓重力論的八年艱苦抗戰,於 1915 年 11 月完成了人類有史以來最美麗的物理理論━「廣義相對論」(General Theory of Relativity)。100 多年後的今天,愛因斯坦這一透過想像力來推測的理論仍然在指引著物理學家們去瞭解宇宙的基本特徵!怪不得愛因斯坦後來大膽地稱它為「我一生中最幸運的靈感」。

德國理論物理學家普朗克 (Max Planck) 謂他是靠「幸運的直覺 (lucky intuition) 」而意外地敲響了量子力學革命之鐘聲!在 1918 年諾貝爾獎頒獎典禮上,普朗克回憶說:

「然而,即使(我推導出來的)輻射公式絕對準確,它仍然只是一個幸運猜測(lucky guess)了正確插值公式的結果,其價值是非常有限的。因為這個原因,從那時起,我就忙著… 想闡明此公式的真實物理特性,這導致我考慮連接熵和概率之間的波茲曼(Boltzmann)關係。在經過我生命中最艱苦的幾個星期之工作後,光明終於驅除了黑暗,一個新的、從未夢想到的的觀點在我面前展開了。」

這普朗克從未夢想到的觀點是什麼呢? 就是「能量量化」的觀念,違反了當時「能量是連續」的共識!因之此後的十幾年,普朗克便一直在努力地想使他的量子觀念能容於古典力學裡;可是每次嘗試的結果,似乎均使自己失望得想收回那革命性的「大膽假設」而已。

錯誤的假設

好吧,就假設 AI 像愛因斯坦一樣也有「最幸運的靈感」,發現了廣義相對論。可是後來物理學家瞭解到了愛因斯坦的「等效定理」事實上不完全正確,是有限制的,也就是說它只是一種近似的基本定律,只適用於一個局部、無限小的時空區域內。哈,如果AI比人類聰明,怎麼會在邏輯上犯下這個錯誤呢?如果不犯這個錯誤,它能發現廣義相對論呢?

又如 1905 年,愛因斯坦在題為「關於運動物體的電動力學」的(狹義相對論)論文引言裡,開宗明義地謂「不要爭辯」光速了:

「我們建議將「相對性原理」這個猜想(conjecture)提升到一個公設(postulate)的地位,並引入另一個表面上與前者不調和(irreconcilable)的公設,即光是在真空中的傳播速率為一與發射體運動狀態無關的定值 c。 這兩個假設足以(讓我們)透過適用於靜止物體(狀態)之馬克斯威(Maxwell)理論,導出一個簡單且不矛盾(consistent)的電動力學理論。」

愛因斯坦真大膽:一個可以用實驗來確定的光速,怎麼可以定為「公設」呢?光速與發射體運動狀態無關不是完全違反了我們日常生活的經驗(如聲速)嗎?愛因斯坦在其時鐘「同步程序」的假想實驗裡魔術般地導入了他的公設:光在任何方向的速度都是一樣的 c 值!完全忽略了當時幾乎所有物理學家都相信光是在「以太」中傳播的理論。

1924 年,一位名不見經傳,任教於東巴基斯坦的講師波思 (Styendra Bose) 在一篇 1500 字的論文裡做了一個誤打誤撞、連他自己本人都不知道、在整篇論文中隻字未提的重要及創新性假設:光量子是不可分辨的!在當時,所有的物理學家都認為光量子像銅板一樣是可以分辨的(我們可以分辨哪個是 A 銅板、哪個是 B 銅板、…),因此兩個銅板出現「一正及一反」的或然率是 2/4;但如果它們不能分辨呢?則出現「一正及一反」的或然率將變成 1/3。沒想到這一「錯誤」的假設後來竟成為打開量子統計力學的鑰匙!超強邏輯的AI會犯這種錯誤嗎?

愛因斯坦1915年完成他的廣義相對論後,發現他的方程式所預測的宇宙只能膨脹或收縮,與當時大部分科學家所認為的靜態宇宙觀相衝突!沒想到推翻了深植物理學家心中達兩百多年之牛頓時空觀念的革命壯士,竟然在這裡屈服了:為了符合當時的想法,愛因斯坦於1917年強行地於其廣義相對論導出之宇宙觀中加入一「常數」來平衡萬有引力,使他的宇宙能保持靜態!沒想到1929年後,新數據顯示宇宙不是靜態,而是在膨脹中;愛因斯坦因而後悔當初為何不相信自己的推論,稱那強行加入人為常數━「宇宙論常數」(cosmological constant)━為他一生中所犯之「最大錯誤」。AI會犯這種錯誤嗎?

只有萬有引力的宇宙膨脹速率在一段時間後應該慢慢減小;但90年代末期,新的發現顯示現在宇宙膨脹速率不是隨時間減小、而是在加大!沒想到那錯誤的「宇宙論常數」現在竟然成為提供瞭解釋膨脹速率加快所需之排斥力來源─雖然我們還不知道那是啥!當然,我們也不知道愛因斯坦在天之靈是否還認為「宇宙論常數」是他一生中所犯的最大錯誤?而AI如果當初未犯那「最大錯誤」,現在是否反而會後悔呢?

老天的幫忙

硝化甘油為液體,非常不穩定,一不小心就爆炸;因此諾貝爾 (Alfred Nobel)一直在尋找取代物,但久而不得。傳說有一天儲存的硝化甘油意外泄漏,與用來包裝儲存鐵桶之板狀矽藻土混合但未爆炸,使他想到了試用此板狀矽藻土。經實驗後,他發現兩者相混之固體不但安全可靠,而且還可保持原有之爆炸威力─這不正是他夢寐以求、研究甚久而未能找到的「穩定炸藥」嗎?他因此發了大財,設定了今日大家所知道的諾貝爾獎。

在「發現能治療糖尿病的胰島素—胰島素與生技產業的誕生(上)」一文裡,我提到了「….將狗的胰臟割除,發現這隻可憐狗整天口渴及隨地小便。數日後,一位助手覺得實驗室內的蒼蠅好像突然多了起來,尤其是在狗小便過的地板。分析狗尿及其血液後,梅倫(Joseph von Mering)及明考斯基(Oskar Minkowski)很驚奇地發現裡面充滿了糖份。」顯然地,胰腺具有調解體內糖代謝的功能,它一旦受損將導致糖尿病。就這樣,法國兩位外科手術醫生無意中發現了「困擾」人類三千多年之糖尿病的病源━胰臟分泌物「胰島素」失調!這不是透過邏輯分析得到的結果,AI能做到嗎?

前面所提到之蘇格蘭醫生兼微生物學家弗萊明是一位粗心的實驗室技術員。1928 年夏在研究葡萄球菌的某一天,他忘了將含有葡萄球菌培養物的培養皿放在培養箱中,留在實驗室工作台上就匆匆忙忙地離開實驗室去度假。命運就是這樣作弄人:那時室內的溫度及濕度均適合霉菌(mold,或譯「黴菌」)的生長;因此兩個禮拜回來後,弗萊明發現在敞開窗戶旁的培養皿因未加蓋而發霉。經細心觀察及研究後,弗萊明發現抑制或預防細菌生長的不是黴菌本身,而是黴菌產生的「黴汁」。就這樣,弗萊明發現了世上第一個抗生素「盤尼西林」(Penicillin,又稱為「青黴素」)!被《時代》雜誌評選為20世紀的100位最重要人物!

1943年的某一天,在伊利諾州皮奧里亞 (Peoria) 的農業部北部區域研究實驗室 (NRRL) 工作的亨特 (Mary Hunt) ,無意中在一雜貨店裡發現了一顆表皮長滿漂亮及金色青黴的哈密瓜。將它帶回實驗室,篩選出能大量分泌青黴素的菌株後,她發現該菌株產生的青黴素數量是notatum的200倍━她因之贏得「發霉瑪麗 (Moldy Mary)」的綽號。在許多研究團隊紛紛加入菌種及製造方法的改良後,青黴素產量由1943年只能醫治不到1000人,一下子跳到1944年時,已有足夠的青黴素來治療每位需要的士兵,為第二次世界大戰提供了功不可沒的貢獻!也啓動了尋找其它抗生素的研究,開創了醫學的新紀元。

結論

上面我們提到科學家意外地發現了穩定的炸藥、控制血糖的胰島素、及治療特定細菌感染的抗生素。這些化合物都已經存在自然界中,但絕對不是邏輯分析可以發現其功能的,因此如果不是「老天的幫忙」,我實在很難理解AI怎麼會想到?事實上靠「老天幫忙」所發現的化學物是非常之多的。不需要靠老天幫忙的理論物理呢?

在討論牛頓「思眾人所未思」地發現萬有引力、開創了古典物理後,我們其它的討論都是針對全面改變我們日常生活之近代物理━量子力學及相對論━的發現史。希望讀完本文後,讀者能體會到科學進步不但鮮少一帆風順,相反地是一條充滿了意想不到之彎路和迷茫時刻的曲折蜿蜒旅程:這正是我在訪談中所提到的要多看「課外書」,鑑古知今瞭解理論背後歷史有助於瞭解理論本身。也希望讀完本文後,讀者能感受到科學上的突破幾乎全不是源自邏輯分析,而是出自無法捕捉的「靈感」、「直覺」、「錯誤假設」,「老天幫忙」、以及挑戰既有認知的「勇氣」。AI具有這些人性「缺點」嗎?

最後讓我們在此以公認為最偉大之兩位物理學家的話來結束。牛頓說:「沒有大膽的猜測,就沒有偉大的發現」;愛因斯坦謂:「我從未通過理性思考的過程取得任何發現」。

致謝

謹在此感謝《泛科學》鄭國威、曹盛威、謝富丞、廖儀瑄、王喆宣等同仁的招待及讓我有機會當了一次近代科技 Podcast 的明星。Podcast 的出現造就了許多不需要經過好萊塢的影視明星以及網紅,是我首次接觸到之近代日常生活典範的另一個重大轉變,真是活到老學到老。

延伸閱讀