在上一次人類又再度逃過世界末日預言之際(2012/12/21),科宅我很榮幸能擔任「末日之戀」的其中一位講者,和兩性心理學專家海苔熊、哲學雞蛋糕蛋糕鋪老闆朱家安,一起從心理學、哲學和生物學(當然是我)談「什麼是愛?」。

Q&A時間有讀者問到「你對『喜歡看正妹』這現象有什麼看法?」(當然,確切的問句我記不得了,不過大概是這樣),我還真一時不知道該怎樣回答。我喜歡看正妹,正妹的確也能從演化解釋一些優勢,但那似乎也不是一切,否則這世界上不符合演化上認定「正妹」的人不就找不到伴了?可是我也在談論相關的研究,那麼我的價值觀是什麼?我怎麼看待『喜歡看正妹』這現象?

我讀過一些人類或者動物性擇的研究,那些非常符合經濟學邏輯的算計;演化就像一位嚴苛的裁判,只有當子代數量最大化,成功傳遞下來的基因才得以保留。每位研究性擇的演化生物學家儼然成為一位動物的兩性專家-或者說是性擇競賽的顧問,講授不同社會結構的動物,在不同的環境下如何能夠達到子代數量最大化-或至少,將基因傳承下去。

人類,Homo spiens,在「行異營性性的多細胞生物」的定義下,被定義為一種動物。既然身為一種動物,人類不大可能完全不受演化的擺佈(可以參考〈人類仍受天擇擺佈嗎?〉一文,或《BBC知識》國際中文版第10期)。人類也受「崔弗斯–威勒德假說」(Trivers-Willard hypothesis)的影響,在環境艱困時較可能產下女嬰;較容易被對稱、或和自己相似的臉孔吸引;女性易受低沈嗓音的男性吸引;主要組織相容性複合體(MHC)差異大的異性較可能彼此吸引;費洛蒙左右著人類的選擇伴侶的對象……(參考《精子戰爭》、《性的歷史》、《第三種猩猩》…)這些經由嚴謹科學研究過程得到的結論,真的就是我們在挑選伴侶、戀愛、或甚至說找尋「真愛」該遵行的指南嗎?

「『愛』是什麼?」這是人類千年以來不斷在思考的問題,同為人類的科學家當然也想找尋答案,而科學家擅長以「科學」作為解答的工具。

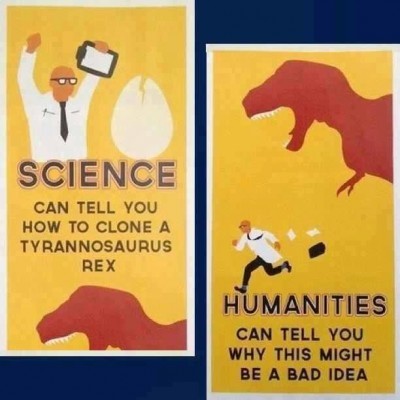

不管你是不是科學家,只要熟悉「科學方法」都會發現科學並非萬能,科學對於自然萬物的解釋有諸多限制。它只能解釋能重複出現的現象(再現性)、能普遍被人類感知的現象(感官經驗)、可以驗證的現象(實證原則:任何不可驗證的陳述都既非真,也非假,而是沒有實在意義)、符合統計上的可信度、真偽不對稱性(真不能被證明,只有偽可以被證明;比如,再多的白羊也不能證明所有的羊都是白的, 而只要一隻黑羊就能證明所有的羊都是白的這個理論是錯誤的)……等等。

在面對真實世界時,科學這工具顯得簡陋,但卻又是我們手上擁有最好的工具,也就被將就用來研究人類的「愛」。但是「愛」太複雜,所以只好限縮研究範圍在「兩性的彼此吸引」,而「兩性的彼此吸引」有很大一部分又跟「性」有關;「性」又脫離不了演化,這是為什麼很多解釋「兩性的彼此吸引」的研究這麼的「那個」。

講到這裡或許你已經發現,我們怎麼能夠認為在諸多控制的因子下得到的科學結論、或者經由一小搓人,甚至是在其他動物(比方:實驗室的白老鼠、果蠅)身上歸納出的研究結果,足以解釋人類兩性的彼此吸引?更別提是了解人類的「愛」了。即便有再多探討人類兩性彼此吸引的研究,三兩天就刊登在報紙或者PanSci上,那些探討人類「愛情」的科學家、或者這些研究的忠實讀者,對於人類的「愛」仍一無所知。

科學家是一種明知道自己無法觸及「真理」,卻又死命朝「真理」前進的人;是一種天命、一種狂熱、一種來自內心的驅使,可能有點像著魔,所以這裡先不討論為什麼科學家明知不能了解人類的「愛」卻又一直去研究。這裡要討論的是:科學家該怎樣呈現這些研究?以及大眾該怎樣解讀這些研究?(這也適用於「愛情」以外的科學研究議題,包括公眾議題有關的研究)

科學家

在觀察到一個現象之後,科學家會提出問題,然後提出假設,再設計研究方法來驗證假設,如果研究結果和假設相符,那麼就成了一套能解釋現象的說法;如果研究結果和假設不符,那麼就重新設計研究方法,或者修改假設。上述過程就是科學方法。

舉例來說:一位科學家觀察到(或者精確來說是「注意到」,因為大多數人都能觀察到,但只有他注意到了這現象)-「異性會彼此吸引」。於是他可能提出問題:「為什麼他/她要選她/他?而不選別人?」或者問「他們彼此是怎麼吸引的?」。那麼他可能提出的假設是「他們會選擇外表對稱的對象,反映出對方優良的基因」或者是「他們會選擇免疫系統和自己差異較大的對象,好生下免疫系統組成較多元、較能抵抗病源的後代」;然後再選定研究方法,看是要調查既有的夫妻檔,或者搭配免疫檢測作問卷調查……講到這裡,你應該已經發現這套流程沒有想像中的「客觀」;科學家會對於哪個現象感興趣、提出怎樣的問題假設、設計什麼樣的驗證方法都受到他個人經驗還有成見的左右。

那麼,科學哪裡客觀呢?科學的客觀在於驗證的過程-無論驗證之後得到的結果是否符合原先假設,科學家都得接受。也就是說,驗證的過程設越是客觀,越可能避免主觀所造成的對世界的誤解。科學家在了解世界是同時帶著成見(主觀經驗)還有開放的心(能接受被研究結果推翻假設,或接受被別人推翻已成對現象的解釋)。

在費盡千辛萬苦反覆驗證得到一則研究結果之後,科學家該如何向大眾展現?

一則研究2萬光年外黑洞的形成或許對大眾沒有太大影響,但如果是一篇「催產素影響人類伴侶忠誠度」的研究,就可能被錯誤解讀為「合理的偶外交配(extra pair copulation)」(外遇的那方就是腦中催產素濃度較低)。在其他公眾議題相關的研究結果也面臨一樣的風險,假設(只是假設!)研究結果顯示「全球均溫在地質史記錄的波動範圍內」,那麼會不會成為忽視環保政策的論述?此外,就算看來跟公眾議題無關的研究,也未必就不會被引用,達爾文當初也沒料到演化論會被曲解支持種族淨化。

科學家該有一定的公眾意識,在《這個不科學的年代》中,費曼(Richard P. Feyman)也提到:「當科學家被告知他必須為自己對社會的影響負點責任,一般指的都是科學的應用部分。如果你研究的是核能,那麼你必須明白,它也能用在對人有害的用途上。因此,在某些科學家的討論會中,你會預期這將成為最重要的議題。」

除此之外科學家和你我一樣有自己的信仰、世界觀、價值觀、政治立場,也會(也應該)提出科學證據來支持自己的觀點。不同的是,科學家的發言對於非科研背景的大眾來說可能是「經過深思熟慮、比我們更了解這議題」的資訊,也就更可能左右人的行為,或者甚至是公共政策的方向。

科學家必須清楚自己是在什麼場合發言,如果是在課堂、演講、報紙專欄…,就該謹慎切割個人的信仰、世界觀、價值觀、政治立場在科學之外,在表明個人意見時提醒受眾那是個人意見。如果可以,也要提及其他論點的看法,但未必須要詳細呈現,只是要讓受眾明白不只有一個觀點。比方談論演化論時,盡可能也提到神創論怎麼說,兩派說法的爭議點在哪。

當然,科學家也可以大聲疾呼,表明自己的信仰、世界觀、價值觀、政治立場,那的確能發揮影響力,不過代價可能是失去大眾對這位「科學家」的信賴度。再說不同領域有不同領域的專業,公共政策是別於科學以外另一門深奧的學問,化學家就別自以為懂,插手教育體制(當然,不排除得過諾貝爾獎的化學家也精通教育這門學問的可能)。

大眾

大眾在面對問題時,最想知道的總是「我該不該這麼做?」或者「我該做什麼?」。很可惜,科學不能回答這些問題。大眾除了該認知科學的侷限還有科學方法之外,更重要的是認清科學無法替道德問題下決定。

科學能回答「如果我做這個,會有什麼後果?」,但至於「我想不想這後果發生?」就是個人的道德價值判斷了。舉例來說,腦神經學家發現,想起逝去的戀情大腦的痛覺神經會有和被熱咖啡潑到一樣的反應-這是科學。但是要不要讓另一個人因為失戀而承受這樣的「痛」,就是個人的道德判斷。或者,統計發現,男性和固定伴侶以外的對象性交,有較高的猝死風險,但值不值得冒這風險,就是個人的價值觀了。

所以,我認為大眾不該要求科學家判斷「該不該這麼做?」,甚至,大眾應該根基在科學家提出的科學證據上自己做決定!

後記

回到「正妹」這件事。我是一個愛看「正妹」的科宅,或許因為那些「正妹」外表比較對稱、比較符合我的印痕辨識的特徵…等等,這些科學家提出人類愛看「正妹」的原因都無關「我就是愛看」的事實。但是如果你問我會特別挑正妹交往嗎?我想比起正不正,跟我有相似的價值觀、能一起經營關係、一起宅起來打Game…等等會是我優先考量的因素吧?

延伸閱讀: