光學顯微技術探入果蠅腦袋最深處——描繪超高解析度的 3D 神經結構!

如何透過神經細胞彼此的連結產生進一步的功能,是21世紀科學界想破解的謎團。圖/Pixabay

如何透過神經細胞彼此的連結產生進一步的功能,是21世紀科學界想破解的謎團。圖/Pixabay大腦:人類未竟的疆土

當我望著無邊無際的蔚藍海洋、聽到浪花聲、感受微風的輕拂,喜悅地回想起和好友在此旅行的回憶,並決定拿起手機拍下眼前的美景,我是如何感知世界、如何儲存與提取記憶?我的情感、思想、決策與行為是如何發生的?這些心智行為的奧秘藏在擁有 860 億個神經細胞的大腦,是我之所以為我的關鍵。

究竟大腦如何運作?這些神經細胞是如何透過彼此的連結與交互作用產生進一步的功能?進入 21 世紀以來,美國、歐盟、日本、中國等紛紛成立大型且長期的腦科學研究計畫,企圖揭開大腦的奧秘。

我國科技部也推出「台灣腦科技發展及國際躍升計畫」,整合既有研究能量與專業人才,期望建構模式動物至部分人腦的腦神經網路結構及功能圖譜,並帶動腦部疾病的精準醫療。

光學顯微鏡:小動物腦研究的利器

想要全面分析大腦的結構與訊號,解開單一或一群神經細胞的連結情形,精良的觀測工具是其根本,因此臺大物理系教授朱士維致力研發先進的光學顯微鏡技術。

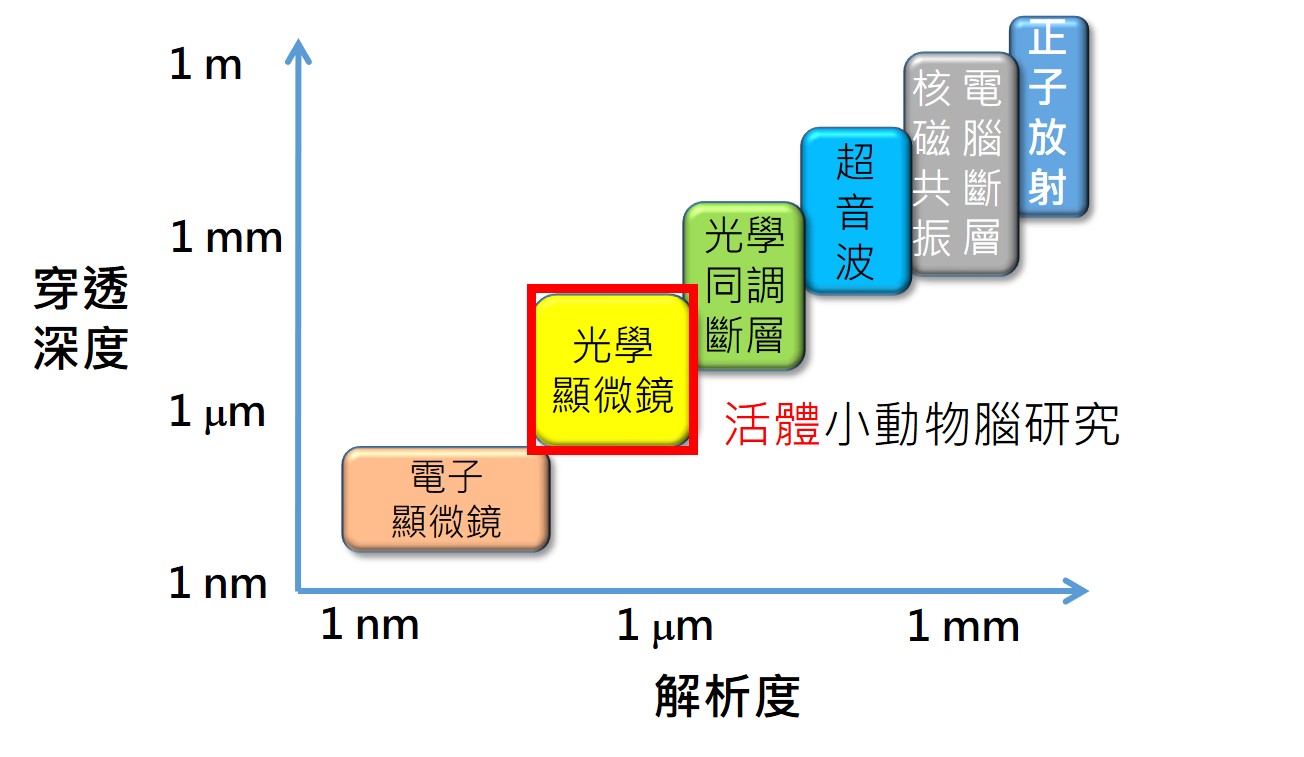

朱士維表示,常用於醫療的影像技術,像是正子造影(PET)、磁振造影(MRI)、超音波等,雖然可以穿透很深的物體,但是解析度不夠高,無法看到單一細胞;而解析度極高的電子顯微鏡穿透深度卻很小,只能看到表層。光學顯微鏡恰好介在中間,適合用於研究小動物的腦。近期,朱士維的跨領域團隊發表了數個嶄新的顯微技術,分別在解析神經訊號和結構有了重大突破。

數個影像技術在解析度與穿透深度的分布。圖/朱士維提供

數個影像技術在解析度與穿透深度的分布。圖/朱士維提供飆速3D攝影,解析神經的功能性連結

首先,研究團隊發表了「高速體積成像系統」,是全球第一次可在活體果蠅腦中以毫秒解析度取得神經結構 3D 高速動態影像!

「高速體積成像系統」是由雙光子顯微鏡與「可調變的聲波漸層透鏡」(TAG)結合構成。拍攝二維的動態影像並不稀奇,厲害的是,研究團隊如何把二維變成三維?關鍵就在於「可調變的聲波漸層透鏡」。由於液體透鏡的密度,會決定光的折射率,進而影響焦距的長短,研究團隊透過壓電材料激發液體透鏡共振,當透鏡的密度不斷變化,焦點也會快速移動,其振盪頻率可高達 100 kHz – 1 MHz,也就是說,在 10 萬分之一秒以內即可完成焦點的來回移動。

「可調變的聲波漸層透鏡」(TAG)放置在物鏡前面,透過壓電材料促使TAG密度改變,進而移動焦點位置。圖/朱士維提供

「可調變的聲波漸層透鏡」(TAG)放置在物鏡前面,透過壓電材料促使TAG密度改變,進而移動焦點位置。圖/朱士維提供 焦點快速移動的示意動畫。圖/朱士維提供

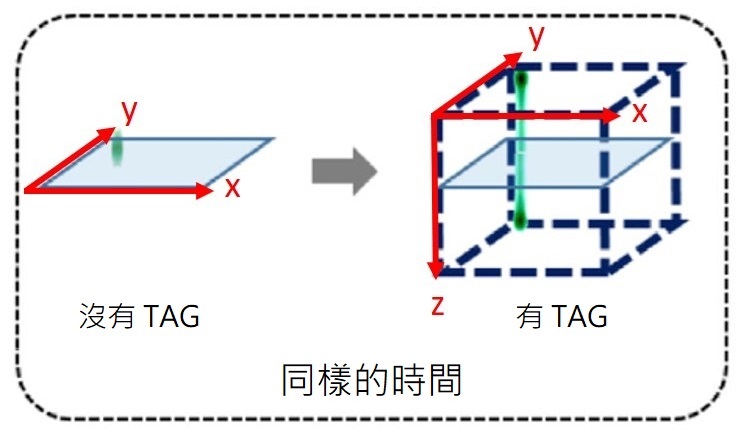

焦點快速移動的示意動畫。圖/朱士維提供一般雙光子顯微鏡每拍攝一次只能拍到水平面(xy 軸)的像素並組成二維影像,若加上「可調變的聲波漸層透鏡」組成「高速體積成像系統」,即可同時進行深度(z 軸)的來回掃描,在同樣的時間內拍攝出一個包含各個深度的體積三維影像。

同樣的時間下,原本只能掃描一個水平面,有了「可調變的聲波漸層透鏡」,則可掃描完一個體積。圖/改自參考資料 2

同樣的時間下,原本只能掃描一個水平面,有了「可調變的聲波漸層透鏡」,則可掃描完一個體積。圖/改自參考資料 2這項強大的技術對於研究神經與神經之間的功能性連結非常有用,譬如說,想了解果蠅如何處理嗅覺訊號,我們可以給果蠅聞一種特殊氣體,以「高速體積成像系統」綜觀其腦,即可找出此特殊的嗅覺刺激會引發哪些下游神經反應。接著,選擇想深入研究的神經,將拍攝範圍鎖定在該神經所在的區域,便可以毫秒時間解析度與微米空間解析度,追蹤訊號在這些神經細胞之間的傳遞順序。

朱士維表示,「高速體積成像系統」的突破之處,在於可以於腦中劃定任意形狀的空間,並以毫秒等級的時間解析度,看見目標神經中各個神經細胞的電生理動態行為。

研究團隊更進一步發展光學神經激發系統,用光精準地刺激個別神經,再透過「高速體積成像系統」,輔以自動化影像分析,精準定位有反應之神經區域,做到「全光學生理」觀察(all-optical physiology)。目前已成功解析果蠅的視覺神經迴路中,上下游的神經連結與編碼模式。

「高速體積成像系統」以高速動態影像研究神經細胞功能上的連結,為建立果蠅的「功能性全腦連結體(connectome)」提供強而有力的工具。

探入果蠅腦深處,描繪超高解析度的 3D 結構

此外,在結構解析方面,顯微鏡光是能看到神經細胞還遠遠不足。神經細胞有樹突、軸突等向外延伸的纖維,有些纖維寬度只有 100 奈米,當兩條神經纖維緊鄰彼此,需要小於 100 奈米的解析度才能將它們區分開來。而且,神經纖維常常延伸至很遠的地方與其他神經細胞連結,因此顯微鏡的穿透深度,還須深至腦的最底層。

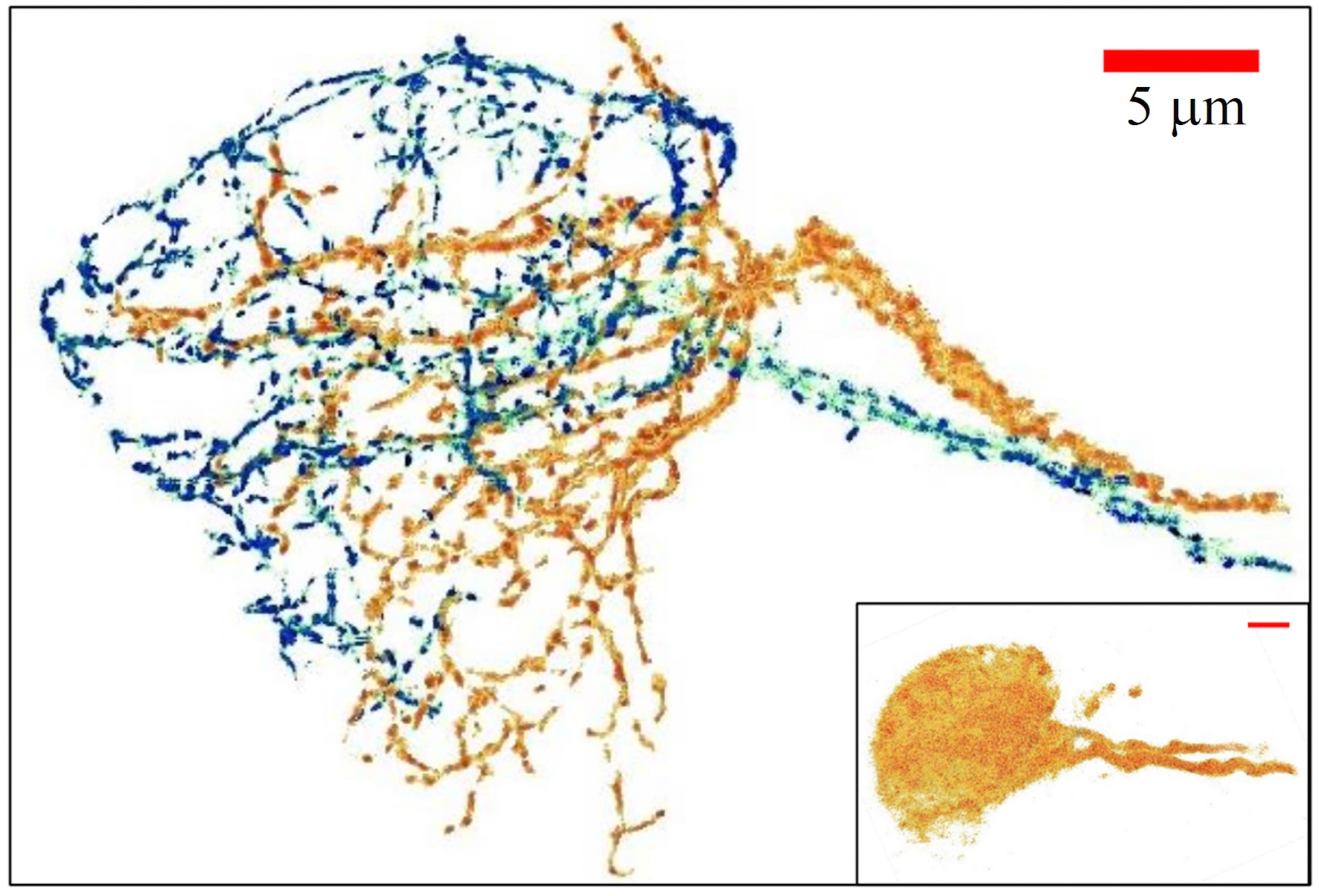

朱士維團隊發表了「深組織超解析光學技術」(Confocal lOcalization deep-imaging with Optical cLearing, COOL),在果蠅全腦中達成 20 奈米的超高空間解析度,剖析腦中神經的細微結構,能分辨出相鄰或彼此纏繞的神經纖維,藉以判斷神經連結的路徑。

三維的神經纖維分布圖像。「深組織超解析光學技術」可將兩條緊密交纏的神經纖維清楚分離開來。右下圖為相同神經與染色,傳統共軛焦影像無法分辨神經纖維的細緻結構。圖/朱士維提供

三維的神經纖維分布圖像。「深組織超解析光學技術」可將兩條緊密交纏的神經纖維清楚分離開來。右下圖為相同神經與染色,傳統共軛焦影像無法分辨神經纖維的細緻結構。圖/朱士維提供「深組織超解析光學技術」結合了四個關鍵技術,包含「螢光蛋白標定」、「共軛焦掃描顯微鏡」、「光學組織澄清技術」以及「定位顯微技術」。

「定位顯微技術」是 2014 年諾貝爾化學獎的得獎項目,透過操縱螢光分子輪流放光,再分別計算螢光分子的中心位置,打破光學顯微鏡的解析度極限,大幅提高解析度至接近 20 奈米。「光學組織澄清技術」則是江安世院士發明的 FocusClearTM 試劑,因其獨特的化學配方,讓生物組織各部位的折射率一致,呈現透明狀態。

朱士維團隊找出可適用於腦組織的螢光分子並改善其放光能力,成功將定位顯微技術應用在果蠅腦,並且透過光學組織澄清技術讓腦組織透明化,減少組織的散射與像差,提高穿透深度,以及利用共軛焦掃描顯微鏡一層一層地掃描不同深度的影像。最終,組合成三維的超高解析影像。

這項技術最厲害之處在於可穿透厚度約 200 微米的果蠅腦,在果蠅全腦皆達成 20 奈米的解析度,可應用在建立果蠅全腦的神經連結網路。

跨領域團隊 開創顯微技術新紀元

這些研究成果仰賴跨領域的團隊,除了朱士維,還有清華大學腦科學研究中心主任、中央研究院院士江安世、中研院物理所副研究員林耿慧、清大工程與系統科學系副教授吳順吉、清大生醫工程與環境科學系助理教授朱麗安、捷絡生技公司執行長林彥穎等人,共同參與研究。

諾貝爾生醫獎得主 Sydney Brenner 曾說:「科學的進展往往是始自新的技術」,腦科學作為 21 世紀科學界的兵家必爭之地,顯微技術的研發重要性不言可喻。朱士維團隊在動態的神經訊號與靜態的神經結構,皆發展出相應的顯微技術,可說是為腦科學領域開拓出令人期待的嶄新未來。

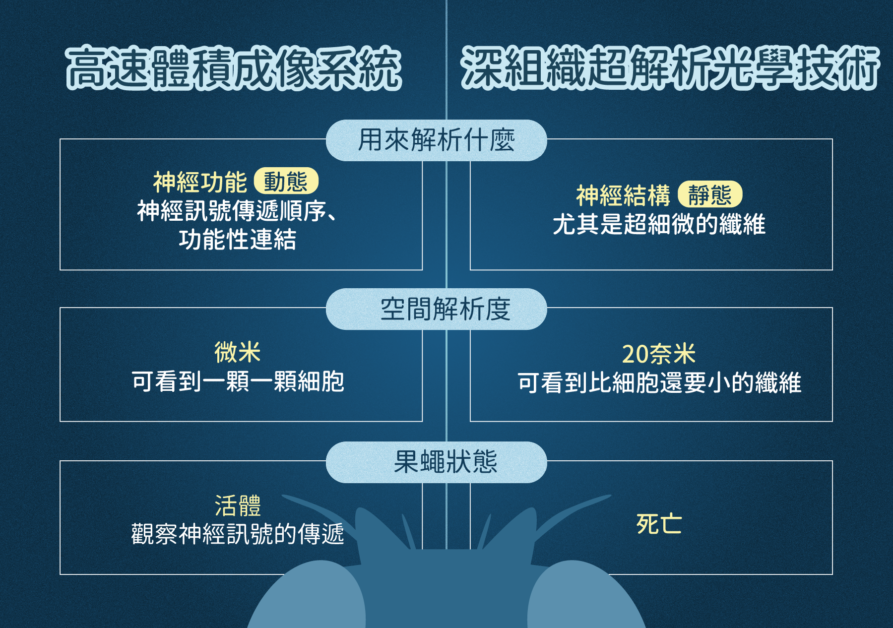

朱士維團隊開發的兩種顯微技術比較表。圖/沈佩泠繪

朱士維團隊開發的兩種顯微技術比較表。圖/沈佩泠繪

參考資料

- K.-J. Hsu, Y.-Y. Lin, Y.-Y. Lin, K. Su, K.-L. Feng, S.-C. Wu, Y.-C. Lin, A.-S. Chiang, S.-W. Chu*, “Millisecond two-photon optical ribbon imaging for small-animal functional connectome study”, Opt. Lett. 44, 3190-3193 (2019).

- C. Huang, C.-Y. Tai, K.-P. Yang, W.-K. Chang, K.-J. Hsu, C.-C. Hsiao, S.-C. Wu, Y.-Y. Lin*, A.-S. Chiang*, and S.-W. Chu*, “All-optical volumetric physiology for connectomics in dense neuronal structures”, iScience22, 133-146 (2019)

- H.-Y. Lin, L.-A. Chu, H. Yang, K.-J. Hsu, Y.-Y. Lin, K.-H. Lin, S.-W. Chu*, A.-S. Chiang, “Imaging through the whole brain of Drosophila at λ/20 super-resolution”, iScience14, 164-170 (2019).

彩色相機一直以來感光的極限都受限於因為要彩色成像,需要有不同的感測區塊加上濾片來測不同顏色的光,所以每個像素上的光很多都被浪費了。

彩色相機一直以來感光的極限都受限於因為要彩色成像,需要有不同的感測區塊加上濾片來測不同顏色的光,所以每個像素上的光很多都被浪費了。