文/曾吉弘(CAVE教育團隊)

最近溫度屢破新高,還是做一台機器人幫您分勞解憂吧!本期CAVE的App Inventor機器人專欄延續了七月號的[單點觸控],但這次要請您使用左右手的姆指來控制樂高機器人,左手拇指控制機器人左側馬達正反轉動,右手就是右側馬達囉。本範例使用了兩個畫布Canvas元件,分別追蹤畫布上的觸控點的Y軸向變化量後轉換為馬達電力。因此相較於[單點觸控]還用到了atan、sin與cos等三角函數,本次的程式相較之下簡單多了。

圖1 使用左右手拇指在螢幕上滑動。

首先請把NXT機器人準備好,並將左側馬達接在NXT的輸出端B,右側則是輸出端C(註1)。請確認NXT主機的藍牙是啟動的,接著將NXT主機與Android手機進行藍牙配對(註2),完成之後就可以把機器人放到一邊了,啟動藍牙之後您可以從NXT主機的螢幕左上角看到藍牙的符號。

接下來依序介紹程式的各個功能:

STEP1 登入畫面:

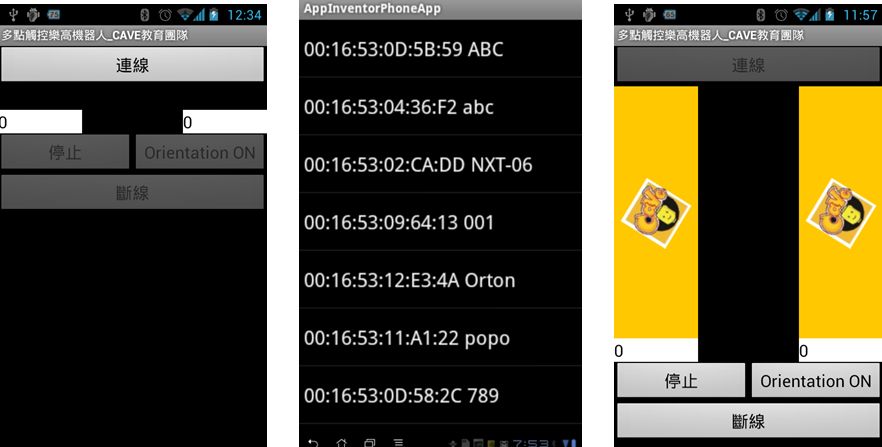

首次進入程式的畫面如圖2a,這時觸控板被隱藏起來了,只有 [連線]按鈕可以按,其它所有按鈕都無法操作。點選[連線]按鈕後進入藍牙裝置清單(圖2b),請找到剛剛配對完成的NXT主機名稱(本範例為abc),點選之後就會由Android裝置對NXT主機發起藍牙連線。順利連線成功的話,就可以看到兩個黃色的觸控板出現了,還有可愛的CAVE小圖案(圖2c)。

圖2a(左) 程式首次執行的畫面

圖2b(中) 點選連線按鈕後進入藍牙裝置清單

圖2c(右) 連線成功後出現觸控板

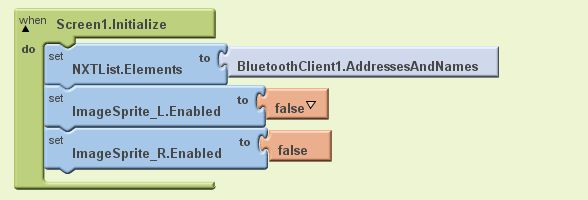

STEP2 程式初始化:

接著是在程式初始化(Screen1.Initialize事件)時,將NXTList清單指定為藍牙配對裝置清單(圖3a)。在連線之前之所以無法看到黃色觸控板,是因為我們先將它隱藏起來了,要等到連線成功之後(圖3b)才會顯示觸控板,原本無法按下的「停止」、「Orientation ON」以及「斷線」等按鈕這時也都可以操作了。

圖3a 指定藍牙配對裝置清單並隱藏觸控板。

圖3b 連線成功後開啟觸控板。

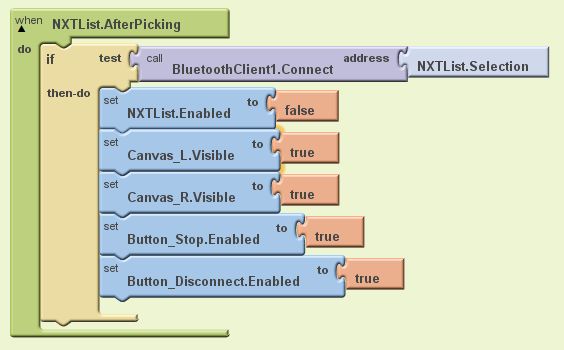

STEP3 根據方位感測器來旋轉CAVE小圖案:

本次程式多了一個附加功能,就是讓CAVE小圖案根據手機的指向來轉動,這是藉由擷取Android裝置上的方位感測器(Orientation sensor)的Z軸數值所完成的。只要方位感測器的值發生變化,azimuth這個變數就會自動更新,我們將它指定為CAVE小圖案的指向欄位就可以了(ImageSprite_L.Heading與ImageSprite_R.Heading)。

圖4 根據方位感測器值來改變小圖案指向。

STEP4 計算馬達電力:

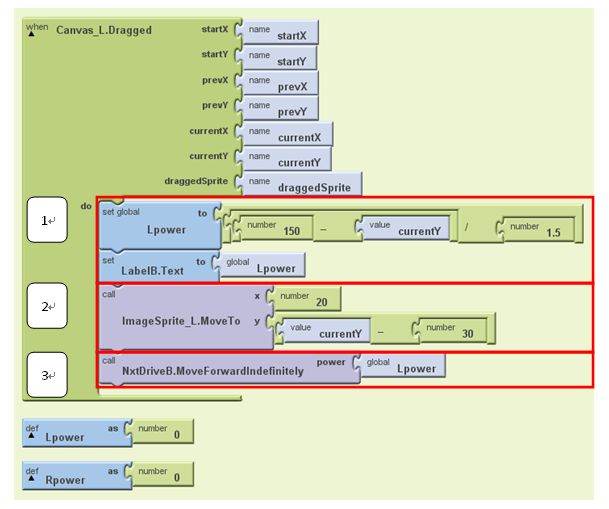

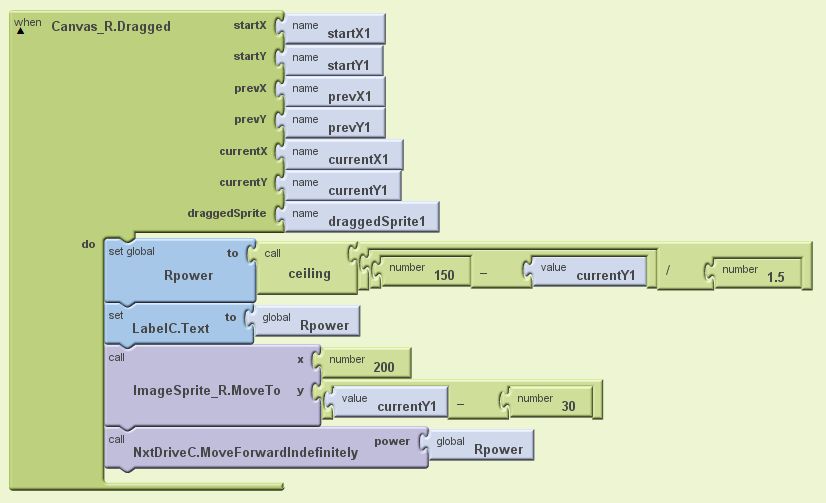

我們使用了兩個Canvas,分別控制機器人的左右兩顆馬達。由於兩側的觸控程式概念是相同的,在此僅說明左側的Canvas_L.Dragged拖拉事件:

1.將Lpower設為(150-CurrentY) / 150,CurrentY就是觸控點的Y座標,Canvas的高度為300像素,這樣一來當手指頭在畫布中央時,Lpower為0,向上移動為正,向下則為負。接著將Lpower數值顯示在標籤LabelB上。

2.使用ImageSprite.MoveTo指令,將XY欄位指定為20與CurrentY-30,這樣就能用手指拉著可愛的CAVE小圖案走。CurrentY-30的原因是因為CAVE小圖案的尺寸為60 x 60,需要30像素的修正量。

注意:由於本範例只使用觸控點的Y軸向變化,因此將X欄位固定為20,即便您左右移動姆指,CAVE小圖案也不會移動。

3.最後將B馬達電力指定為Lpower變數值就可以了,這樣當我們在黃色觸控板上移動左手拇指時,B馬達就會轉動,向上移動為正轉,向下則為反轉,手指頭離螢幕中心愈遠轉愈快。

圖5a 左側Canvas.Dragged拖拉事件。

圖5b 右側Canvas.Dragged拖拉事件。

注意:在右側拖拉事件中我們多使用了一個ceiling四捨五入指令,將計算結果直接取整數。您可以從圖9a~圖9c中看到沒有使用ceiling指令的Lpower值是會有小數點的,Rpower則無小數點。

STEP5 開/關方位感測器

覺得CAVE小圖案轉來轉去有點頭暈嗎?新增一個Button_Orientation按鈕來開/關方位感測器(OrientationSensor1.Enabled指令),一旦方位感測器被關閉之後,小圖案就會自動歸正(Heading欄位設為0)。請注意,在此我們只是設定方位感測器是否可用,您還是可以拉動CAVE小圖案來控制機器人。

圖6a 藉由Button_Orientation按鈕來開關方位感測器。

圖6b 方位感測器開,CAVE小圖案會根據手機指向而轉動。

圖6c 方位感測器關,CAVE小圖案自動歸正。

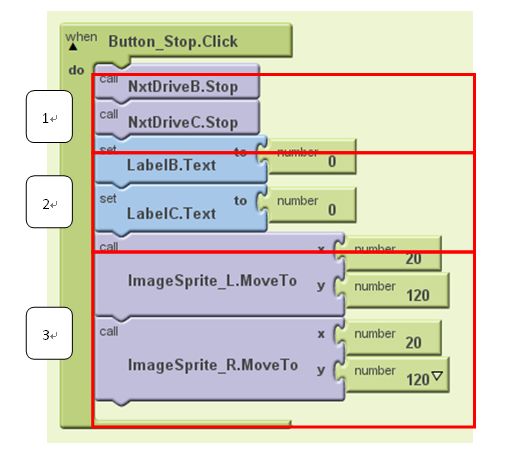

STEP6 按下停止按鈕:

按下[停止]按鈕之後,會執行三件事:1. 停下機器人;2. 將標籤數值歸零以及3. 使兩個CAVE小圖案歸位。

圖7 按下停止按鈕停下機器人並使ImageSprite歸位。

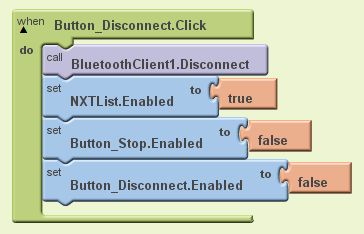

STEP7 斷線:

按下[斷線]按鈕之後,會中止藍牙連線(BluetoothClient.Disconnect指令),並使按鈕恢復到未連線時的狀態,黃色的觸控板也看不到了。這時候您可以再次發起連線。

圖8 按下[斷線]按鈕時中斷藍牙連線。

操作:

實際執行的時候,請先確認NXT已經開機且藍牙也啟動了。接著在您的Android裝置上點選程式畫面中的「連線」按鈕,會進到如圖2a的藍牙清單畫面,點選NXT主機名稱連線成功後就會出現兩個黃色觸控板。分別在畫面上移動左右拇指就會讓機器人動起來了,操作方式相當直覺,您一定會喜歡。從觸碰板下方的標籤看到左右馬達的電力值,範圍是-100~100之間。操作過程中您可以隨時點選Button_Orientation按鈕來開關方位感測器。

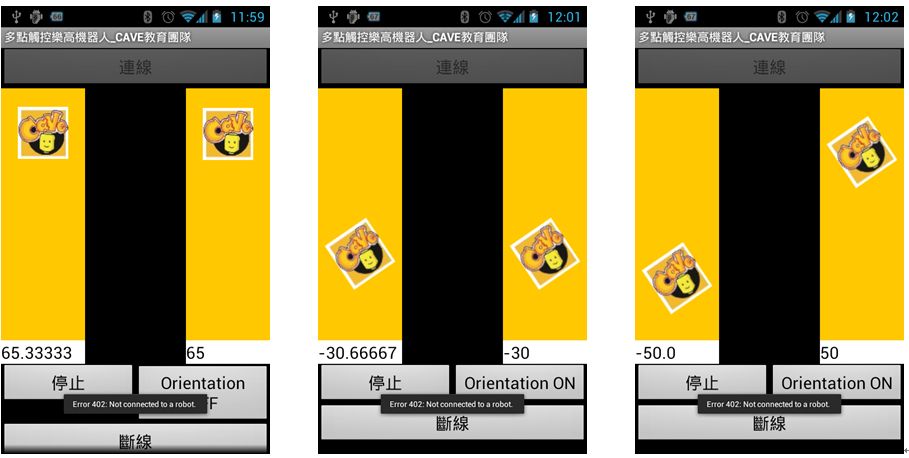

圖9a 兩個姆指同時往上,機器人前進(方位感測器關閉)。

圖9b 兩個姆指同時往下,機器人後退(方位感測器開啟)。

圖9c 兩個姆指左下右上,機器人原地右轉(方位感測器開啟)。

絕大部分的Android裝置都有多點觸碰的功能,因此我們特別以兩次專欄來介紹如何以單點與雙點來控制樂高機器人的動作。雙點觸控其實只取個別觸控點的Y軸變化,因此程式結構上是比較簡單的。本範例另外新增了方位感測器來使CAVE小圖案跟著手機指向旋轉,我們也可以使用Android手機上的感測器來控制機器人,請繼續注意CAVE的機器人專欄唷!

歡迎大家從這連結下載本程式來玩玩看

或掃描以下的QRCode也可以唷!更多有趣的機器人app請在Google Play搜尋「CAVE教育團隊」就找得到了。

註1:機器人運動方向有可能因為車頭指向而和程式設定相反,只要將左右馬達電線互換即可。

註2:將Android手機設定為可安裝非Market下載的程式以及讓手機與樂高NXT主機連線等說明請參考連結。

註3: 與NXT連線後如果出現[Error 402]之錯誤訊息請不必理會,程式依然能正確執行。

文章原文刊載於《ROBOCON》國際中文版2012/9月號