- 作者/施奇廷|東海大學應用物理學系

起源

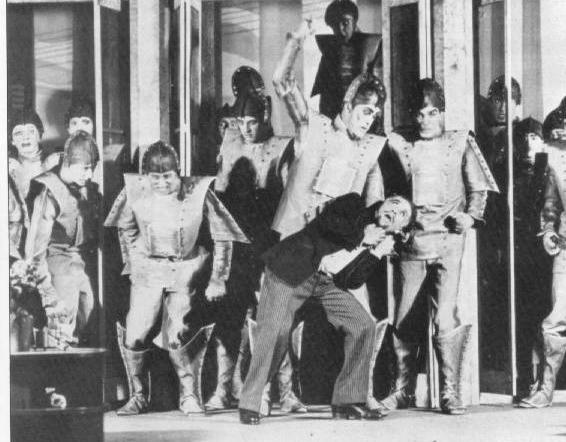

從 1920 年「羅梭的萬能機器人」(Rossum’s Universal Robots,通稱R.U.R.)登上舞台以來,「機器人」這個概念,一直是科幻作品中的常客。機器人「具有人的形象,而(在某些方面)具有比人類更強的能力」的設定,一直刺激著人類的想像力:能力強大卻又聽命於人類的忠實僕人;或是領悟到自己其實可以取代人類,成為下一代的地球霸主?樂觀的期待與被反噬的恐懼,向來是欣賞以機器人為主題的科幻作品的兩大樂趣。不過近十年來「人工智慧」(Artificial Intelligence)與「機器人學」(Robotics)的發展速度超乎預期,上述本來只存在於科幻作品中的兩面議題,突然變得不是那麼遙不可及。

提出「機器人學」這個名詞,並將理論系統化的,並不是工程領域的學者,而是科幻小說大師艾薩克‧艾西莫夫(Isaac Asimov),這個詞現在已經成為工程界對機器人科學的正式名稱,是一個從科幻對科技「逆輸入」的有趣案例。生於俄羅斯的艾西莫夫的本行是就科學家(專長是生物化學),曾經任教於波士頓大學醫學院,不過後來因為全力投入寫作,不再進行一般學者的教學研究工作,但是波士頓大學仍然保留他的職位。他所接受過的嚴謹科學訓練,也反映在作品中。1940 年,年方 19 歲的艾西莫夫就發表了第一篇機器人短篇小說「小機」(Robbie,收錄於短篇小說集「我‧機器人」),開啟了「機器人系列」的序幕。

法則

「人類製造的機器人結果反過來支配人類」這個命題可說是充滿「為何要搬磚頭砸自己的腳」的矛盾,因為人類絕對可以在一開始設計、製造時就預防這件事發生。不過睽諸人類科技發展的歷史,這種矛盾其實一直存在,也不斷發生,目前我們面臨的「核能科技的發展衍生的核子大戰威脅」、「高度工業化生產導致環境污染」,以及「大量使用石化燃料導致全球氣候變遷」這些問題,都是現在進行式。

不過「人類依照自己的形象打造的仿人類」又有點不同,高功能的機器「外型像人」這件事,足以引起人類的「科學怪人情結」,讓人類會對機器人的發展保持高度的戒心,在此思考下,1942 年時,艾西莫夫在他的作品中,比照「牛頓運動學三定律」的規格,揭示了「機器人三定律」:

一、機器人不得傷害人類,也不能坐視人類受到傷害

二、在不違反第一法則的前提下,機器人必須保護自己的安全

三、在不違反第一與第二法則的前提下,機器人必須執行人類的命令

這三大法則是在機器人出廠時,就內建於其軟硬體內,絕對不容違反。如果讀者是「理科人」的話,大概會覺得這三大法則邏輯簡單明瞭,簡直無懈可擊,在此控制下,機器人應該可以成為人類最忠實的僕人,無須擔心他們會叛變了。

有趣的是,在艾西莫夫的機器人短篇小說中,幾乎都是在探討「會引起三大法則的缺陷、迷惑、矛盾的可能情境」,所以幾乎每篇小說都會產生一個「精神錯亂」的機器人。這些小說非常有趣,推薦喜歡「燒腦型作品」的讀者一讀。

這個系列作品的內容其實也部分反映了人性:人也是又內建「道德基準」(moral norms),能進行邏輯思考的動物,但是即使最理性冷靜的人,也是會碰到兩難的困境,例如著名的「電車難題」:「一輛失控的列車在軌道上急馳,在軌道上有五個人即將被碾過,你剛好在鐵軌的轉軌器旁邊,只要扳動轉軌器,就可以把列車轉向另一條軌道,但是另一條軌道上有一個人,本來不會有事,因為你將列車轉軌而會被碾斃,在這個狀況下,你到底要不要將列車轉軌呢?」幾十年來這個問題引起了許多哲學以及倫理學、社會學的廣泛討論。事實上,自動駕駛汽車(除了不具有人形之外,其實也算是機器人的一種)的設計就必須把這類情境納入考量。

就筆者的「理科腦」來看,這些矛盾的起因是「機器人定律與人類的道德準則是定性的,而實際情境卻是定量的」。例如兩個人類同時對一個機器人下命令,而這兩個命令互相矛盾,那麼這個機器人到底要聽誰的?這時候機器人必須對下命令的兩個人做出「定量上的評價」,決定執行哪一個命令。這個結果導致「機器人可以(必須)評價人類,將人類分出等級」,之後又會衍生出更多的問題…

1985 年時,在機器人系列故事四十餘年的發展之下,艾西莫夫被自己的筆下的故事逼得追加了一個「第零定律」,位階在原來的三定律之上:「機器人不得傷害『整體人類』,或坐視『整體人類』受到傷害。」,這下子定律的規格從「牛頓三定律」變成了「熱力學的零+三定律」了,不愧是正統派科學家出身!這個第零定律跟之前一樣,從邏輯上看起來也很合理,但是這又造成機器人必須評價「整體人類」的福祉是什麼,由於第零定律凌駕於第一定律之上,因此視情況機器人是可以為了避免整體人類受到傷害,而去傷害甚至殺死個人的,最後可能會演變成「機器人為了整體人類好而接管、控制人類社會」的反烏托邦結果。

不過或許是因為「機器人叛變」這個展開實在太過顯而易見,而且因為可以塞進許多動作場面而成為影視作品愛用的題材,艾西莫夫的機器人作品中對這方面反倒是著墨不多,而是將關心的焦點放在「機器人是否能在三定律的規範下,活出自己的人格?」這個主題的代表作,就是獲得 1976 年「雨果獎」與「星雲獎」雙料大獎的中篇小說「雙百人」,後來在 1992 年由令一位作家羅伯特‧席維伯格(Robert Silverberg)擴充成長篇小說「正子人」;這個故事也在 1999 年改編為電影「變人」,由已故的喜劇泰斗羅賓‧威廉斯(Robin Williams)主演。

說實在的,想要瞭解「機器 → 人形機器 → 機器人 → 人」的演進與思辯,而又沒有很多時間與耐性的讀者,看這一本就夠了。

分流

前面花了相當的篇幅講了艾西莫夫的機器人觀,除了這個「大師典範之外」,其實幾十年的科幻與娛樂文化演變下來,機器人也了更多的樣貌。

好萊塢電影與日本動漫畫,是目前全球影視娛樂的兩大主流,當然兩者還是有一段差距,好萊塢挾其資金、人才、技術的實力,最為強勢;不過「小本經營」的日本御宅文化,在全世界的影響力也逐年提升,對好萊塢電影也產生了不小的影響。它們對於機器人這個主題的處理,有很大的不同。以下分成不同的機器人類型討論,不過要先說明的是,以下的分類有些是好萊塢電影擅長的題材,有些則是日本動漫畫的偏好,但是其實並沒有這麼涇渭分明,大部分在兩邊都有出現,只是多寡有別。

一、近未來,覺醒的機器人,成為人類之敵——好萊塢電影的機器人,跟艾西莫夫的機器人類似,是外型、尺寸都比照人類,並且具有不同程度的人工智慧。不過如前所述,好萊塢電影中的機器人有許多都是扮演「人類之敵」的大反派,完全不受艾西莫夫「機器人三定律」的節制,最經典的例子就是「魔鬼終結者」系列,劇中的機器人存在的目的就是用來追殺人類——可說是把「機器人三定律」完全反過來看就行了。這些機器人的背後是由一個名為「天網」的人工智慧,也可以說是個不具人形的機器人,本來是美國研發的國防電腦系統,後來這個系統產生自我意識,並且判斷人類才是「世界最大的威脅」,於是就發動核戰毀滅人類,並且持續掃蕩殘存的人類反抗軍,並且派遣機器人穿越時間回到過去殺害反抗軍領袖的母親以斬草除根。

相對於艾西莫夫小說中以「機器人三定律」來節制機器人的能力,以消除人們的「科學怪人情結」,努力讓人類社會接受機器人;「魔鬼終結者」系列是反過來喚起觀眾的「科學怪人情結」,再加上「末日電影」的背景設定,來營造危機感與戲劇性,然後在人類與機器人的對立下順理成章的大打出手,「拳腳與槍砲齊飛,鮮血共煙硝一色」,讓本來是「低成本 B 級動作片」的「魔鬼終結者」成為娛樂性與思想性兼具的成功作品。就這個視角而言,「駭客任務」中的架構與設定,以及成功的要素也頗有共同之處。

二、遙遠的未來,機器人已經融入人類社會,共同面對更廣闊的星際世界——上述這種「人類與機器人的衝突與生死戰」的背景通常發生於「近未來」,故事舞台跟現代有相當程度的重疊,機器人進入生活的正面與負面效應,都比較能引起觀眾的代入感。如果是以「遙遠的未來」為背景,機器人與人類之間的「磨合陣痛期」已經過去,像是兩大名門「星際大戰」與「星際爭霸戰」,人類的足跡已經遍佈銀河系,見識過各種稀奇古怪的外星生命體,機器人也早就已經成為人類好伙伴,甚至被視為跟人類同等的存在了。

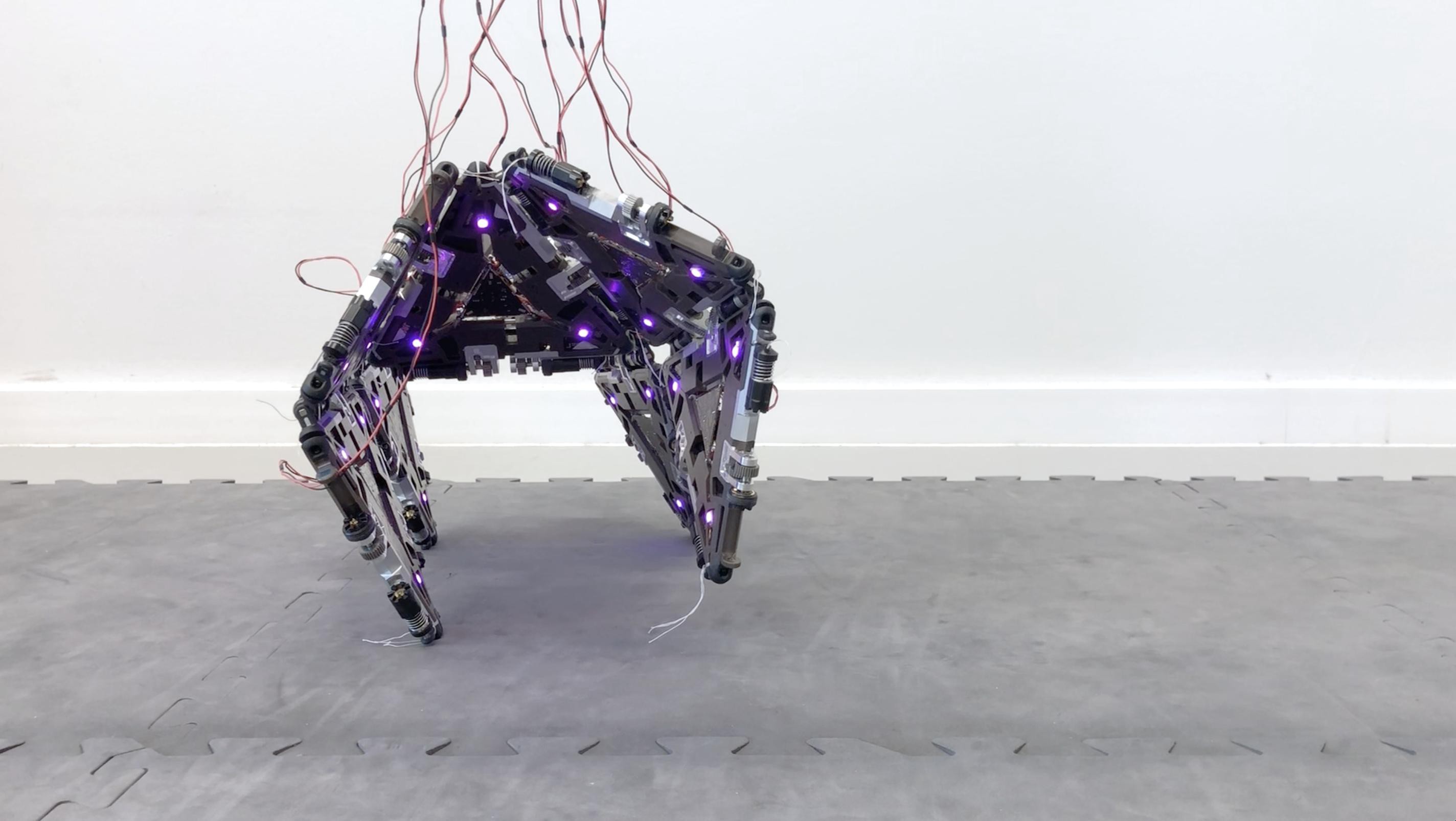

三、機器人是人類肉體的延伸,力量的放大器——另一方面,日本動漫畫作品中的機器人,除了早期的「原子小金剛」是走「真人的大小與外貌,且具有人工智慧」的路線以外,主流是象徵「人類力量的延伸」的「巨大機器人」類型。這種機器人不具有人工智慧,而是搭載操作界面與作業系統,由人類駕駛員來操作,相當於扮演其大腦的角色。以早期的名作「無敵鐵金剛」而言,所標舉的主題是「如果人類透過機器取得了巨大的力量,將會成為神?還是成為惡魔?」,這類作品有別於西方「機器如何變成人」,而是「人類與機器合為一體」的概念。

機器人是吸引目標觀眾目光的賣點,也是贊助或出資廠商販賣模型玩具的獲利神器,導致許多巨大機器人動畫作品一味強調機器人造型帥氣而不注重劇情內涵,被譏為「為了販賣玩具所製作的 30 分鐘廣告片」,不過由於出資者只要求「機器人玩具賣得好」,對於內容不太有興趣干涉,反而讓創作者有揮灑的空間,出現了「長濱忠夫三部曲」、「機動戰士鋼彈」等名作。1995 年的「新世紀福音戰士」,把前述「人類與機器合為一體」的概念推到極致,駕駛員是透過神經系統直接與機器人(稱為 Evangelion,簡稱 EVA )「同調」連結,以精神力取代操縱桿與按鈕,直接操控 EVA——不過其實 EVA 與其說是機器人,「生化」味更重一些,劇中還曾出現駕駛員與 EVA 機體「完全融合」的情節。

四、機械化的人類——人與機器的關係,除了「機器→人形機器→機器人→人」這條路線外,也有反方向的路徑:由於疾病或受傷而失去部分身體功能的人,利用科技的力量改造身體,恢復正常的功能,甚至更為強大,這種被部分改造的人類稱為「改造人 Cyborg」(cybernetic organism),結合了「模控學」與「有機體」兩個字,也有人翻譯為「生化電子人」、「半機械人」,後來乾脆直接音譯為「賽伯格」。其實許多現實世界的人類已經多多少少變成改造人了:義肢、人工水晶體、心律調節器、人工關節等等,人們已經普遍可以接受為了維持身體機能以侵入性的方式改造部分器官,未來可以預見改造的範圍與精密程度必定會逐漸提升。

在這個「人體改造」的延長線上,我們可以看到像「機器戰警」中,殉職的員警被改造並且復活來執行正義,「鋼鐵人」受傷後在自己的胸腔裝了一個反應爐,成為裝甲動力服的能量來源;日系作品方面,有「無敵金剛 009」(後來改名為「人造人 009」,少了一股中二的氣勢)、「假面騎士系列」(真人演出的特攝片),這些作品中,並非前述因為疾病或受傷而修補人體,而是為了培養「征服世界用的超級士兵」,而將人體改造成具有超越一般人能力的戰鬥道具。

與「機器人覺醒為人類、或自覺為超越人類的存在」的方向相反,在「改造人」這條線上會出現的問題則是「當人類持續被改造,被機械取代的部位越來越多,會不會因此變成『不是人類』?這個轉變的界線何在?」也是非常值得探討的問題,也讓「改造人」這類的作品更具有思想上的深度。

近年來日本動漫畫與好萊塢合流的作品逐漸增加,「攻殼機動隊」與「戰鬥天使艾莉塔」是其中翹楚,都是以「改造人與人類的分界線」,以日本原創的動漫畫作品為主題,結合好萊塢的資金與技術的大製作電影,都獲得了相當程度的成功。

交會

本文以包含小說、電影、動漫畫等科幻作品的角度來看「機器人與人」之間的關係。雖然不是從真實世界的科學與技術來進行嚴謹的探討,不過在「機器人與人」這個主題上,科技與科幻的發展路徑其實亦步亦趨、互為因果:如同艾西莫夫的「機器人學」與「機器人三定律」對真實世界的機器人科技有極大的影響一般,科幻的想像有可能成為引導科技發展的路標;相對的,科技的發展當然也會墊高科幻作品的根基。

前文我們看過了幾種「機器人與人」的類型作品:從機器人變成人、機器人與人共存、機器人與人合體、從人變成機器人。這幾種模式,各自以不同的視角來刺激我們思考「人到底是什麼」這個問題。從數十年來這個主題的科幻作品的發展看來,不論是從哪個角度切入,最後都指向一個共同的交會點:人類的大腦。

「正子人」中的機器人主角「安德魯‧馬丁」要爭取在法律上被認可為「人」,其起點是他的「正子腦」產生了類似人腦的感情、創造力、以及自我意識的自覺,在其兩百年的生涯中,他的「鉑銥合金正子腦」的運作模式與人腦越來越接近,應該可以通過任何像「圖靈測試」這種「能分辨人腦與電腦差別」的考驗。而他克服爭取成為「人」的最後阻礙的方式是:改造他那相對於人腦幾乎算是不朽的正子腦,讓它像人腦般會逐漸老化與死亡,終於取得了「人」的資格。

另一方面,「從人變成機器人」的這條路上,也是以「大腦是不是原裝貨」來作為人類與機械的分界點。身上的器官怎麼更換都沒關係,但是這個人的「自我」(identity)只存在於大腦的神經元之間的連結以及在內部儲存以及傳送的資訊中,如果大腦被換掉、或是內部的資訊消失了,這個人也將不再存在。更激進的說法是,連大腦的「硬體」都不重要,只有內含的資訊才是「人的本體」,所以只要能夠把腦內的資訊保留、複製下來,人將可以成為不朽的存在,就像「攻殼機動隊」的主角草薙素子,拋棄了已經多次改造的肉身,以及還是「原裝」的大腦,將腦內資訊轉進網路中,只要這個網路仍在運作,這組來自草薙素子大腦的資訊仍存在於這個網路中,她就相當於取得了永生。

回到現實世界,「人工智慧」與「腦科學」正好也是目前最熱門、進展也最快的科技領域,前者致力於「讓機器除了強大的計算與記憶能力之外,還能像人腦一樣能進行複雜的思考」,後者則是要「瞭解大腦如何學習、記憶、創造,以及人類的自我意識從何而來」,這兩個領域發展的進程與細節跟科幻作品當然不會一模一樣,但是在大方向上,「科學」與「科幻」實在有驚人的相似之處,最後兩個領域也有可能交會在同一點上。

看看社群網站的自動審查機制,以及電子商務網站的推薦系統,極權國家用來監控人民的社會科技體系,「不具人形的機器人」正逐漸接管我們的生活。也許在我們的有生之年,就可以看到這些科幻名作中的情節在現實世界中發生,至於人與機器人之間的關係,是對抗、共生、還是融合?人類社會未來的流向,仍然掌握在人類手上嗎?再不嚴肅思考這個問題,或許很快就會來不及了。