- 作者 / 慕容峰 │ 從事數位鑑識工作多年,在分析證物的過程中,彷彿側耳傾聽證物娓娓道來一般,同時審慎客觀地仔細分析察看,即便是旁枝末節也不輕易放過,浸淫其中而樂此不疲。

智慧型手機已然成為人們生活中不可或缺的一部份,舉凡記事、行程提醒、影音娛樂、購物消費、社群聊天、導航等等,皆可一機搞定滿足食衣住行育樂各種需求。

正因為如此,我們使用智慧型手機過程中所留存的各種資訊,其實就約等於使用者日常生活的紀錄。

試想看看,倘若鑑識人員可以拿到嫌疑犯的智慧型手機(以下簡稱為手機),是不是就可以知道找出嫌疑犯的各種生活小細節呢?由此可知,手機的取證,已經逐漸成了犯罪調查的重中之重。

只要能有效提取手機裡的各項跡證,便有助於釐清有無與案情相關之處!

犯罪調查中的重點:智慧型手機!

對鑑識人員而言,雖然手機與電腦同樣都可以當作證物,卻有著很大的差異。

桌機、筆電的硬碟是可以拆卸的,然而手機是使用快閃記憶體(Flash)來儲存資料,而且直接焊在電路板上,再加上手機只有一個 USB 埠可資利用的情況之下,如何自手機中提取跡證,便成了鑑識人員的一大挑戰。

首先,打開手機與工作站的 USB 通道!

為了保護手機的資料安全,手機廠商通常會限制 USB 連線後的權限,也就是說,當我們將手機用 USB 連上工作站(電腦)時,工作站無法馬上直接識別手機,也無法讀取手機裡面的資料。

因此當鑑識人員使用 USB 將手機連上準備好的工作站後,第一要務便是要讓手機可被工作站順利識別,建立手機與工作站之間的基礎信任關係,不然就什麼也做不了,更別說提取資料了。

- 為了方便說明,在此我們先將情況簡化,假設鑑識人員非常幸運,拿到的手機沒有被鎖定。

這個時候,鑑識人員可以視情況在工作站安裝手機的驅動程式,接下來,讓手機透過 USB 連上工作站,並在手機中的「設定」中找到「開發人員選項」,開啟「USB 偵錯」功能,打開手機與工作站之間的 USB 通道。

拿來控制手機的「遙控器」:ADB

打開通道然後呢?鑑識人員究竟要怎麼做,才能提取手機內的資料?在此,我們就不得不先談談所謂的 ADB 啦! ADB 是 Android Debug Bridge 的縮寫,它就像是工作站拿來掌控手機的遙控器,當我們透過 USB 把手機連接到電腦後,就可以利用 ADB 的指令來控制、調教這一支手機。

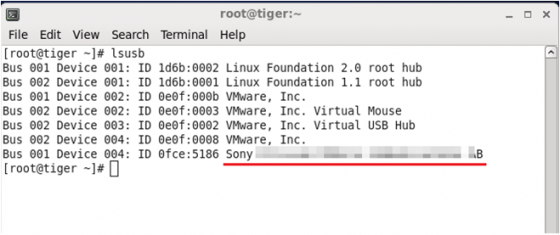

完成這些步驟後,鑑識人員可以在工作站執行 ADB 的指令「lsusb」,來測試看看工作站有沒有辦法辨識 USB 裝置,如果執行獲得如下圖結果,就表示有順利辨識出連接的 USB 裝置。

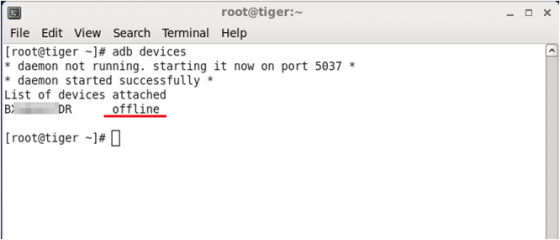

接著,我們執行指令 adb devices 以查看手機目前的狀態。

建立手機跟工作站之間的基礎信任關係!

執行結果如下圖所示,圖中「BXXXXXDR」這個值,就像是手機在電腦中的裝置名字(識別值),手機的狀態為後面的「offline」 ,意即「離線」的意思。

咦?剛剛不是已經接好了 USB 了嗎?為什麼手機的狀態還是離線呢?這時候我們必須將視線移開工作站的螢幕畫面,回頭看看手機螢幕上的動靜。

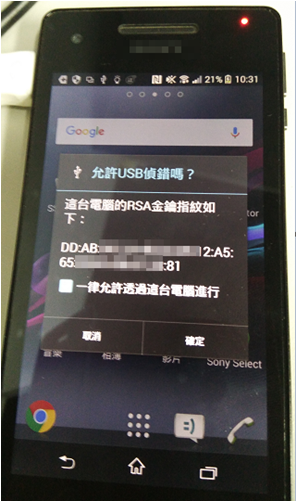

此時,我們可以發現手機螢幕上彈出了如下圖的警示訊息,為了能於此工作站上以 ADB 指令控制這支手機,並把資料提取出來,務必要勾選「一律允許透過這台電腦進行」並點擊「確定」,這樣才能讓手機跟電腦之間建立永久、有效的信任關係。

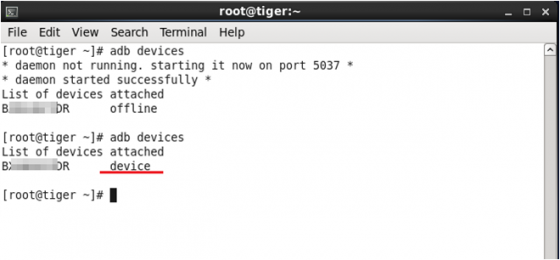

一旦完成之後,就可以再次執行指令 adb devices。所得到的執行結果如下圖所示,狀態值由「offline」變成了「device」,即代表電腦成功辨識手機,並處於正常開機模式。

由於信任關係已建立完成,在未撤銷的情況下,後續當這支手機再次接入此工作站時,便不會再次要求手機「允許 USB 偵錯」了。

你從來都不是手機心中「最重要」的人

接下來,鑑識人員要想辦法獲得手機的系統最高權限,讓工作站有權利提取手機的一切。

在這裡,要跟各位說明一件事,那就是「你未曾真正擁有過你的手機」。

各位想必不以為然,「手機的主人明明就是我,每天陪我吃喝拉撒睡,睡前、睡醒第一個看到的人都是它,它怎麼不是我的?」

但實情是,當各廠牌的手機一出廠,手機的預設環境都只是一般使用者環境,也就是說,你,只是這支手機的一般使用者,不是手機系統中的最高權限者。

為什麼廠商要這麼做?原因很單純,為了避免高昂的維修成本。

試想看看,如果每個使用者都擁有手機的最高權限,相對就有較高的機會將手機玩殘,一旦手機變磚(手機弄壞以至於完全沒反應),使用者就只能帶著它去找廠商幫自己擦屁股。廠商自然不樂見如此,因此,廠商在手機出廠時就會預設:僅讓使用者以一般權限帳號運行。

普通消費者在一般使用過程中,不太容易察覺到這件事情,只有某些非常規操作,像是「刷機」或「root」的玩家,才會用到比較高的系統權限。

提升你的地位,才能帶走手機的全身心

「提權」,意即將自己的操作權限由一般使用者提升至「系統最高權限」,造訪手機內部的任何路徑、存取手機的所有檔案。

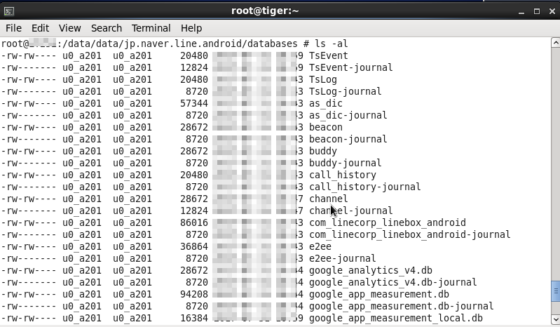

對於鑑識人員來說,提權就是取得重要跡證的關鍵,一旦擁有裝置的至高無上權後,就可以從手機中獲得嫌疑犯的詳細資料、相關罪證。例如,當鑑識人員來到 Android 手機的 App 所在路徑 /data/data/ ,執行「ls –al」指令,就可以順利列出了該路徑下的資料夾及檔案。

嫌疑犯與他人的通訊紀錄,時常也會成為重要的犯罪證據之一,倘若鑑識人員需要針對 Line 進行取證,便可在/data/data/路徑下查找是否有與 Line 相關的 「package name」,例如負責儲存 Line 相關資料的「jp.naver.line.android」資料夾。

當我們需要調閱 Line 裡面的聊天訊息時,鑑識人員會切換至「jp.naver.line.android」中的「databases」,裡頭便有著存放聊天訊息的關鍵檔案!

鑑識的奧義:永不言棄,突破手機的「心防」!

透過鑑識人員與手機之間的「攻心大戰」中,想必讀者們對於智慧型手機的取證有了初步的了解,一窺鑑識人員不斷攻略手機的生活。

儘管面臨著重重難關及挑戰,鑑識人員從不輕言放棄,在巴掌大小的手機之間攻城掠地,力求掌握提取跡證的關鍵契機,為還原真相及打擊犯罪貢獻一己之力。