電影裡要描寫科學家,就讓他們穿白色實驗衣在實驗室和辦公室走來走去。可是現實中,如果我平時沒事就這麼做,同事和學生只會想說我是不是很後悔當初沒去唸醫科,然後忘了吃藥了 Orz

近年有不少描述科學家「真實」生活的電影或影集,如《模仿遊戲》(The Imitation Game)、《愛的萬物論》(The Theory of Everything)、《天才無限家》(The Man Who Knew Infinity) 和《關鍵少數》(Hidden Figures)、《世紀天才》(Genius) 等等。

這些科學家的傳記能夠搬上大銀幕,當然是因為他們的故事非常戲劇化。即使是大部分諾貝爾獎得主的生平要搬上銀幕,大概只有他們在實驗室裡長時間玩弄不知名的儀器、長時間在辦公室裡讀文獻和打字、或者在課堂中上觀眾完全聽不懂的課⋯⋯

然而,人生的真實狀況有時間是比電影中還鬼扯,以致於編導都不敢照本宣科地搬上大銀幕,以免被影評奚落是亂灑狗血;至少,扣掉電影中那些為劇情發展而弄出的橋段,這些了不起的科學家,他們在人生中和科學上的豐富程度,是電影或影集都難以刻畫的,況且電影常為了製造張力討好觀眾而虛構重要劇情。

誰是艾倫‧圖靈 ?

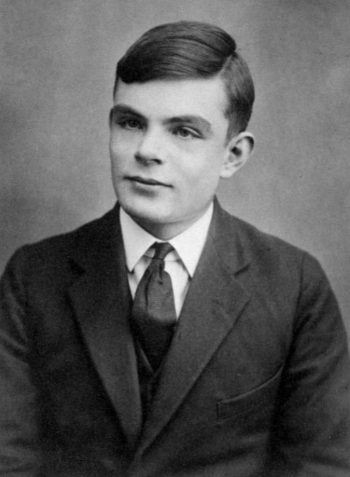

如果沒有《模仿遊戲》的主角艾倫‧圖靈 (Alan Turing,1912-1954),電腦也應該還是會誕生,只是不知會晚多久。如果沒有他在第二次世界大戰期間加入布萊切利莊園 (Bletchley Park) 的團隊,破解了德國的密碼,二戰應該仍會結束,但也不知會晚多久,還會有多少寶貴的生命犠牲。如果他沒有因同性戀問題事發,受迫在當時英國法令規定下,被化學閹割後不久在身旁留下一顆毒蘋果自殺身亡,今天的人工智慧可能又會提前多早誕生?

他也提出著名的圖靈測試(Turing test,又譯圖靈試驗),是於 1950 年提出的一個關於判斷機器是否能夠思考的著名試驗,測試某機器是否能表現出與人等價或無法區分的智能。

圖靈測試內容是,如果一個人(代號 C)使用測試對象皆理解的語言去詢問兩個他不能看見的對象任意一串問題。對象為:一個是正常思維的人(代號 B)、一個是機器(代號 A)。如果經過若干詢問以後,C 不能得出實質的區別來分辨 A 與 B 的不同,則此機器 A 通過圖靈測試。

如此可見,圖靈是超越他時代的天才,不僅是位科學家也是位思想家,更是位真誠地面對自己的人,他的一生有許許多多值得我們深思的創見!

要認識艾倫‧圖靈這位真正了不起的科學家,一位讓我們對人類心靈和智能深入思考的科學家,影響力甚至超越科學,也給了哲學、藝術和文學等領域不少啟發,他那偉大又悲劇的偉人戲劇化的一生,《艾倫‧圖靈傳》(Alan Turing: The Enigma) 是最權威的傳記,沒有之一。

圖靈的父親朱利斯·麥席森·圖靈 (Julius Mathison Turing) 是一名英屬印度的公務員。1911 年,圖靈的母親在印度的懷了孕。因為他們希望艾倫在英國出生,所以回到倫敦,住在帕丁頓 (Paddington),並在那裡生下了艾倫。

父親的公務員委任使他在艾倫小時候經常來往於英倫和印度。由於擔心印度的氣候不利於兒童成長,他便把家庭留在英倫與朋友同住。圖靈很小的時候就表現出他的天才,後來就更加顯著。1931 年,圖靈考入劍橋大學國王學院。1934 年他以優異成績畢業。1935 年因為一篇有關中心極限定理的論文當選為國王學院院士,畢業後到美國普林斯頓大學攻讀博士學位,花了僅僅兩年就大獲得學位。

1939 年圖靈被英國皇家海軍招聘,並在英國軍情六處監督下從事對德國機密軍事密碼的破譯工作。兩年後他的小組成功破譯了德國的密碼系統 Enigma,從而使得軍情六處對德國的軍事指揮和計劃了如指掌。但是軍情六處以機密為由隱瞞了圖靈小組的存在和成就,將其所得情報據為己有。據說,圖靈小組的傑出工作,使得盟軍提前至少兩年戰勝了納粹德軍。

圖靈提出的理論是劃時代和極具開創性的,發明了電腦科學和電腦的許多概念,啟發了後世的許多研究。我算是外行,有不少概念似懂非懂,可是電腦科學的真正高手,往往被圖靈提出的許多概念折服!

圖/wekipedia

天才圖靈不平順的人生

《艾倫‧圖靈傳》描繪出生動的圖靈,他還是一位世界級的長跑運動員。他的馬拉松最好成績是 2 小時 46 分 3 秒,比 1948 年奧林匹克運動會金牌成績慢 11 分鐘,要不是因為受傷,他可能真的參加了 1948 年奧林匹克運動會。

《艾倫‧圖靈傳》由的圖靈不造作,他沒有刻意隱瞞自己的性向,但圖靈因同性戀傾向而遭到的迫害使得他的職業生涯盡毀。1952 年,他和一名年輕的曼徹斯特男子交好,在那位同性伴侶協同一名同謀一起闖進圖靈的房子行竊時,英國警方的調查結果使得他被控以「明顯的猥褻和性顛倒行為」罪。《艾倫‧圖靈傳》指出,他沒有申辯,他並不認為自己有錯,並被定罪。

儘管他在科學上有極為卓越的貢獻,但還是在著名的公審訂罪後,被給予了兩個選擇:坐牢或雌激素注射「療法」(即化學閹割)。他最後選擇了雌激素注射,並持續一年。在這段時間裡,藥物產生了包括乳房不斷發育的副作用,也使原本熱愛體育運動的圖靈在身心上受到極大傷害。

1954 年,圖靈因食用浸過氰化物溶液的蘋果而死亡。很多人相信他的死是有意的,法官並判決他的死是自殺。但是他的母親極力爭辯他的死是意外,因為他不小心在實驗室里堆放了很多化學物品。

直到 2013 年 12 月 24 日,英國司法大臣才宣布英國女王伊莉莎白二世赦免 1952 年因同性戀行為被定罪的艾倫·圖靈。2015 年 2 月 23 日,圖靈的家人向英國首相府邸發出了一份超過 50 萬人簽名的請願書,要求英國政府赦免和圖靈一樣因同性戀而獲罪的人。2017 年 1 月 31 日,艾倫·圖靈法案生效,約近五萬位因同性戀定罪者被赦免。

電腦界諾貝爾獎:圖靈獎

為了紀念圖靈的偉大貢獻,電腦協會 (Association of Computing Machinery,ACM) 於 1966 年設立圖靈獎 (ACM A.M. Turing Award),專門獎勵對電腦事業作出重要貢獻的個人。設立目的之一是紀念這位現代電腦科學的奠基者。獲獎者必須是在電腦領域具有持久而重大的先進性的技術貢獻。大多數獲獎者是電腦科學家。是電腦界最負盛名的獎項,有「電腦界諾貝爾獎」之稱。

《模仿遊戲》的娛樂性多過知識性,如果你想知道一位劃世紀的天才在想什麼,問了麼了不起的問題,提出了什麼里程碑式的概念,可能還是好好讀讀《艾倫‧圖靈傳》才最實際!

本文原刊登於 The Sky of Gene。