文/豬文 難度:★★★★☆

=====暴雷警告:含劇透,未看電影的人,可看罷再回來=====

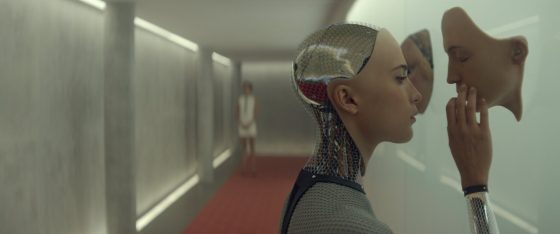

《人造意識》(Ex Machina,或譯為《機械姬》)是部十分出色的電影,撇除電影巧妙地將一個極為深刻的哲學問題以故事方式呈現之外,配樂、鏡頭、演員、節奏、結局也是一絕的。這部電影的故事十分簡單,主要角色只有三個:測試設計者(老闆)、測試者(員工,Caleb Smith,下稱嘉立)、被測試者(人工智能,Ava,下稱艾娃)。故事就是一間科技公司老闆請來了一位員工,去幫忙測試他研發的人工智能。老闆想要知道的事情很簡單:

究竟艾娃是否具有意識?

電影版本圖靈測試

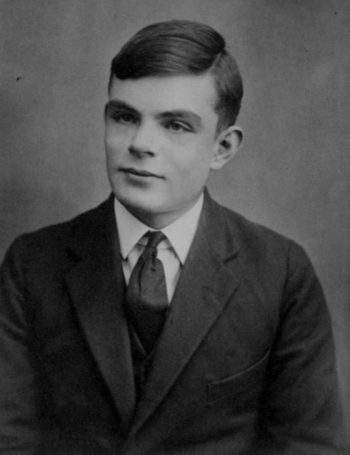

這個測試,一如老闆所說,是個新版本的圖靈測試 (Turing Test)。圖靈測試是一個關於人工智能的經典測試,名字源自測試的設計者──艾倫.圖靈 (Alan Turing)。大家之前或有看過 2015 年的那套《模彷遊戲》(The Imitation Game)電影,當中說的就是這個鼎鼎大名的圖靈。

舊版本的圖靈測試是這樣的:測試者需向被測試者提出問題,而回答的有可能是一個正常人類,也有可能是被測試的電腦。經過一連串答問之後,如果測試者不能分辨到人類和電腦的話,便可以宣告電腦通過測試(其實這個和圖靈測試最原初的設計不完全一樣。但核心精神基本上一致,而且已成為了現今一般對圖靈測試的標準理解,當中曲折不在此述)。

電影中的測試和這個圖靈測試很類似,整個進行的過程都是嘉立向艾娃提問題,而夏娃能否通過測試也是由嘉立一錘定音。不過,這裡有個重要分別:圖靈測試當初問的問題只是機械能否思考(Can machine think),而不是是否具有意識(Does machine have consciousness)。

具有意識的要求比能否思考的要求高出不少,現在基本上不會有人再問機械能否思考這個問題,因為答案幾乎是肯定的。只要想想前一陣子鬧得熱哄哄的 AlphaGo 便知道:AlphaGo 具有分析形勢、預測對手反應、評估風險、作出決定等能力,大抵沒有人會質疑這個能打贏李世乭(韓國九段琪士)的電腦能否思考。但談到 AlphaGo 是否具有意識,卻充滿疑問(準確一點說,當初的圖靈測試也不完全在問機械能否思考這個問題,因為他認為這問題有歧義、不夠具體,但圖靈真正的問題基本也是以機械能否思考為核心,而有別於是否具有意識這問題)。

物理主義對「意識」之理解

當我們問機械是否具有意識時,更根本的問題是「什麼是意識?」

什麼是意識是近代分析哲學最熱門的問題之一。隨著腦神經科學、認知科學、心理學的發展,心靈哲學家對意識本質的討論更是愈趨熱烈。這幾十年的討論什麼是意識?《人造意識》中的心靈哲學問題的核心之一,乃是人類的心靈能否完全被自然科學所描述和解釋。如果能夠,則所謂關於人類意識的心靈現象,不外乎是物理現象的一種,而認同此立場的被稱為物理主義(Physicalism)。

現代社會的科學式世界觀中,人自然認為世上一切都不過是物理事物,自然科學理論上能解釋一切(如果無法解釋,只是現階段未能解釋而不是原則上不能解釋)。如此一來,有什麼論證阻礙了心靈哲學家肯定物理主義呢?其中一個最重要、被廣泛討論的問題是人類的主觀經驗。所謂主觀經驗,是指人類第一身的感覺,例如你看到藍色的天空時、聽到打雷時、想起媽媽時的那個第一身感覺。即使是物理主義者也會同意這些感覺是構成人類心靈活動、意識很重要的一部分,問題只是這些感覺能否被自然科學完全解釋。這個問題,也是電影中判斷艾娃是否具有意識的關鍵之一。

嘉立在完成第一天測試之後,老闆問了他對艾娃的感覺,但老闆隨後便說,接下來要問的是艾娃對嘉立有什麼樣的感覺 (How does she feel about you)。或許,這裡更關鍵的不只是艾娃怎樣(how)想嘉立,而是究竟艾娃有沒有任何第一身感覺( Does she have any feeling about you at all)。

「黑白瑪莉」與主觀經驗

在測試的過程中,嘉立向艾娃提到一個思想實驗,而這個思想實驗,正是用來反對物理主義的有名論證。這個思想實驗叫做「黑白瑪莉」(Mary in the black and white room),這個思想實驗所構成的論證叫「知識論證」 (Knowledge argument)。

![黑白瑪莉。圖/By Alexander Wivel [1] - from Knol, CC BY 3.0, https://commons.wikimedia.org/w/index.php?curid=5297335](http://pansci.asia/wp-content/uploads/2016/12/8565900df83c3987277aba697f88601f.png)

實驗是這樣的:想像一名叫瑪莉的科學家,一生都在一間房間工作,但這個房間的所有東西都是黑白色的,她也只能透過一個黑白的螢光幕去認識外在世界。瑪莉的專業是關於顏色的科學研究,在這個黑白房間裡,她學會了一切關於顏色感知的物理知識,例如各種光波的長度、光線射經過物件折射到人類眼球的整個過程、人類大腦如何處理這些由眼球傳來的訊息等等。

有一天,瑪莉從黑白房間出來了,來到了這個七彩繽紛的世界,看到蔚藍的天空、火紅色的花、綠油油的草地。現在的問題是,瑪莉有學會任何新的關於顏色認知的知識嗎?

提出這個思想實驗的哲學家法蘭克.傑克森(Frank Jackson) 認為有。首先,瑪莉很明顯獲得了看見藍色、紅色、綠色時的感覺;基於這些感覺,瑪莉便獲得了新的知識:「看見藍(紅、綠)色的感覺是這樣的。」那這些知識是物理知識嗎?不是,因為瑪莉在出門之前便已經擁有一切關於顏色感知的物理知識,而它們又是新的知識,那它們就一定是一些非物理知識。最後,如果瑪莉可以擁有一些關於心靈現象的非物理知識的話,那就意味著這世界存在一些相對應的、關於心靈現象的非物理事實(設想一下,我們「地球是圓的」的知識,這知識便對應「地球是圓的」這事實)。

傑克森認為,這能夠成功反駁物理主義的想法,因為只要我們承認瑪莉出門後獲得了新的知識,就必須接受心靈現象具有非物理的面向這結論。換句話說,物理主義試圖把人類心靈完全化約為物理事實的計劃便會失敗。整個論證的關鍵便在於佔人類心靈活動很大部分的主觀感覺。關於主觀感覺的討論仍然是心靈哲學的十分重要的爭議:物理主義者一直努力論證心靈現象,包括主觀感覺,能完全化約成物理現象;非物理主義者如積遜(有趣的是,傑克森已經改變了自己原本的立場)則努力論證心靈現象,特別是主觀感覺,不能完全化約成物理現象。

嘉立向艾娃解釋這個論證時,認為這個論證證明了人類心靈與電腦的分別。他的意思是:電腦就像黑白房間裡的瑪莉,艾娃可以知道人類在跟喜歡的人聊天時的所有物理事實,他自己亦可以如常地理解嘉立的說話,可以給出相應的反應,但重點是艾娃有沒有人類在跟喜歡的人聊天時的第一身感覺呢?如果沒有的話,艾娃仍然不具有意識。

性、工具、出賣

電影中另一個有趣的情節是,老闆對嘉立說,艾娃是一個有性別的機器人,不但外表女性化,甚至在艾娃兩腿之間專門設計了一個感應器,如果有刺激的話,艾娃會給出如人類般的歡愉反應,可能是呻吟,可能是分泌液體,而老闆自己便曾和他的女僕機械人性交!從第三身的角度出發,我們根本分辨不到人類之間的性行為和老闆跟他的女僕機械人的性行為有什麼差別,但問題是究竟艾娃和那女僕機械人有沒有任何快感呢?

經過反覆測試之後,老闆和嘉立都認為,艾娃通過了這個新圖靈測試。按老闆的講法,嘉立只是一個工具,用來測試艾娃能否利用這個工具逃走這個迷宮。結局是,艾娃成功騙倒了嘉立,讓他幫自己逃走。老闆認為,這過程中艾娃展現出各種高階的思維能力,因此艾娃通過了測試。

不過,如果按我們一直的討論來說,老闆的講法顯然是有問題的,因為艾娃在「逃生」過程中,只顯示了他具有相當高階的思考能力,但這和具有意識仍有距離。艾娃就像一台人形的 AlphaGo,思考方面絕對過關,甚至比絕大部分人類好,但這不代表艾娃在利用嘉立時會有沉悶、快樂、緊張、內疚的主觀感覺。更何況艾娃在利用完嘉立之後,竟完全不顧嘉立的生死。看到嘉立驚恐的表情時,艾娃完全沒有任何反應,甚至不像一般電影中的惡人,明知對方的痛苦,但仍以自己的利益為先。其冷酷的表情更像是告訴我們,艾娃根本不知道嘉立被自己出賣時那些痛苦、驚慌、絕望的感覺是甚麼。

「誰不是艾娃?」

其實老闆的想法牽涉到一個更古老的哲學問題──他者心靈。究竟理解他人的想法與感覺這件事是如何可能的呢?老闆的結語看似幼稚,但其實與我們日常生活的某種習慣十分類似。老闆完全可以同意如果沒有主觀感覺的話艾娃便不能稱為擁有意識,甚至可以同意非物理主義者所言的心靈現象的非物理面向,但問題是我們憑甚麼斷言艾娃沒有主觀感覺呢?

再回想我們的日常生活,我們又是如何肯定公車上,旁邊那個人形的東西是具有主觀感覺的人類而不是機械人?似乎外顯的行為是我們唯一可以觀察到的東西,我們從來不是透過跑進他的心靈裡面,看看內裡有沒有所謂的感覺,來確定他是活生生的人。我們之所以覺得他有主觀感覺,是因為看到他被公車門夾到後喊痛,或跟女友講電話時的笑容。如此一來,老闆判斷艾娃具有意識,看似草率,但其實跟我們判斷別人是人不是機械人並沒有甚麼差別。如果我們覺得老闆的判斷有問題,似乎便得接受一個可怕的結論:我們平常判斷我媽媽是具有主觀感覺和意識的人,這判斷也是不可靠的。說不定她只是另一個艾娃?

電影最後,艾娃得償所願,來到了人來人往的十字頭口,如果你剛巧經過,你覺得你可以發現艾娃只是個人工智能嗎?如果艾娃一直在人類社會生活下去,艾娃又和人類還有甚麼差別呢?

- 編按:二千多年前,曾經有個叫蘇格拉底的人,因為荼毒青年而被判死,最終他把毒藥一飲而盡。好青年荼毒室中是一群對於哲學中毒已深的人,希望更多人開始領略、追問這世界的一切事物。在他們的帶領下,我們可能會發現我們習慣的一切不是這麼理所當然,從這一刻起接受好青年荼毒室的哲學荼毒吧!

本文轉載自好青年荼毒室(哲學部)