- 本文轉載自科技大觀園《讓機器讀懂我們的心情!臺灣AI情緒辨識技術再突破》

- 作者/林妤庭|科技大觀園特約編輯

- 審閱/李祈均

「只要知道多一項資訊,就有更多想像的可能性!」清大電機工程系副教授李祈均的團隊,今年發表了「個人特質整合語音互動之深度情緒辨識技術」,可以在情緒辨識時嵌入個人化的元素,是目前獲得最佳準確率的做法。這項技術除了在「情感運算」(affective computing)的頂尖國際學術研討會 ACII 2019 與全球最大的語音技術會議 INTERSPEECH 2019 發表,也在未來科技展獲得「未來科技突破獎」並入選為亮點技術。

AI 與情緒的結合,在一般人的腦海中串聯出科幻小說般的未來情節,經常給人陌生、不可測的印象,不過這在科學界其實已經有很長期的研究。情緒辨識的應用也受到各界高度關注,對此李祈均表示,情緒辨識目前可以應用在客服、廣告、人資、精神醫療等領域,「我覺得很多應用的價值是要創造的。譬如你是做醫療的,能夠多得到一點資訊,你就能進一步思考可不可以多做什麼事情:可以怎麼照顧?再做什麼治療?更早知道什麼事情來預防?每個人想的不一樣,價值就會不太一樣。」

打開情緒辨識的黑盒子

回到情緒辨識的起點,「情感運算」這個詞從 1995 年就由 MIT 的教授羅莎琳.皮卡德(Rosalind Picard)提出。當情緒產生變化時,人類也會有生理上的反應,等到訊號量測、處理的技術發展得更成熟,人們自然就將這些技術連結起來思考:是不是可以透過偵測生理訊號的變化,來辨識情緒?

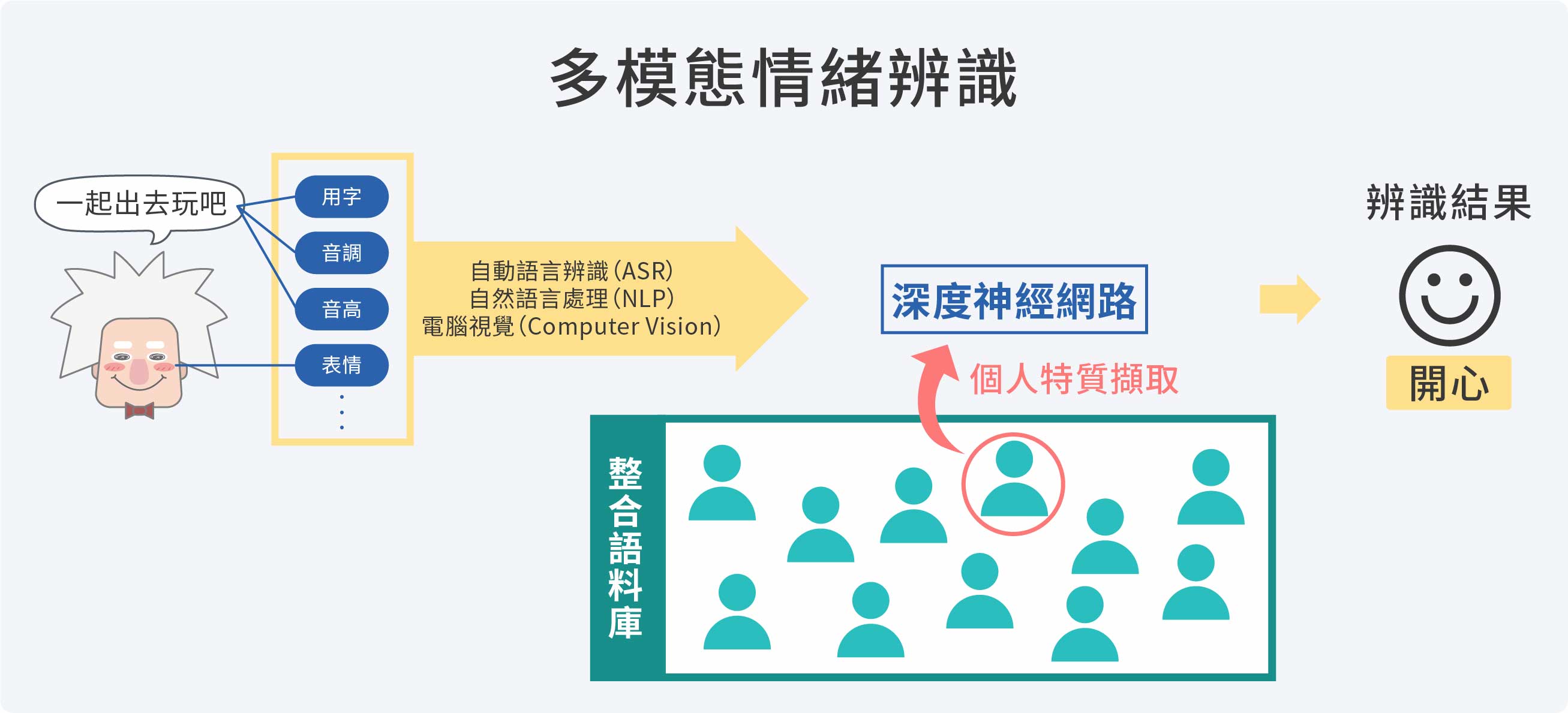

情緒辨識的處理架構,包括資料收集、資料標記、資料輸入、機器學習、辨識輸出等階段。「以前很多技術是功能性的,會產生明確的結果,例如打電話聲音轉文字,這是自動語音辨識的技術;文字裡面說了什麼,這是自然語言處理(Natural Language Processing,NLP)的技術。我們轉個彎去想,情緒跟這些東西有關,做完自動語音辨識、NLP 分析,是不是可以多分析一點內在的狀態?技術整合就會出現。」李祈均所投入的多模態情緒辨識,也就是透過整合語音(如說話的音高、語調)、文字、臉部表情等資訊,透過深度神經網絡分析,進行情緒的判讀。

只不過,因為情緒這種東西抽象又主觀,標記上會更為複雜。李祈均說明,目前典型的標記方式有兩種,一種是使用「類別」,即直接標示喜、怒、哀、樂等情緒種類;有些研究者進一步採用「象限」的方式,同時衡量「激動程度」(arousal)與「正負向程度」(valence),做更為細膩的表達。像是「生悶氣」就是激動程度較低、負向程度高,可和「生氣」有所區隔。 正確的判讀情緒,在應用上有助於提供更準確的服務;而整個情緒辨識系統,可以把過去仰賴經驗累積的專業,更為系統化並留存下來。「客戶很生氣地打電話給客服,跟單純想要詢問功能性的問題,我們提供的服務會完全不一樣。現在我們很仰賴第一線跟人接觸的人,客服靠經驗感覺你是什麼情緒,跟著改變決策;有經驗的人資,就是可以在技能之外,同時看出應徵者的個性,像是合不合作、在壓力下會有什麼反應。很多經驗的累積可以用 AI 系統化,有經驗的人離開之後,這些經驗也不會跟著不見。」

把個性「算」出來!

人類情緒複雜,性別、年齡、個性、生活背景、乃至不同的互動情境都會影響,但過去情緒辨識無法具體評估個體差異在其中所造成的影響,讓辨識結果不夠精確。

李祈均新的做法,是以「遷移學習」(transfer learning)的角度,在原本的資料外,再導入一個由其他現有許多資料庫集結而成的「背景資料庫」。所謂的「遷移學習」,是當資料不足以訓練模型,將已有資料所得的參數遷移至新資料的方法。用在個人化的情緒辨識上,假設要分析的樣本為 A,演算法會比對背景資料庫中具有類似用字、語調等特徵的樣本 B,賦予一個 A 與 B 之間有多相似的權重,做為「個人特質」的參照點,再據此去修正情緒辨識的結果。 李祈均進一步解釋,「我們將這一組值稱作 A 在背景資料庫裡面『個人特質的空間位置』,相當於利用演算法在這個背景資料庫為 A 找一個位置,去代表 A 的個人特質。」傳統要進行個性的標記,需要讓每個人填寫相關量表,對於實務應用而言,這樣的做法難以規模化,也缺乏效率。「所以我不用量表找,我用行為找,」李祈均說。當我們難以取得個性的標記,卻又希望了解個體差異會為情緒辨識造成何種影響,就必須想辦法進行轉換。這個背景資料庫中累積的語音文字等人類行為產生的資料,就是探索個人特質的一道窗口。

而從機器學習的分析結果來看,加入了個人化過程後,的確發現模型會對一些情緒線索的權重進行修正。舉例而言,同樣是使用正向詞彙,但是權重被下降,表示有可能是個人特質造成的影響。如果是個性活潑、習慣使用正向詞彙的人,不一定代表他特別開心,模型透過背景資料庫推導出個性特徵後,後續進行情緒辨識便會適度下修正向詞彙的影響力。如此一來,便能提升情緒辨識的準確度。

「以前想要知道個體差異會如何影響情緒表達,會需要將資料依照性別、年齡、種族等特徵分組,但資料分割地越細,訓練一組模型的資料就會越少,結果就變不準,這是一個很大的問題。」李祈均的個人化技術反向思考,以遷移學習繞過個性標記的瓶頸,利用機器學習一窺個體差異的端倪,為情緒辨識在缺乏個性標記的實際應用,開啟了新的可能。

懂得跨界整合,資料便無處不在

要進行情緒辨識的技術開發,需要的不只是工程方面的專業知識,其實還需要不斷摒除成見,並發揮敏銳的觀察力找到創意的突破點。以李祈均團隊 2017 年釋出的中文情緒互動多模態語料庫(NTHU-NTUA Chinese Interactive Multimodal Emotion Corpus,NNIME)為例,最特別的地方便在於和國立臺灣藝術大學合作,收集情緒資料。

「戲劇表演可以呈現很強的情緒張力,」李祈均表示,為了在鏡頭前捕捉最自然的情緒反應,同時擴大資料收集的效率,設計互動情境請專業演員演出,並進行錄影,是目前學界常見收集資料的方法。不過中間涉及許多專業的表演知識,導演如何訓練演員?要如何設計情境才能獲得最接近現實的情緒反應?「每多解一個小問題,就會有人提出更多的問題,也讓我多懂一點人,這個過程很有趣!」李祈均說。

情緒辨識研究,還可以如何突破?「有經驗之後,有些工具會讓標記速度變快,收集資料反而最難。」李祈均驚訝地發現,其實有很多既有資料可以多加利用。例如企業管理研究的學者探討組織溝通的行為,過程中本來就會錄下大量 3 到 4 個人的即時互動過程,「國際上公開資料庫釋出 3 到 4 人的互動資料,大約是 28 組,不過接觸臺大企管系後發現,他們手上的資料,近兩年累積下來,已經有 90 幾組!」

這樣的速度與規模讓他非常驚豔,原本收集資料是情緒辨識研究最困難的一道關卡,李祈均認為,透過跨領域的整合,把其他學科對於人類行為的研究資料挖掘出來進行工程分析,有機會快步提升臺灣情緒辨識技術開發的腳步。

情緒辨識技術的開發若要突破,最終還是要仰賴對於「人」的理解,並將技術落實到日常生活,解決「人」的問題。無論是學界或企業,臺灣各個領域都有非常優秀的專家,研究過程潛藏著無數人類互動的資料,只要工程端加以規模化,就能創造出不同價值。李祈均期待未來能有更多跨領域人才願意投入這個領域,在跨域整合下碰撞出更多新的創意火花。