- 【科科愛看書】小時候老師常常要我們成為一位有德之人,可是可是……《道德可以建立嗎?》如果道德可以建立的話,那我們又該怎麼做?總而言之,快快拋開那些讓人暈頭轉向的道德教科書,來面對有趣的難題,一起來燃燒大腦、喚醒你的哲學小宇宙吧!

不應該扮演上帝的角色,或不應該過於違反自然,這個論點究竟有什麼價值?

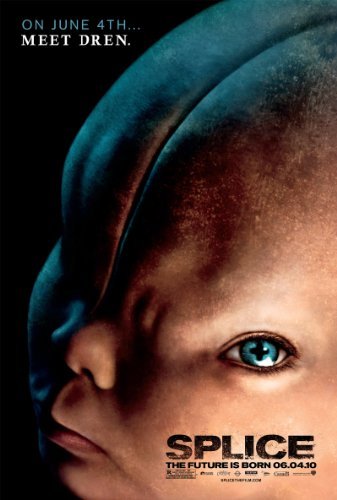

超完美人類該不該出現?

如果基因工程能大幅改善我們的肌肉、感覺、感情或認知能力,以及我們的身材與其他外型元素,我們目前對人類屬性的辨識標準必定有所更改。如果有可能運用化學或機械方式,在我們腦袋中誘引出各種信念、欲望與感覺,監視與操控心靈的技術就可達到更高的程度:甚至個人經驗以及內在的意識自由這樣的觀念都無法抵擋。

如果天然或人造器官的移植不再有任何技術性的困難,那麼我們對人體的神聖、不可分割、不可被他人利用的性質,以及人體與我們個人認同之間具親密關連的種種想法,最終都會改變。

如果人類的生殖複製成為可能,我們大概會被迫放棄這樣的想法:一無所知的未來,構成了我們的身分。

如果我們更加清楚也更能控制老化的過程,如果我們能以良好的健康狀態無限延續生命,那麼什麼是「失敗」或「成功」的人生,就不再有跟現在一樣的定義。如果有可能創造出超人類、後人類、類人類、賽伯人或不同物種嵌合人,我們對道德群體所畫出的範圍,指的是我們選擇出來不能被當成物品對待、不是只能利用或食用的生物,這方面的種種看法或許都會徹底改變1。

如果所有這些知識與科技變得容易理解,人人都能用,必然給我們的生活帶來實用的結果;誰要是否認這一點就太可笑了。這些結果有可能全是負面的嗎?它們會讓我們的倫理觀產生根本的改變嗎?目前我們還遠遠無法了解,未來生物醫學技術的發展與運用會造成的一切後果。我們可以預料,到目前為止我們關於人類本性的許多先入之見,可能因為這些蘊涵而作廢,我們對善的理解也會改變。不過為什麼這些會影響到我們對正義的理解,以及訴諸正義的要求,例如每個人都能平等享用自己想要的、由技術革新帶來的成果?

你是否認為,就算所有人都能從這些生物技術中獲得同等好處,也必須禁止實現這些計畫?你是否認為,就算這些生物技術能用來消除人與人之間某些天生的不平等,也必須禁止實現這些計畫?

你是否認為,禁止這些生物技術並不是在考慮正義或不正義的問題,而是單純因為實現這些生物技術可能危害到我們對人類認同的理解?你是否認為,禁止這些生物技術並不是在考慮正義或不正義的問題,而是單純因為實現這些生物技術可能危害到我們對善的理解?

你是否認為,有可能接受這些計畫中的某幾項但不是全部,或者你認為全部都該禁止沒有任何例外,因為就怕有某個恐怖的滑坡,把我們從最能接受的程度,帶到最可怕的地步?

所謂「自然」到底指的是什麼?

女性到了四十歲,還有一半的生命在前面等著,而且她們的平均壽命還能繼續延長。有了醫學進步的幫助,她們的健康狀態維持得越來越久,仍然能掌控自己的能力與外表。冷凍卵子的技術可以讓她們晚一點才生孩子,甚至過了更年期再生也不冒任何風險。在生育上和男性平等不再是個空想。

然而,大部分女性似乎不接受這樣的遠景。92% 完全拒絕,而四十歲以下的法國女性,只有 8% 考慮冷凍卵子。而且,在這些人當中,只有 3% 表示,如果真有這樣的技術,她們「一定」會這麼做,而 5% 則說,「大概」會這麼做2!

為什麼?在她們的解釋當中,有人說不應該「過於違反自然」3。可是她們對化學避孕方式的接受度很高。這難道不是很明顯的捨棄自然嗎?不應該「過於違反自然」,這個論點有什麼價值?

「自然」跟所有廣袤的觀念一樣,具有好幾個意思。彌爾認為它有兩個主要的意思4:

(1)代表所有存在的東西,以及根據物理定律所有可以存在的東西(這就把奇蹟排除在外,但沒有排除基因改造物)。

(2)代表沒有人類介入的世界會呈現的樣子(這幾乎直接或間接排除了地球上所有存在的東西)。

如果考慮第一個意思,那麼人類必須遵循自然這句話就很可笑。因為人本來就只能遵循自然。所有他經歷或感受的,都符合自然的定律。所有他做的、所有他製造的,也都不可能違反自然定律(包括生物科技、基因改造科技)。

如果考慮第二個意思,那麼人類必須遵循自然的想法,既不合理也不道德。

不合理:人類的一切行動都在改變自然的運行,而且一切行動都對這種改變有用。不做任何「違反自然」的事,就等於什麼都不做!也可以說「仿效自然」在第二個意思當中,意味著絕對禁止任何技術上的創新,包括用來切奶油的那條線。

不道德:如果人做的全是自然會做的事,我們一定會覺得那就是怪物。

「事實上,我們會赫然發現,如果人類對人類做出和大自然每天對人類所做的一樣的事,人會被關起來,或吊死(…)。大自然把人刺穿、把人粉碎像用車輪輾過、把人當飼料餵給猛獸、把人活活燒死、對人投石塊像對待第一個殉難的基督徒;大自然讓人餓死、凍死、用它迅速或緩慢的毒氣讓人中毒,還保留數百種其他駭人聽聞的死法,就連納比斯(Nabis)或圖密善(Domitianus)富有獨創性的殘酷本領都未曾超越。」5

為了對彌爾表示贊同(這是我的習慣),我想補充一點,以遵循自然為職責(或禁止違反自然),在上述兩個意義下,都嚴重背離了不少道德推理的基本規則。聲稱人必須遵循自然(或不能違反自然),違反了以下這項規則:沒有必要強迫人去做他們自己必定會做的事。

確實如此,如果人類的所作所為不可能違反自然法則(採用第一個意思),又何必鄭重其事地說這麼做是他的職責?何必囑咐他去做他已經在做的事?此外,為了說明什麼是好或壞、正當或不正當,而以第二個意思訴諸自然,也會違反這個規則:不能因為事情是怎麼樣,就說它應該怎麼樣。

這個規則其實有以下的含意:

(1)某件事不是因為是自然的就是好的。

(2)某件事不是因為不是自然的就是壞的。

訴諸自然不僅背離了必須用相似的方法處理相似的事件這個原則,還會編造出各式各樣的「滑坡論證」。

恐怖滑坡真恐怖?沒有邏輯才可怕

認為生物技術會造成「恐怖的滑坡」,意思是如果我們容許某個道德價值有爭論的行為(安樂死、胚胎研究、墮胎等等),最終就必定要容許另一些行動,而這些行動在道德上是絕對且毋庸置疑必須受到譴責的:大規模清除窮人、弱者、難看的人、殘障或後期墮胎。

如果我們不要獲得這些無法接受的結論,一開始就不要讓危險的滑坡出現,因為這是滑坡論證的必然走向。這個論點的難題在於,讓我們必定得出可惡結論的理由可能是藏起來的,也可能毫無根據。

有關生殖複製的公共辯論是個很有意思的事件,因為我們清楚看見,不應該「過於違反自然」或「把自己當作神」的想法,帶出許多輕率的滑坡論證,以及其他道德推理的錯誤。

(1)生殖複製技術的開發,可能具有不良意圖。可是其他的人工生殖技術也有這個可能,它們卻沒有因為這樣就被禁止。例如沒有人會認為必須完全禁止體外人工受精,因為也許有一天,某個暴虐的政府會強迫婦女接受冷凍胚胎,以便為國添增人口,解決退休的問題。那麼,為什麼生殖複製一定會導向最壞的結果?這難道不是滑坡論證的謬誤所造成的恐懼?

(2)就算我們基於某些理由,尤其是宗教上的理由,反對生殖複製的開發,我們也能理解那些以醫療為目的,而對生殖複製技術產生的高度需求。可是有什麼理由可以用來支持以生殖為目的的生殖複製?這不符合沒有必要禁止人去做他們絕對不會自願去做的事。

(3)生殖複製時常受到譴責的原因是,這是一種對人的侵犯,因為以這種方式生下來的孩子,純粹是工具性的計畫產物。可是,如果必須禁止所有可以評定為「工具性」的生育計畫,大概也沒剩下多少計畫可以進行。幾個世紀以來人們養兒育女,就為了生病或年邁時能得到照顧與供養。我們不能說這些親子計畫不具工具性。然而,似乎沒有人認為這樣的事特別不道德。

事實上,生孩子的計畫一直多多少少帶有工具性。人之所以要生孩子,難道不是為了確保相當程度的物質或情感保障,讓自己的伴侶或父母高興等等?為什麼唯有提到生殖複製的時候,生殖行為才被認定帶有工具性,還被評論為不道德或駭人聽聞?這違反了「用相似的方法處理相似的事件」這項規則。

雖然大部分反對生殖複製的論點,因為違反了道德推理的基本規則而沒有接受的必要,這不表示我們有什麼好的理由來推動生殖複製。有個思想實驗可以幫助我們了解為什麼。

設想以下這個不能算是完全荒誕的情況:人類的自然生殖力受到威脅,因為人類精子出現普遍且不可逆轉的枯竭現象。在這種情況下,無性繁殖可以為人類物種的延續問題提供合理的解決方法,也許是唯一的方法。

我們還能設想出其他狀況,來推動生殖複製嗎?如果不能,為什麼還要繼續推動?

注釋:

- Smilansky, Ten Moral Pardoxes, op. cit., p. 134-137.

- IPSOS, Enquête maternité, 2009.

- Ibid.

- John Stuart Mill, La nature (1874), trad. Estiva Reus, Paris, La Découverte, 2003.

- Ibid., p. 68-69.

本文摘自《道德可以建立嗎?:在麵包香裡學哲學,法國最受歡迎的 19 堂道德實驗哲學練習課》,臉譜出版。