- 作者|Albert Einstein, Leopold Infeld

- 譯者|王文生

科學研究的結果,常促使哲學改變看待問題的方式,這就遠遠超出科學有限的範疇。

科學的目標是什麼?嘗試描述自然的理論,要符合哪些要求?這些問題雖然超出物理的界線,兩者卻有緊密的關連,因為科學正是構成這些問題的材料。科學在哲學上的推演,必須奠基於科學結果。一旦哲學推演得到多數認同,它們也常指出幾條可能的發展方向,影響科學思想的進步。主流觀念的重大變革會產生全然不同的、出乎意料的進展,成為新哲學觀點的源頭。這些評論聽起來空泛又毫無意義,我們得引用物理史的實例說明才行。

我們試著描述第一個論及科學目的的哲學觀點。這些觀點對物理發展一直維持重要的影響力,直到 100 年前,新的證據、現象和理論促使人們放棄舊的哲學觀點,讓科學有了伸展拳腳的新空間。

科學的歷史,從希臘哲學到近代物理,人們不斷追求將看似複雜的自然現象簡化為簡單的基本觀念,並將觀念連結起來。這是所有自然哲學背後的基本原則。這個原則,甚至在原子論者的著作裡都能看見。早在 23 個世紀以前,德謨克利特(Democritus,前 460 – 前 370)就寫道:

我們習慣把甜稱為甜,習慣把苦稱為苦,把熱稱為熱,冷稱為冷。但是,現實中只有原子和虛無。也就是說,雖然感官的對象應該是真實的,人們一般也這麼認為,但是,它們實際上並非真實。只有原子和虛無是真實的。

它只是古代哲學中一個巧妙的想像力產物。連結一連串事件的自然定律,對希臘人來說還是未知。將理論與實驗結合的科學,從伽利略的工作才算有個起頭。在第一條線索的指引下,我們找到運動定律。200 年來,有關力與物質的科學研究,是人類探索自然的努力背後的骨幹。我們無法想像少了力與物質任何一項的自然。因為物質作為力的來源,作用在其他物質上,藉此展現本身的存在。

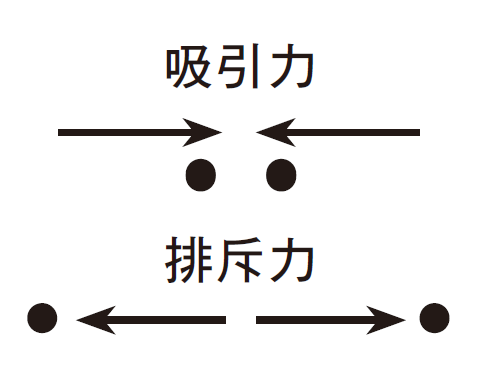

讓我們考慮最單純的例子:某個力作用在兩個粒子間。最容易想像的是引力和斥力。不管哪一種情形,力的向量都位在兩個物質構成的點的連線上。為求簡潔,自然會想到兩粒子互相吸引或排斥的圖像。若假設力作用在其他方向,圖像會複雜不少。在此之上,針對力向量的長度,我們能再加一條同樣單純的假設嗎?儘管我們有意避開太特殊的假設,加上這條也無傷大雅:任意兩粒子之間的力,只和兩者距離有關,例如重力。看起來,它也夠單純。更加複雜的作用力也不難想像,像是有些不只受距離影響,也和兩粒子速度有關的作用力。

使用物質和力作為基礎觀念的話,我們很難想像比作用在粒子連線上,只受距離影響的力更單純的假設。但是,單靠這一種作用力,足以描述所有物理現象嗎?

力學在衍生領域的偉大成就,像天文領域驚人的進展,甚至乍看之下不屬於力學的問題,其實也能套用力學觀念。這些成功加深了人們的信念,只要用不可改變的物體之間單純的作用力,就能解釋所有自然現象。從伽利略以降,兩個世紀間,幾乎所有的科學產物都有意或無意地朝這個方向努力。19 世紀中,亥姆霍玆 (Hermann von Helmholtz,1821-1894) 把這項信念化為文字:

終於,我們發現,物質的物理科學是將自然現象轉換為不可變動的吸力與斥力,其強度只和距離有關。這個問題的解答,是完全理解自然的必要條件。

根據亥姆霍玆的說法,科學的發展路徑已經確定,往後將分毫不差地走向固定方向:

不僅如此,只要所有自然現象都能化簡為單純的力,並且到證據,證明它是簡化現象的唯一途徑,科學工作將迎來終點。

在 20 世紀的物理學家眼中,這個想法既笨拙又天真。他可能不敢想像偉大的探索工作能如此順利地結束,而且也會因為可靠的宇宙圖像就此定案而感到興趣索然。

雖然早期物理學家相信,所有的現象都能縮減成單純的作用力,他們還是留下為何力和距離有關的問題。在不同現象,力隨距離的改變程度有可能不同。為了不同狀況,而引入多種類的力,以哲學觀點來看不能說是盡善盡美。儘管如此,所謂的機械論 (mechanical view),主要由亥姆霍玆清楚定義,在當時扮演著重要的角色。物質的動力理論方面的進步,是機械論影響下最偉大的成就之一。

談到機械論的衰退前,我們暫時先接受這個上一個世紀的物理學家之間的主流觀點,看看以這個外在世界的圖像為出發點,能得出什麼結論。