「這段時間,我們一直納悶控制的方法在哪裡……」

「沒想到就是我們自己。」——《人生複本》 Blake Crouch

有沒有注意自己的日常用語會跟自己經常接觸的朋友們越趨接近?像是辦公室有人開始講:「是在哈囉?」身旁會也越來越多人在不經意間說出:「是在哈囉?」我們跟某個朋友聊天時,如果對方原本都沒有在用貼圖,但是突然有一天他/她開始用了貼圖,我們也開始跟著用貼圖來回應對方。

用語上的一致性 (lexical alignment / lexical entrainment)能夠讓人跟人之間距離更靠近,增加彼此的信任感。不僅在語言上,行為上一致性(姿勢、動作等)也能在兩個溝通越來越順暢的人們身上觀察到,而且人們在沒有察覺的情況下,對於那些語言與行為跟自己一致的人也展現較多好感。

語言一致性的涵蓋範圍廣泛,包含用詞選擇、腔調、語速,甚至是修辭結構。

舉例來說,當我們在跟朋友描述自己所在的位置時:「我在地下室一樓」此時,對方比較有可能回應「我在地下室二樓」,而不是「我在 B2」。

但人與人之間對話時的用語一致性跟語音助理設計有什麼關係呢?

無論與人或電腦對話,我們都會配合對方的用語

我們可以透過瞭解人跟電腦對話的時候,是否也會出現這樣的用語一致性。在這個實驗當中,研究者們會讓使用者分別跟三個不同的角色語音對話對話,分別是:

- 真人

- 較舊版本的電腦

- 較新版本的電腦

而且使用者們會明確地被告知即將對話者的身分。如果是舊版電腦,就會看到一個螢幕開機畫面上寫著是 1987 年的作業系統版本;如果對話的是新版電腦,就會在螢幕上看到 2003 年的作業系統版本。

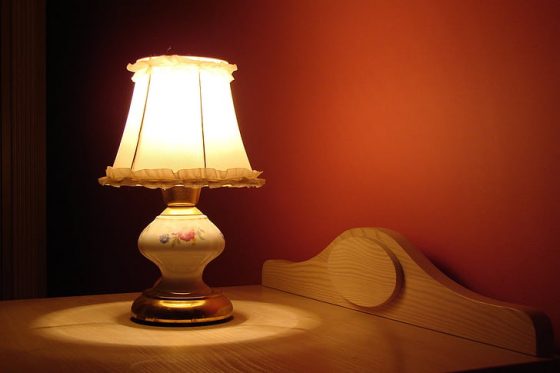

接著,請使用者在實驗過程中分別跟三個不同的角色互相看著圖片描述一個物品,例如:看一張電燈的圖片。不過「電燈」的另一個稱呼也可以是「檯燈」,這時候研究者就讓他們輪流向對方說出照片裡的物品,進而讓研究者們分析使用者會不會因為對方用了某個詞彙,後續再看到同樣的圖片時也用同樣的詞彙。

結果發現,是的!使用者不但會配合另一個人的用詞方式,也會配合電腦的用詞。

即便使用者知道自己在跟電腦對話,當電腦一直用固定的詞彙描述圖中物品時,使用者的描述用詞也會配合電腦,就如同配合人一樣,用同樣的詞彙來描述物品。

但是這種用同樣詞彙的配合程度不同,當使用者知道自己在跟一個舊版本的電腦對話時,配合的程度就高於最新版本的電腦或是人類。也就是說,當我們知道電腦可能「比較笨」的時候,我們就更容易去配合它的用語。而這個效果透過很表面的知覺操弄就可以做到,就像實驗中讓使用者看到不同版本作業系統就會達到配合程度不同的效果。

不只用詞,在句子結構上也會配合語音助理

除了看字彙選擇是不是會有一致性,研究者們也發現當請使用者分別跟另一個真人、另一個發出機器音的語音助理、另一個擬人聲的語音助理對話,無論和誰對話,使用者自己的句子結構都會有配合對方的傾向。

研究者們邀請使用者向三個不同的角色互相描述圖片中的畫面,從中我們可以發現兩個不同的描述方式:

- 左圖:「大明給小王一張卡片」=「大明把卡片給小王」;

- 右圖:「一個藍色的圓圈」=「一個圓圈是藍色的」。

接著讓使用者分別跟三個角色輪流描述多長不同的圖片給對方聽。結果發現,如果對方一直用「A 把(物品)給 B」或是「形容詞 + 名詞」這種結構來描述圖片的話,自己後續描述圖片的方式也會趨向這個方式。

所以,無論跟自己對話的是人,或是機器音的語音助理,還是擬人聲的語音助理都有同樣的效果。

利用人們「一致性」本能,互動設計讓語音助理更好用

從我們與語音助理的互動經驗中可以發現,只要語音助理無法辨識我們說出來的內容,就無法給出符合期待的回應,所以自然語言處理(Natural language processing, NLP)的專家們持續發展語音辨識的技術。然而在新技術尚未推出之前,我們其實可以從人機互動的角度來修正語音助理的設計。

以本次回顧的系列研究的結論來說,人會隨著溝通對象而改變語言使用習慣,包含用語、句構。尤其當人認為電腦越不聰明時,配合程度越強。因此,設計師們不妨根據現有技術,先讓語音助理講出一些簡單的句子結構來開啟對話,再引導使用者也使用相似的簡單結構來回覆,而不是一定要專注在設計出能夠進行複雜對話的語音助理。

例如:當我們透過 Hey, bot 喚醒語音助理後,先讓語音助理說出:「嗨,下指令」這個簡單的句子結構,進而引導使用者說出:「好,播音樂」。

從系統設計角度來看,這麼做能在一開始就讓使用者在不知不覺中說出系統比較容易辨識的指令。就像我們在跟小小孩對話的時候,當他對我們說:「我要車車~」的時候,自己也會很自然的回應:「車車給你~」。

如此一來,使用者就不會因語音助理辨識錯誤而太失望了,不是嗎?

延伸閱讀

感謝沈奕超、張元嘉提供編輯建議

參考資料

- Cowan, B. R., Branigan, H. P., Obregón, M., Bugis, E., & Beale, R. (2015). Voice anthropomorphism, interlocutor modeling and alignment effects on syntactic choices in human-computer dialogue. International Journal of Human-Computer Studies, 83, 27-42.

- Branigan, H. P., Pickering, M. J., Pearson, J., McLean, J. F., & Brown, A. (2011). The role of beliefs in lexical alignment: Evidence from dialogs with humans and computers. Cognition, 121(1), 41-57.

-200x200.jpg)