現代人手機幾乎從不離身。 既然基地臺隨時都要能夠把話傳到你我身上, 那也就意謂著基地臺隨時可以掌握你我每個人的行蹤。 不只是真的基地臺, 還有 FBI 暗中竊取公民隱私用的假基地臺 Stingray。 另外, 使用者自己不小心也會洩漏隱私 — 例如不知道黑莓機 Z10 的 「愛歌昭告天下」 特異功能, 或是丟棄/回收舊手機的時候沒有完整刪除個資。

黑莓機有一個自己專屬的即時通功能 BlackBerry Messenger (BBM): 在黑莓機的用戶之間, 如果知道彼此的 pin 碼, 就可以私下或群組透過 BBM 寄送免費簡訊。 新款黑莓機 Z10 有一個很方便也很危險的社交功能: 透過 BBM 自動昭告天下你正在聽什麼音樂。 許多黑莓機用戶接到使用 Z10 的親友發出的訊息, 才知道它有這個預設開啟的神奇功能。 問題是: 當你發現親友正在 “欣賞” 色情網站的影音時 (就像原文所貼的收訊方手機截圖所顯示的一般) 應該怎麼開口提醒他要把這個廣播功能關掉才不會太尷尬呢?

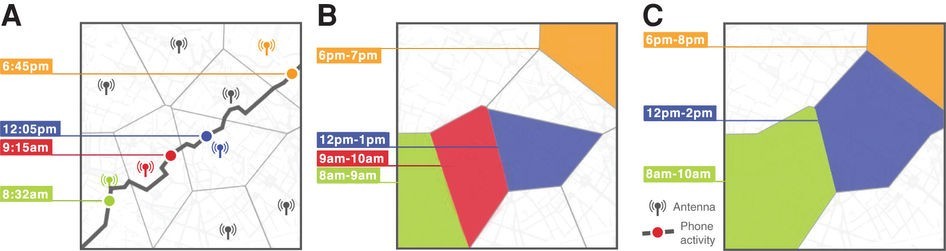

MIT 及比利時天主教魯汶大學的 一份研究報告指出: 當你握有一個 (即使只是很粗略的) 手機位置資料庫, 單單僅是很粗略地提供四五個點的行動資訊, 就足以指認出一支手機的持有人是誰。 大家都知道: 你的手機即使是在待機的情況下, 也需要讓基地臺知道它的大略位置, 這樣它才接得到電話。 學者檢視基地臺所蒐集的手機時間位置資訊, 內含一百五十萬用戶在一段十五個月的期間內與基地臺聯絡的資料。 他們只留下解析度極低的資訊 “基地臺 X 在五點至六點之間偵測到用戶 Y”。 然後任意提供一個匿名用戶 Z 的四點資訊給學者, 他們就有高達九成五的機率可以從這一百五十萬用戶當中把最有可能的用戶指認出來。 這項技術跟一般人無關嗎? 在臺灣, 也許吧; 但在 「FBI 偷偷監視公民」 的美國, 就很難講了。

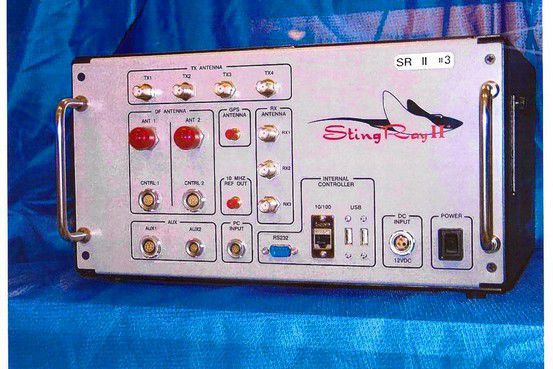

公民組織 EPIC (Electronic Privacy Information Center) 透過資訊自由法 (Freedom of Information Act, 陽光法案的一種) 取得美國聯邦調查局內部文件顯示: FBI 有一種神秘裝置 cell-site simulator (偽基地臺) 暱稱為 Stingray。 FBI 不願意公佈太多細節, 目前公眾只知道 Stingray 屬於 IMSI catcher 的一種。 它會假扮基地臺, 誘騙待機的手機自動報上目前位置及手機硬體代號。 上述 MIT 與魯汶大學的研究已經說明 FBI 所獲得的資訊已經具有強大的識別力, 更何況它也同時取得手機的硬體代號 ( IMSI)。 就算 Stringray 沒有攔截監聽的功能, 它對公民隱私的侵犯已經很明顯。 (1) FBI 可以沒拿到法院的搜索票就秘密監視公民的行動嗎? (2) FBI 怎麼可以把不相關的非嫌疑人資料也都一起搜集進去呢? 更違背民主社會常規的是: 美國司法部以及許多州的州警都曾向 FBI 借用這種裝置暗中蒐證, 但在法庭上對於自身的這項爭議蒐證行為卻又隱暱不報, 誤導法官讓法官以為這些資訊取自電信業者。 EFF 和 ACLU (American Civil Liberties Union) 在一個案例當中提供相關研究資訊給法院, 希望將 FBI、 司法部、 檢警系統這種鬼鬼祟祟的行為進一步攤在陽光下。

[4/10 補充] 因為竊用身份而被起訴的 Daniel Rigmaiden 在法庭上指控: 他的手機的電信業者 Verizon 暗中協助 FBI 用 Stringray 監控他。 他手機內有一張 air card, 可以讓電腦透過手機上網。 Verizon 暗自修改 aircard, 讓他的手機優先連到 FBI 的偽基地臺 (而不是優先連到訊號最強的基地臺)。 Rigmaiden 本身犯法是一回事; 但 FBI 與電信業者可以擅自決定何時要入侵公民手機, 這很令人憂心。

被本文嚇到, 決定不用手機了嗎? 且慢拿上網拍賣。 手機鑑識專家提醒: 即使你記得將手機恢復原廠設定、 用內建的工具刪除檔案, 鑑識專家都還是有可能查出許多未完整刪除的資訊, 包含你何時在哪些 wifi 熱點上網 (以及該點密碼)、 相片資訊 (例如拍攝時間地點)、 造訪過的網站、 通訊錄、 … 事實上也不需要真正的鑑識專家才能挖出資訊。 如果手機可以被電腦認成隨身碟 (我個人偏好用這類手機, 因為它多一個傳輸資料的管道), 那麼很多時候救援誤刪檔案的工具 ( 1、 2) 都可以取回一部分資料。 專家建議 (很長的過時文章, 可以直接跳到 「Even Further Epilogue」 一節談論現代技術與建議): Windows 下的 Eraser 工具或 Linux 下的 shred 指令或許可以減少殘留資訊; 但這方法不適用於電腦讀寫不到的手機儲存空間, 也無法安全清除 SSD 上面的資料。 用鐵鎚把報廢手機敲爛可能才是保護隱私的終極解。

本文的目的並不是要勸阻讀者使用手機, 只是要提醒大家: 使用手機永遠存在隱私洩漏的風險。 對於我們一般人而言, 也許可以賭一下沒有人有興趣認真研究我到底去過哪些地方、 買過哪些東西、 上過哪些不良網站 — 即使知道這些曝露隱私的可能性, 我們還是會選擇繼續享受手機所帶來的便利。 但如果你生活在公民手機與隱私遭到北京政府用明槍暗劍強行入侵的西藏, 或是遭受其他威脅, 那麼這些知識就很重要了。

(本文轉載自 資訊人權貴ㄓ疑)