記錄\王昱夫

你走在一個晴天的下午,帶著你的寵物,到處散步,一如往常;可是不太對勁,每個人都看著你的方向,露出一種,介於狐疑、好奇、興奮又同時帶點畏懼的表情(可能是害怕自己突然受到傷害吧)。What’s wrong!?你意識到問題不在你身上(當然,你穿著運動用的帽T和長褲,有什麼好引人注意的==),是你的寵物!他是隻機器人!

再說ㄧ次,是機器人!當你看文章的時候,可能無法深刻感受這種衝擊,如同我們通常也不會在看科幻小說時以為裡面天馬行空的光劍和時空旅行有多震撼,但請想像一下前面描述的畫面,身為一個路過的人,你怎能容許這樣的情景從你眼前逃脫, 寵物又跑又跳,周圍的狗對著它咆哮,宣告自己的領域(或者也是對於這陌生的型態感到畏懼),一切彷彿再平常不過,僅僅因為它是機器,而讓心情產生巨大的扭曲。

這一切,卻是真真實實存在!當我們以為機器人在生活中的應用可能只限於自動掃地,其實他們已經可以和我們有更深入的互動。PanSci回顧「機運2」,一起感受機器人的溫度。

二足機器人進化論–淺談設計概念到格鬥機器人競賽

盧聰勇\瞻營全電子股份有限公司 機器人事業部經理、台灣機器人格鬥聯盟主辦人

二足機器人夢

「機器人,什麼是機器人?機器人應該能用是兩隻腳行走的!」講者一開始就用堅定的語氣說道。不同於市面上常見的輪式機器人,他非常強調機器人就該擁用雙腳行走的型態(像是人行、鳥型、猴型等等),流露出一股對風格的堅持與浪漫。兩隻腳的機器人,滿足我們的想像,更投射出人類對自身的想像。

機器人設計

針對人型機器人而言,他們的身高大致都在120公分左右,原因大致有兩個:一是大部份的家具以這樣的身高都可以碰得到,能夠有效執行各種家務;二是這樣的身高對於小孩子來說,較不會有壓迫感,不會讓家中兒童產生恐懼畏懼的心理。在設計上,雙足機器人的的一隻腳最少需要2根軸以上才能有效完成移動,基本上,若有5軸就可以模仿人類雙足的運動模式(包含髖關節2軸、膝關節1軸和踝關節2軸),可以控制整隻腳進行像是抬腿甚至左右傾斜之類的行動。

目的決定功能

講者特別提到,在設計機器人的過程中,千萬不可忘記的是我們一開始設計它的目的!不要只是單純為了追求強大功能性而遺忘了目標,就像一隻可以太陽能充電的機器人,儘管性能再好,要作為地底工作用機器人也是不可能的!只是徒勞而已。

做一隻機器人?

想要DIY建造一隻機器人可不是件容易的事,首先要尋找各結構材料的相關資料,像是馬達要用哪種?材料是要用合金還是碳纖維?也可以參考現有的機器人來做評估,「而現在機器人面臨的最大問題,還是電源」講者說,若沒有輕巧又夠力的電力供應源,機構設計得再好也是枉然。

除了電源,機器人的重心、軸內配線、延壁配線等等也都是不可忽視的學問,怎麼樣讓做出的機器人兼具功能性和外觀上的美感,更是需要反覆琢磨之處。

機器人格鬥

做好了一隻機器人,準備參加機器人格鬥的你,突然心生疑惑「咦~到底機器人格鬥怎麼比勒?大家的機器人性能又如何?」

其實機器人格鬥在台灣發展到現在,已經經過了很大的演進,從一開始線路都外露、只能側向滑步移動,到近期機器人已能正面快速前進,甚至做出彈跳、跑步等動作,穩定度和成熟度都進步了非常多。規則上,機器人格鬥採計算擊倒制(一回合5次被擊倒就輸),但同時也附帶了許多限制,像是禁止側向攻擊、禁止滑步移動等等。一般人看來或許會覺得限制也太多,但是,正因為有這樣的規則,機器人的技術才會越來越進步,困難才會隨時間逐漸被克服,朝著「像人一樣格鬥」的方向前進。

格鬥不只是打架,更可以融入文化!

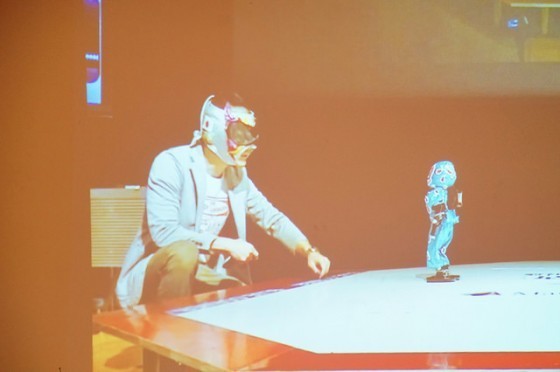

我們常常以為,機器人格鬥充其量也不過就是打架嘛(只是換了打架的參與者),但是講者最後放的ㄧ段影片卻完全跌覆了全場的印象。

一位日本的機器人比賽參賽者,將他的機器人裝扮成假面造型,上場格鬥的同時,不只是對打,更把整個過程當成一場表演,藉由打鬥讓機器人做即興演出,甚至操控者還會與機器人做互動,遞水、撒嬌、掙扎,其逗趣和娛樂的程度,完全不遜於綜藝節目。他們比賽不只是為了得名,更是一種文化特質的展現,把生活的經驗融入到機器人裡,希望藉由比賽,讓自己的機器人被看到,也讓製作者的心情故事傳遞給大家。而那,或許才是我們應該更加追求的精神!

看到這裡,是不是等不及想回家開始研究機器人了呢!客官稍等!後面還有好菜呢,讓我們接著聽聽下半場的演講吧!

https://www.youtube.com/watch?v=kH7NzfZAkp4&list=UUuHHKbwC0TWjeqxbqdO-N_g

關於仿生機器人的一些想法

林沛群\國立台灣大學機械工程學系副教授

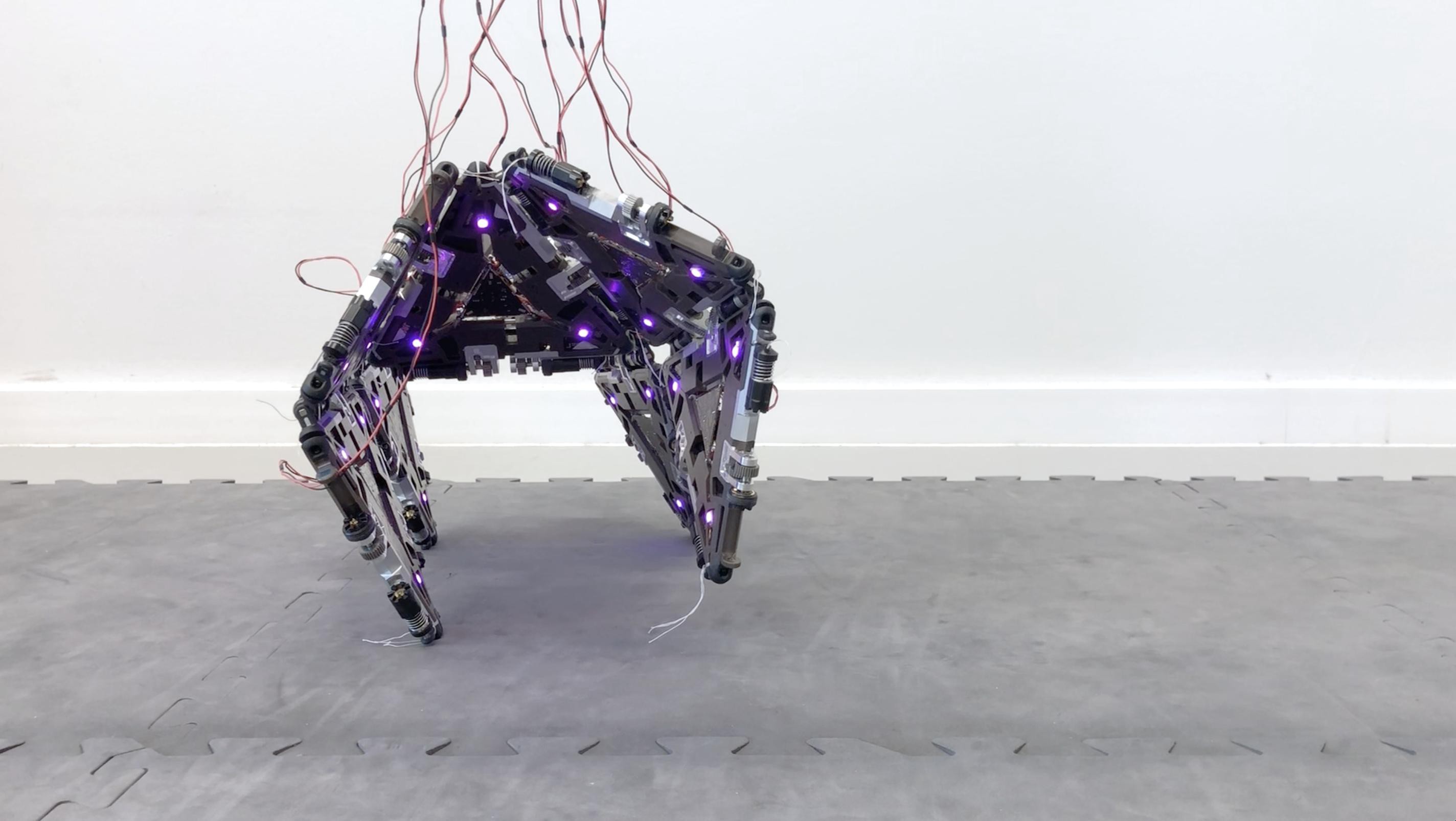

機器人往往在我們想像中,便是具備雙手雙腳,以人型姿態走路、操作;然而,卻有另一大類的機器人顛覆了這樣的想像,他們像是蜘蛛一般在地面上快速爬行,像小狗般跟著主人出門散步。那是仿生機器人,什麼是仿生?為何仿生?又要如何仿生?就讓我們聽聽講者的分享吧!

關於仿生???

做機器人其中一項很大的目的,就是希望能讓它「運動」,而在「生成一個運動」上,生物絕對是一個很好的學習對象,在經歷長時間演化後,他們不論在移動速度、敏捷、操作甚至是能量的消耗上都擁有相當高的能力。自然界中常見的例子,像是蜘蛛可以利用特化的腳與步伐在崎嶇地上快速移動、豹透過肌肉的特化來達到快速地奔跑⋯⋯

仿生這個領域其實本身就是個跨領域的結合,在製作機器人之前,我們必須先了解生物怎麼運動,對生物進行「系統識別」,學習他們的生物結構如何幫助他們克服障礙,並擷取重要的特徵及我們可以重現的機制,進一步應用於機器人設計上。當然我們要製作仿生機器人很大的限制也來自於技術面必須是工程上可行,在材料、機械結構、機電系統、控制理論⋯⋯各面向,都需要有相應的技術相輔,才有可能真正做出一隻理想的仿生機器人。(講者特別提到,若是用現有的技術做出一隻馬達驅動、人體比例的機械手臂,由於馬達的出力限制,做多也只能舉起大約500g的物品而已,這樣連到超商買瓶大罐水都辦不到,更何況是更高階的功能了,這就是技術的限制!)

機器人動起來

如果有了結構設計,機器人要如何動起來呢?主要可以分成三部分:對複雜環境的感知、決策和運動生成。當機器人透過感測器了解周圍環境(如路況),傳送到電腦分析進行判斷(路線規劃),再傳送回馬達進行動作控制(移動)。

針對動作這部分,足式生物運動主要可以從簡單的模型出發,把腳想像成一個彈簧,移動過程中,前半部動作是在煞車同時經由韌帶、肌肉儲存能量,後半部動作釋放能量往前進,要設計一個機器人便可以試著從這角度來出發!

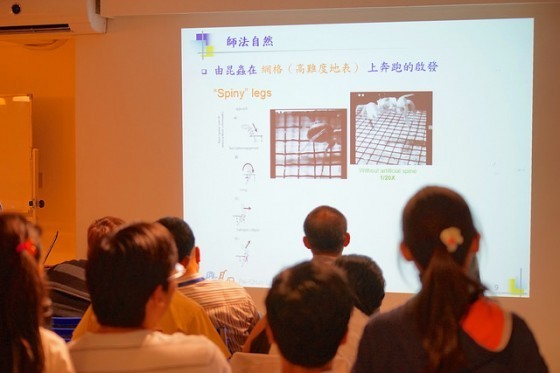

師法自然

講者特別提到的例子,便是他們團隊所研究的「蟑螂機器人」。蟑螂無疑是世界上最具生命韌性的生物之一,到底為什麼我們每次要打他們都打不到,他們是如何在崎嶇地形上跑的那麼敏捷?

透過實驗分析蟑螂的動作,他們可以以簡易的「三角步態」進行移動。將這樣的運動機構複製到機器人上,便創造出了強力的移動型機器人,他可以像蟑螂一樣越過高地障礙爬行、上下樓梯、跑步,甚至也可以經由改變控制模組變換成為四足類的步態,像狗狗一樣跑跳!

再進一步,為了要越過更複雜的環境(如網格),團隊來在機器人上裝了「腳毛」,另外加裝「回授控制機制」,讓它不只是單純越過地形,更可以「感受」地形,進而調整姿態,以更順暢的方式前進。在自然環境中測試後,機器人甚至還可以順應地形,改變型態,將「足」變形成「輪」,優化機器人對於不同地形的適應能力。

為何做機器人這麼困難?

時常大家想像的機器人(像是哆啦A夢),總是天馬行空,想要什麼功能就畫到紙上,在這樣的層次上機器人可說是完全不受限制,卻有失現實;再更進一步到玩具模型的層次,製造者需要考慮關節的構成、變形機關的配置、外型的維持等等,比起卡通畫面,那更貼近了我們技術上可及的領域;然而,真正要做出機器人,最重要也是最困難的關卡,是在於動力裝置、關節馬達和系統控制的面向上!沒有穩定的動力來源,沒有強力的馬達驅動,沒有精準的系統軟體控制,缺少了任何一項都會讓機器人喪失機能。在思考機器人的建造上,這些絕對是必須不可忽視的!

講者也特別提到,我們師法自然,學習生物的運動機制,能讓我們更進一步找到有效的運動機制,但在控制和動力上仍必須考量現實。仿生只是工程上的一個可行解,並非唯一解。在使用仿生技術前,我們必須明白生物往往不是針對運動最佳化的,他們在演化上有其特殊的背景環境在影響,我們只是抽取我們需要的機制應用到機器人上。

機器人與人類

講者的團隊過去常常帶著他們的機器人出門散步,他們也戲稱這樣的行為叫「遛蟲」(因為是仿蟑螂步態的機器人嘛~),很特別的是,街上的人們看到這樣一個機器人,僅僅因為他運動的方式更像是「活著的生物」,就會對他產生無比的好奇心(相信大家如果只是在街上看到一台遙控車,一定不會引起這麼大的騷動!),狗也會不停地朝它咆哮,小孩會想摸摸它⋯⋯當機器人走入我們的生活,以一個我們熟悉的生物的姿態,他在我們心裡便引發了前所未有的心理狀態改變。

這無疑是個社會性問題,當未來,有更多機器人走入我們生活中,和我們互動,與我們工作、交流,屆時,我們該站在什麼角度?怎麼看待機器人與人類的關係?絕對是不可迴避而需要認真思考的!

https://www.youtube.com/watch?v=BNa8tA_vDVc&list=UUuHHKbwC0TWjeqxbqdO-N_g

Created with flickr slideshow.

【關於 M. I. C.】

M. I. C.(Micro Idea Collider,M. I. C.)微型點子對撞機是 PanSci 定期舉辦的小規模科學聚會,約一個月一場,為便於交流討論,人數設定於三十人上下,活動的主要形式是找兩位來自不同領域的講者,針對同一主題,各自在 14 分鐘內與大家分享相關科學知識或有趣的想法,並讓所有人都能參與討論,加速對撞激盪出好點子。請務必認知:參加者被(推入火坑)邀請成為之後場次講者的機率非常的高! 本場演講由科技部指導,PanSci泛科學與民視文化共同舉辦。