文章轉載自PTT〈婦產科醫生,ptt ID:ShayGiven〉

男性的陰莖長度可以用尺量,但是女生的陰道不像男生的陰莖是外露,那要怎麼量陰道的長度?難道是用陰莖勃起長度,並且把勃起的陰莖塞進陰道,塞好塞滿去換算的嗎?究竟陰道到底要如何測量呢?

_______________防雷線________________

編按:本篇文章雖然是認真的科學文,但仍不免有些跟性愛有關的敘述,如果你未滿18歲或是害羞臉紅紅後會見笑轉生氣的話,建議左轉按上一頁離開,謝謝。

陰道的高度彈性

首先是女性的陰道本來就是一個高度彈性的組織,一般人認為陰道不會因為要做愛而增加深度,這是完全錯誤的認知。

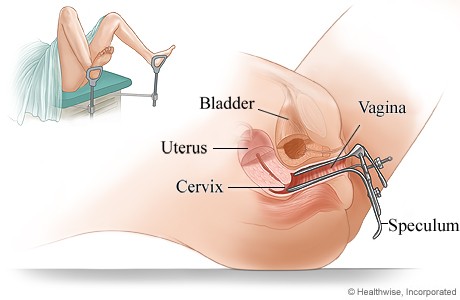

事實上,在研究上就連有無使用鴨嘴(speculum)、MRI或超音波測量出來的女性陰道長度寬度都會有差異。Reeves, Belovicz, Molter, and White(1996) 發現在使用鴨嘴(但沒有施力撐開,就是將鴨嘴放進陰道內保持讓受試女性沒有壓力狀態)的狀況下,使用超音波為量測工具,未生育女性(nulliparous)的一般狀況(baseline)陰道(這時陰道形狀可視為筒狀(tube))平均長度會從7~8公分增加為 8~9公分 平均寬度則從2公分增加為3~4公分。

性興奮狀態(Arousal)的陰道則會有tenting的現象,陰道裡面三分之一的地方會擴張成類似帳篷狀,因此平均長度會從9.5~10.5公分增加為 11~12公分,最大寬度(內三分之一的最大徑)則從5.75~6.25公分增加為6.75~7.25公分。

事實證明:

- 即使是鴨嘴的進入也能讓陰道本身產生反應而主動擴張

- 性高潮對陰道的效應非常明顯

請注意這裡對於性高潮狀態的陰道量測方法,只是請受測女性閱聽咸認為會引發性高潮的影片(內容包括接吻,撫摸,性器進入等 ,但力求不會引發受測女性的反感或恐懼情緒而干擾研究),然後使用超音波量測她們的陰道長度。

許多受測女性會表示,在她們真正性高潮(愛侶的性器進入)時,她們覺得自己能被進入的深度遠比上面的數字還要大(當然,由於醫學倫理,目前根本無法進行類似「女性和伴侶真正做愛時的陰道長度」這樣的測量,所以只是「覺得」)。

但是在日本,我的老師的團隊有一項低調的研究沒有發布在醫學期刊上,是日本某婦女團體為了希望了解動輒12~3公分的各種性愛玩具或是A片中性愛機器的假陽具,會不會對女優的陰道造成永久傷害做的研究方法,不甚嚴謹(所以當然無法登大雅之堂)只是要求同意的受試者(大部分是女優或性工作者)騎木驢[註1],使用該婦女團體認為對生殖器最可能有永久傷害的騎乘位性愛機器,使用一分鐘後測量受試者的陰道長度及寬度。

結果是發現在受試者同意及事先做好準備(ex:自我刺激、放鬆氛圍等方法)下,陰道的平均長度可以到達13.55~14.35公分,寬度可以到達6.83~7.16公分(請注意這是東方人的數據),該婦女團體的擔心才被化解。

婦女團體的顧慮被化解的原因

首先要有以下的認知:

女性陰道可擴張的長度和寬度,和有無自然產有絕對的關係, 而和該女性的身高,體型,骨盆腔形狀,性行為次數沒有絕對相關。

會有這樣的關聯性是由於胎兒產出時經過陰道時,會對陰道壁富有彈性的結締組織造成永久性的拉長塑形。所以並不會有「酒店小姐的小穴已經是大老闆的形狀,會比較鬆」、「AV女優被大X男優一起睡過,所以對30cm會比較能承受」這種事情,就此角度看來,該婦女團體的顧慮合情合理,畢竟大部分該產業從事者應該未曾生育。在這裡要定義一下用超音波量測「陰道長度的起始點和終點」,終點當然是子宮頸的外開口(External orifice),而起點則是和尿道開口在通一個縱切面的陰道開口。

但實務上不論是男性陽具或是性愛機器上的假陽具,插入時有小陰唇的存在,都不可能精準地將「基座平面」剛好位在陰道開口的位置,因此有效插入長度大約會比表定長度少大約0.6~1公分。以前述的日本案例為例,拍攝用的假陽具基座到頂端的長度是14公分,換算一下就可以知道其實相當安全。(實務上女優也不會讓假陽具在抽插時整隻沒入自己身體)

後子宮穹窿

至於A片裡面,那些一般標準是17公分甚至有到20公分的假陽具呢?大家其實不太需要擔心西洋女優的人身安全。首先「sex machine」這個概念,其實是歸因於一個1990年代之後盛行的理論:

後子宮穹窿在適當刺激的情形下是非常重要的性刺激帶,女性性交時觸及到此區域,會引發出不同於陰蒂高潮的快感。

一開始有人注意到有許多女性(因為其他問題前來婦科門診)提及她們的性經驗時, 會有下面的陳述:

被「頂到底」時有一種下身酸麻的感覺,伴隨子宮被觸動的快感,順著脊背往 上如雷電般達到全身。

這群女性大多是身形中等或嬌小的未生育年輕女性,而事後取得同意的狀況下測量她們的陰道長度,也的確是數值在平均以下的一群。 就連美國女性,也有大多數人誤以為子宮頸是自己陰道可以到達的最深處「頂到底」是子宮頸被陽具碰到了。實際上那是性交時陽具偶然觸動後子宮穹窿所造成的高潮,由於後子宮穹窿處負責連接子宮至體壁的子宮韌帶較鬆,所以穹窿被偶爾打擊時子宮也會隨之極輕微的晃動,對女性而言極為刺激,同時後子宮穹窿的後壁處有一個對壓覺受體密度非常高的神經末梢集中處,有許多女性會覺得這塊區域被碰到的感覺非常舒服。

這也是為何大部分長這樣的 sex machine 會要使用者(女優也大部分是用這樣的姿勢使用)趴在床上以自己最能放鬆的姿勢,然後緩緩將假陽具套入,將身體往後移動,直到觸及到最舒服的位置,當然如果藝高人膽大或是嫌陽具不夠長頂不到後穹窿,也是可以慢慢把兩腳打開,讓骨盆腔內的器官相對位置更接近陽具的頂端。

最後我們來看看美國AV女星Tori Black是怎樣順利將8.5 inch(21.5公分)的東西放進她的陰道裡:

- 「我會在大約一個小時前先大號,並且用浣腸器清除宿便,吃一點巧克力和牛奶讓身體和心情放鬆,然後看一些影帶,用手指讓我的小妹妹調整習慣」

- 「當時我蠻焦慮的,我之前拍攝時用的尺寸大部分是6吋或6.5吋,這次用的是8″5,而且必須整隻插進去…所以我除了Solaxin外還吃了inderal以放鬆焦慮感,平常時就算是6吋的機器,我也會先吃solaxin,那讓我全身的肌肉不要那麼緊繃,而且插入時不太會不舒服。」

- 「拍攝之前,我們會有充分的時間調整陽具在身體裡的狀態,我會趴在斜向後下的床上,屁股向後把陰戶對準陽具的頭慢慢套下去,會有女助理幫我注意。這時候往往是我最緊張的時候,弄不好我會因此受傷,我會先塗大量的潤滑劑在假陽具上面,所以一開始進入時會比較順利,一下子就滑進去了,但是接下來是最困難的部分,會先頂到我的子宮頸,接下來我會稍微往前傾,助理則把我的屁股往下壓,讓陽具可以進入到我子宮頸後面的那塊空間,這樣才能完全容納,最後我會慢慢把腳張開,放在床旁邊站腳的位子,調整到機器動起來時我覺得最舒服的位子。」

- 「被整個塞滿的感覺其實蠻不舒服的,雖然我事先整過腸,但是那根假陽具的角度讓我一直很有便意。」

- 「機器動起來之後,感覺有比較好一點,但是因為尺寸太大了,我覺得衝擊有時候很舒服有時候又怪怪的,並且讓我緊張得想小號,雖然我不舒服隨時可以喊暫停,但是還是有點奇怪。」

- 註1:騎木驢在學理上是安全可行的。(誤)

本文經原作者同意轉錄後編輯刊登。

原文:

- Re: [新聞] 小GG男也能讓女性高潮!因女性陰道平均深 ptt西斯板 [Jan, 3, 2016]

- Re: [新聞] 小GG男也能讓女性高潮!因女性陰道平均深 ptt西斯板 [Jan, 3, 2016]