Original publish date:Feb 08, 2009

編輯 HCC 報導

NewScientist 於去年年底綜整該雜誌於2008年所刊登有關軍事科技方面的報導,整理出10篇重要文章,先進軍事科技恍如科幻電影情節。

1. 空用雷射武器完成首次測試 (Airborne Laser lets rip on first target,http://www.newscientist.com/article/mg20026866.200-airborne-laser-lets-rip-on-first-target.html)

2008年11月美國波音、Lockheed Martin、Northrop Grumman公司於加州愛德華空軍基地進行了空用雷射武器(Airborne Laser, ABL)測試,雷射系統安裝於一架波音747內,並從地面上對幾公尺外的目標成功的進行雷射攻擊。

雷射系統於首次測試發射了1秒鐘,研發團隊希望於2009年進行飛行測試之前,能延長雷射發射時間。空用雷射武器合約商已經著手進行模擬,以顯示對武器系統進行修正後也許能擊落飛機。

2. 寂靜、乾淨的空用雷射武器(US boasts of laser weapon’s ‘plausible deniability,http://www.newscientist.com/article/dn14520-us-boasts-of-laser-weapons-plausible-deniability.html)

在波音公司完成空用雷射武器的地面測試後,先進戰術雷射武器(ATL,Advanced Tactical Laser)即將安裝於C-130大力士軍用運輸機上。美國空軍研究實驗室人員用了“可以堂堂皇皇否認(plausible deniability)”的字眼來形容使用空用雷射攻擊的好處。原因來自於被攻擊目標無法察覺對手,也因為沒有械彈碎片,所以無從辨識攻擊來源。

3. 衛星遭受雷射攻擊的預警系統(Pentagon wants laser attack warnings for satellites,http://www.newscientist.com/article/dn14002-pentagon-wants-laser-attack-warnings-for-satellites.html)

美國五角大廈正研發能對攻擊間諜衛星的地面雷射進行定位的系統,2007年美國空軍 Space Superiority Systems Wing 部門負責Self Awareness/Space Situation Awareness (SASSA)計畫,研發能感知並追蹤雷射攻擊來源的技術,SASSA系統需要能偵測大範圍的雷射與無線電波。2008年5月Lockheed Martin與波音公司公佈其SASSA規劃書,除了能偵測與辨識雷射攻擊以外,亦能感測衛星無線電傳送干擾。美國空軍希望於2011年發射的TacSat-5衛星進行SASSA 系統飛行驗證。

4. 美國擬研發核能動力攻擊艦(US considers nuclear-powered assault ships,http://www.newscientist.com/article/mg19826605.600-us-considers-nuclearpowered-assault-ships.html)

美國眾議院甫通過議案,致力於製造更多的核能動力美國海軍艦隊,包含兩棲攻擊艦。目的希望避免美國艦艇進入不友善地區補充燃料,確保海軍燃料來源,保證艦艇電子與雷達系統的能源效率。

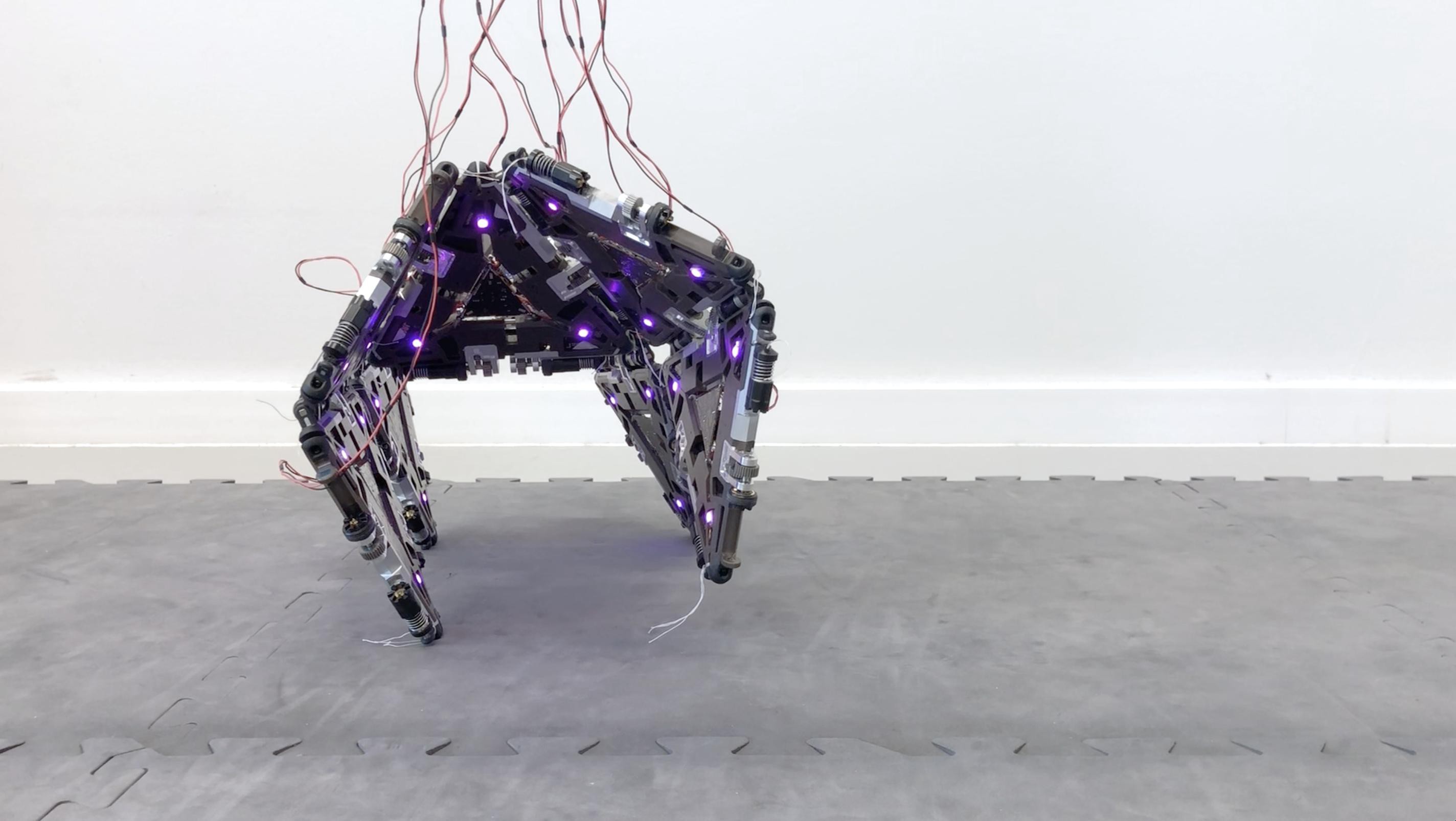

5. 反對使用戰場機器人(Anti-landmine campaigners turn sights on war robots,http://www.newscientist.com/article/dn13550-antilandmine-campaigners-turn-sights-on-war-robots.html)

美軍已使用以士兵遙控的機關槍操作機器人(Machine-gun wielding military robots),不過美國國防部希望未來上述機器人能自行決定何時扣板機。位於英國倫敦的非官方“地雷行動”組織(Landmine Action),希望能仿禁止使用地雷,簽約禁止使用戰場機器人。

6. 能追捕不合作對象的機器人(Packs of robots will hunt down uncooperative humans, http://www.newscientist.com/blogs/shortsharpscience/2008/10/packs-of-robots-will-hunt-down.html)

聽起來似乎是電影“iRobot”機械公敵的橋段,不過五角大廈真的在找合約商提供多機器人追蹤系統(Multi-Robot Pursuit System),讓成群的機器人尋覓與偵測不合作的個人對象(a non-cooperative human)。

7. 防範犯罪偵測器(‘Pre-crime’ detector shows promise ,http://www.newscientist.com/blogs/shortsharpscience/2008/09/precrime-detector-is-showing-p.html)

美國國土安全部(Department of Homeland Security, DHS)正研發能偵測含有敵對念頭的檢測器,此些檢測器可安裝於邊界、機場與公共場所。DHS於2008年提出以未來特徵篩選技術(Future Attribute Screening Technologies, FAST)進行情緒與心理檢測,檢測裝備包含攝影機、紅外線熱感應器、人眼安全雷射雷達感測器等,足以從遠距量測脈搏與呼吸速率。依據對人員測試結果,DHS科學家認為在惡意(Mal-intent)檢測具有78%的準確度,在欺騙(deception)檢測則具有80%的準確度。

8. 能追蹤目標的次械彈(Planned cluster bomb hunts targets down,http://www.newscientist.com/article/mg19926756.400-planned-cluster-bomb-hunts-targets-down.html)

鑑於使用於集束炸彈的子母彈未爆率過高,極易造成無辜平民的損傷,全球110國於2008年在挪威首都奧斯陸簽約禁止使用特定集束炸彈。合約要求新的集束炸彈其內含子母彈數目需小於10枚,每枚子母彈重量需超過4公斤,需具備瞄準目標功能,並附自毀安全裝置。美國尚未簽署上述合約,美軍現使用的0.3公斤重M77小子彈,自空中散撒,以飄帶散佈於目標區,無自毀安全裝置;29 公斤重,附自毀安全裝置的BLU-108B/B具備雙重(主動/被動紅外線)感應器,能執行更佳的目標偵測,不過偵測範圍僅止350公尺。

美國空軍尋求改善集束炸彈武器性能,期望新的小子彈能於數公里外追蹤並摧毀目標。美國國防部於2008年8月公開徵求美國航太公司提交計畫書(http://www.dodtechmatch.com/DOD/Opportunities/SBIRView.aspx?id=AF083-093),研發使用有導智慧型次械彈(guided smart submunitions)追蹤多目標的武器系統,徵求公告敘及次械彈(或子母彈)需配置感應器俾能於5公里外鎖住目標,本身並須具備動力能追蹤移動目標達5分鐘。

9. 取代鎮暴用橡膠子彈的閃爍光(How flickering light could replace rubber bullets,http://www.newscientist.com/article/mg19826551.500-how-flickering-light-could-replace-rubber-bullets.html)

美國陸軍與國土防衛部正研發非致命性光學武器,加州Intelligent Optical Systems of Torrance獲得資金研發多重顏色LED制伏器(Incapacitator),光的強度足以讓對象目眩,色光的特定順序與速率脈衝變化造成方向迷失與暈眩,國土防衛部希望2010年前此種光學武器能服役。美國陸軍則擬將頻閃光安裝在無人飛機上,光源類似1千5百萬燭光的氙燈,能於數百公尺外瞄準暴民,讓目標震攝不動。德州Nanohmics公司則研製使用於密閉空間的光學手榴彈,大小如同飲料罐,不若會造成傷害的震撼手榴彈,此種光學手榴彈使用強力LED,以接近人類視覺最高敏感度的520奈米波長運作。

10. 美國國防先進研究計劃局成立50週年 (Fifty years of DARPA: Hits, misses and ones to watch,http://www.newscientist.com/article/dn13907-fifty-years-of-darpa-hits-misses-and-ones-to-watch.html)

美國國防先進研究計劃局(Defense Advanced Research Projects Agency, DARPA)為美國國防部的核心研發部門,其任務為維持美國軍事科技優勢,防止危害美國國家安全的他國科技驚異(technological surprise),並且發展制敵機先的先進科技。1958年鑑於蘇聯發射Sputnik人造衛星,美國認知蘇聯已經具備能迅速開發軍事科技的能力,亟思成立負責規劃與執行研發計畫的高等國防部機構,遂於國防部底下建構DARPA。DARPA成立50年,發展成功與失敗的計畫不少。

成功的科研案包含網際網路(The internet):1960年代DARPA建立的ARPANET網路,成功的引導TCP/IP specification 的發展。全球定位系統(GPS):1960年代的5枚DARPA衛星讓美國海軍艦艇能精確的定位到200公尺以內,開啟了現今的全球定位系統技術。語言翻譯(Speech translation) :美軍在伊拉克已使用手持語言翻譯機,準確度50%。隱形飛機(Stealth Planes):DARPA最成功的科技驚異(technological surprise)代表作,1970年代後期所測試的Have Blue原型機,成為現今F-117夜鷹式隱型戰機的前驅。砷化鎵(Gallium Arsenide) :1980年代中期DARPA推動的6億美元電腦研究計劃,導致砷化鎵化合物的研發。

失敗的科研案包含鉿放射性炸彈 (Hafnium bombs):90年代的7百萬美元研發計劃。機械大象(The mechanical elephant):原欲於使用於越戰,能穿越叢林的機械馱具研發計畫。精神感應間諜(Telepathic spies):DARPA期望精神感應(telepaths)與念力(psychokinetics)能執行遠距間諜活動,當然答案是否定的。未來地圖(Futures Markets Applied to Prediction,FutureMAP),提案者認為經由對未來可能事件的活動狀況評估(market valuations),即能預測發生機率,所以擬以此理論推測恐怖活動的關鍵性發展甚至攻擊活動,整個計畫聽起來有點像湯姆克魯斯主演的關鍵報告(Minority Report)。獵戶座(Orion)計劃:研發能定期投擲核彈的星際太空船。

參考來源: