【2023 諾貝爾物理獎】什麼是「阿秒脈衝雷射」?能捕捉到電子運動的脈衝雷射?

林俊傑《江南》:「相信愛一天,抵過永遠,在這一剎那凍結了時間」

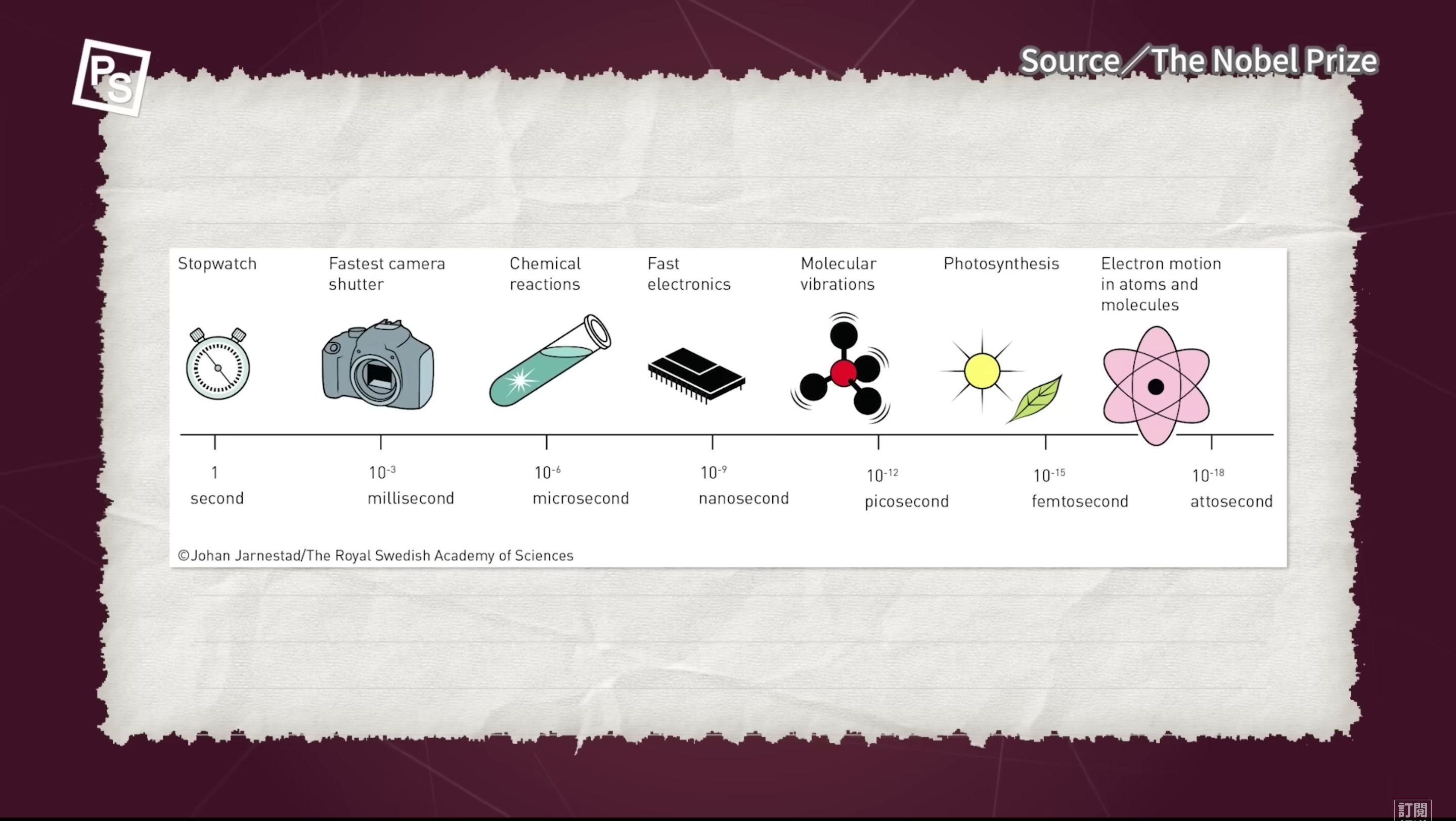

這一剎那持續了多久?這出自佛經的時間單位有多個解讀,其中最短,可以對應的國際單位制是阿秒。 1 阿秒又有多快呢? 1 阿秒等於一百萬兆分之一秒,是已經短到不行的飛秒的千分之一。在這段時間,別說是談戀愛了,連世界上行動最快的光,也只能移動一顆原子直徑的距離。

在阿秒的時間尺度裡,連光都得停下腳步,過去我們認為捉摸不定的電子,也終於將在我們眼前現身。 2023 年的諾貝爾物理學獎,正是頒給了三位帶領人類進入阿秒領域,探索全新世界的科學家。而這項技術,還可能讓電腦的運算速度加快一萬倍!

就讓我們一起來進入阿秒的領域吧,領域展開!

什麼是阿秒脈衝雷射?

今年諾貝爾物理學獎的三位得主分別是 Pierre Agostini 、 Ferenc Krausz 、和 Anne L’Huillier ,表彰他們對阿秒脈衝雷射實驗技術的貢獻。

所謂的阿秒脈衝雷射,指的是持續時間僅有數十到數百阿秒的雷射。當我們能使用脈衝雷射來觀察目標,就好比使用快門時間極短的相機對目標拍照,能捕捉到瞬間的畫面。

2018 年的諾貝爾物理學獎,就頒給了極短脈衝雷射的研究。短短 5 年後,雷射領域再次得獎,但這次是更快的阿秒雷射,能捕捉到電子運動的超快脈衝雷射。

世界上沒有東西能真正的觸碰彼此?看見電子能帶來什麼突破?

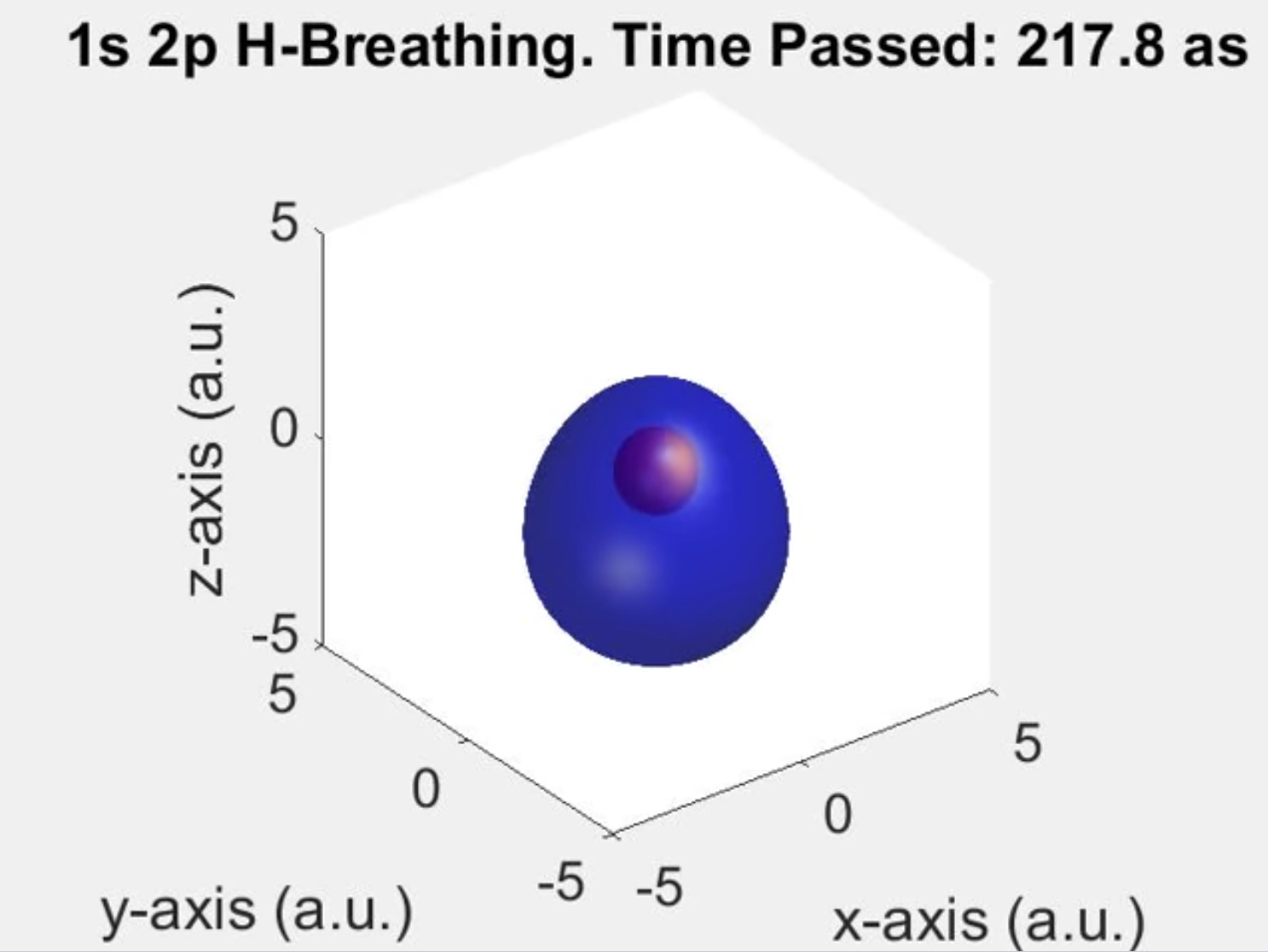

為什麼看見電子的運動那麼重要呢?我們複習一下原子的基本構造,在原子核之外,帶有微小負電荷的電子,被帶正電的原子核束縛住。量子力學告訴我們電子沒有確切的位置,而是以特定的機率分布在原子核周圍的不同地方,也就是所謂的電子雲。

雖然電子的體積比原子核小很多,但電子雲的範圍,卻占了原子體積的絕大部分。在物理或化學反應中,真正和其他原子產生交互作用的,幾乎都是這些外面的電子。在電影《奧本海默》中,當男女主角手心貼著手心,奧本海默這時卻說:「世界上沒有東西能真正的觸碰彼此,因為我們觸摸到的物體,都只是其中原子的電子雲和我們手上的電子雲產生的斥力。」

對了,這種話也只有奧本海默跟五條悟可以講,一般人請不要隨便亂牽別人的手。

除了和心儀的他牽手,不同的電子排列狀態也會直接影響物質的化學活性、材料的導電導熱等基本性質,各種化學和物理過程都和電子息息相關。從非常實際的層面來說,電子可以說是物質世界最重要的基本單位。所以不難想像,如果我們能看見電子,甚至獲得可以操縱個別電子排列與能量的技術,我們能真正成為材料的創世神,許多不可能都將化為可能,是相當重大的突破。

捕捉電子運動有多困難?

但要操縱電子可不是什麼簡單的事,不只是因為電子非常小,更重要的是他們動得非常快。具體來說,電子在原子周圍跳動的週期時間尺度大約是十的負十八次方秒,也就是一阿秒。一顆原子的大小約是十的負十次方公尺,速度等於距離除以週期,換算下來,電子雲差不多是以光速等級的速度在原子核周圍跳動。

如果要捕捉到阿秒尺度的電子運動,就必須將實驗的時間解析度也提升到阿秒等級,否則就會像是用長曝光鏡頭拍攝亞運競速滑冰比賽一樣,只能拍到一團糊糊的影像,而沒辦法分出勝負。

可是,在 1980 年代,脈衝雷射最快只能達到十的負十五次方左右,還只有飛秒等級。而且光靠當時的技術和材料優化,已經沒辦法再縮短脈衝時間了,因此這時候,就要從原理上重新打造一套方法了。

如何製造更快的脈衝?

首先,要製造更快的脈衝並不是用頻率更高的電磁波就好。你想,我們在拍照時,想要讓曝光時間更短,要改善的不是把室內光源從可見光改成頻率更高的紫外光,而是調快快門的開闔速度,讓光一段一段進入感光元件中,變成影片一幀一幀的畫面。而這一段一段進入像機的光訊號,就像是我們的脈衝。

不論是皮秒雷射、飛秒雷射還是阿秒雷射,一直以來在做的都是同一件事,在整體輸出功率不變的情況下,讓每一次脈衝的持續時間更短,同時單一次的功率也會更高。簡單來說,就是要從無數次的普通攻擊,變成每一次都是集氣後再攻擊。

但要怎麼為光集氣呢?光和其他波動一樣,可以和其他波動疊加。把不同頻率的光疊加在一起,波峰和波谷會抵消,波峰遇上波峰則會增強。只要用特定的比例組合許多不同頻率的光,就可以在整體總能量不變的情況下,產生一個超級窄的波峰,其他地方全部抵銷。

1987 年,本次諾貝爾獎得主之一的 Anne L’Huillier 教授發現,當紅外線雷射穿過惰性氣體時,氣體會被激發放出整數倍頻的光。也就是氣體放出許多不同頻率的光,而這些頻率都是原本光源頻率的整數倍,從兩倍三倍到三十幾倍以上的高倍頻光都有。而橫跨這麼大頻率範圍的光,就能組合出時間長度很短的脈衝光。

不過這聽起來未免也太好康了,真的有那麼簡單嗎?

這個看似魔法的實驗背後其實有著相當簡潔的物理圖像。電子原本是被電磁力束縛在原子中,當一道強度夠強的雷射通過氣體原子,原本抓住電子的電位能被雷射削弱。

雖然這道牆只是矮了一些可是還是存在,但此時,在電子的大小尺度下,量子力學發揮了作用。調皮的電子有機會透過量子穿隧現象,穿過這道束縛,暫時逃離原子核的掌控。關於量子穿隧效應的介紹,我們近期也會再做一集節目來專門介紹。

但電子還來不及逃遠,雷射光已經從波谷翻到波峰。電磁波的波谷與波峰,不是指能量的高和低,而是指方向相反。因此在相反的電磁場方向下,不幸的電子被推回原子核附近,再度被原子核捕獲。但在這欲擒故縱、七擒七縱的過程後,電子並非一無所獲,他所得到的動能會以光的形式重新放出。

而因為這些能量最早都來自雷射,因此電子放出的光波長,也剛好會是雷射的整數倍。再說的細一些,你可以理解為這些電子在吸收一顆顆光子後,一口氣釋放這些能量,所以能量都是一開始光子的整數倍。

在 1990 年代,科學家已經掌握了這個現象背後的原理。但一直到千禧年過後。這次諾貝爾獎得主之一 Pierre Agostini 教授和他的研究團隊才終於在適當的實驗條件之下,利用高倍頻光打造出了一連串寬度只有 250 阿秒的脈衝。同時第三位得主 Ferenc Krausz 也使用不同方法,分離出 650 阿秒的脈衝。

最後,獲得阿秒脈衝這個祕密武器之後,我們的世界將迎來哪些變化呢?

阿秒脈衝在各領域的應用

其實啊,有在關注諾貝爾獎都知道,諾貝爾獎通常不會頒給時下正夯的新興研究,前面講的研究,實際上都已經是二十多年前的往事了,而這些辛苦的科學家會在這麼多年後拿下諾貝爾獎的榮耀,正是因為阿秒雷射的發明經過了時間的考驗,成為非常普及的實驗技術,而且被大家公認為重要的科學貢獻。

當然,今年生醫獎的 mRNA 是個超快例外,有興趣的話,別忘了點擊下方影片,看看編劇都編不出來的 mRNA 研究歷程。

說了那麼多,阿秒雷射究竟對人類生活有什麼幫助呢?當然,它能讓我們更深刻了解物質還有光的本質,但是除了幫電子拍下美美的照片放在期刊的封面上,阿秒雷射可以用來做什麼?

在過去這二十年,許多研究已經找到了相當有潛力的應用。

舉例來說,在醫療方面,阿秒雷射可以用來分析血液或尿液樣本。控制良好的超短脈衝可以精準的刺激生物樣本中的各種有機分子,讓這些分子震動並放出紅外線訊號。如果使用的脈衝長度太長,分子釋放的訊號就很容易和原本施加刺激的雷射混在一起,造成量測的困難。唯有阿秒等級的超短脈衝能夠實現這樣的量測。

這些紅外線光譜就像是質譜儀一樣,能幫助我們快速分析血液中的蛋白質、脂質、核酸等重點物質的關鍵官能基狀態。並透過機器學習的方式整合,成為個人化的健康狀態報表,或是做為診斷的依據,將精準醫療提升到全新的層次。

不只如此,發送超短脈衝的技術也可能革新當今的電腦運算。電腦運作的方式就是利用電晶體這種微小的開關,不斷的開開關關去發送一跟零的訊號,所以開關電流的速度便決定了你的運算速度。以半導體為基礎的電晶體,工作頻率通常不超過上百 GHz ,在時間上也就是十的負十一次方秒。

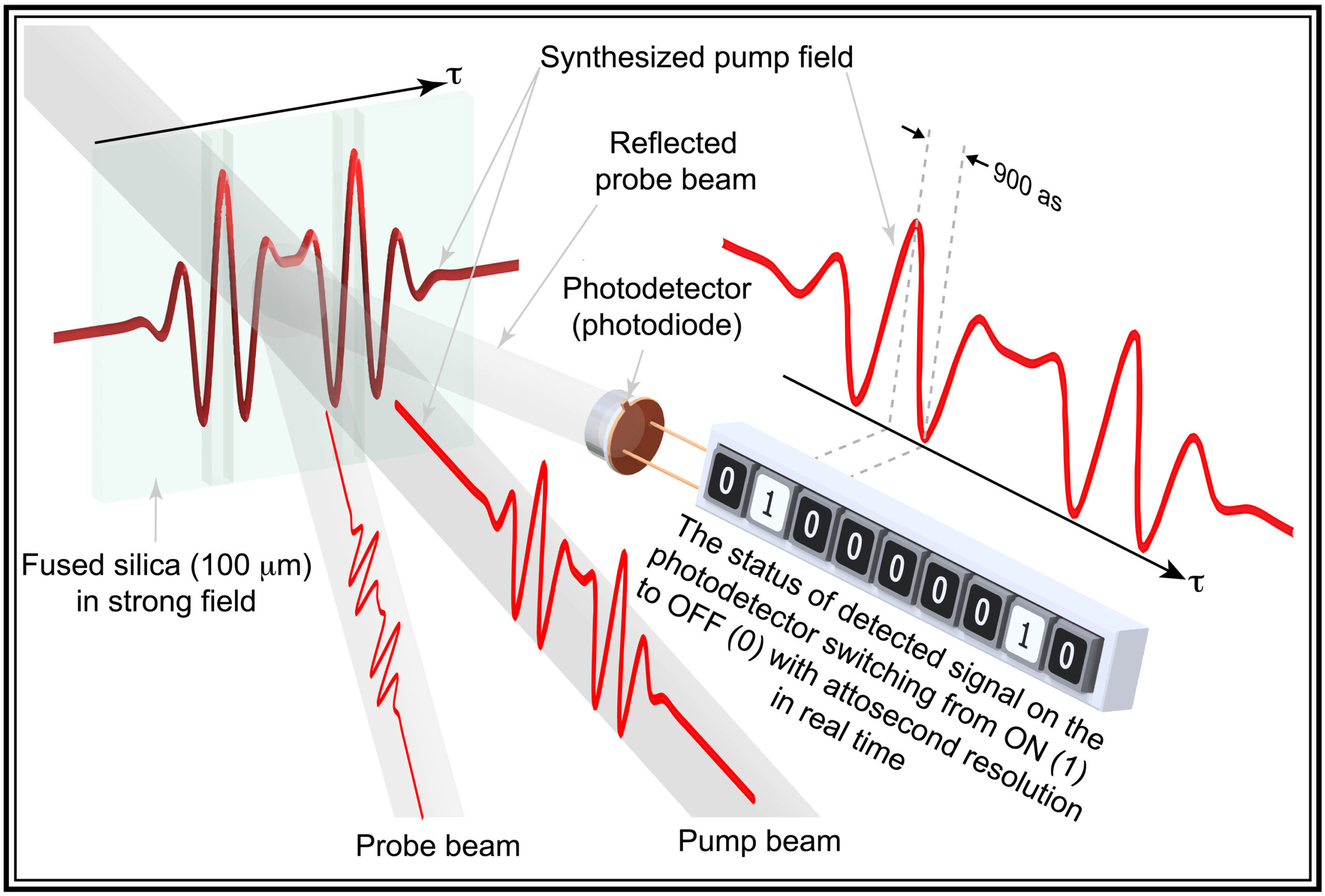

自從阿秒雷射技術普及之後,就有科學家想到:既然雷射脈衝的速度更快,那不如就別用半導體了,改用光學脈衝來控制電流作為運算的媒介。這個概念叫做光學電晶體(Optical Transistor)。

今年初,亞利桑那大學的團隊便發展示了如何利用小於十的負十五次方秒的超短雷射脈衝,來開關電流並傳送一與零的位元,這個頻率比現有半導體電晶體快了一萬倍以上。這顯示了光學方法的操作頻率可以有多快,或許能讓我們突破訊號處理和運算上的速度瓶頸。

看完這些便可以理解,阿秒等級的超快雷射脈衝的確是相當近代的一個科學里程碑。就像是科學革命時望遠鏡和顯微鏡的發明,讓人們看見那些最遠和最小的事物,超快脈衝用最快的時間解析度,讓我們看到許多人類從未看過的景象。

阿秒脈衝雷射的出現,是科學上的一個里程碑,讓我們能用更高的時間解析度,讓我們看到許多過去從未看到的景象。最後也想問問大家,在雷射這一塊,你最期待有哪些應用,或者最希望我們接著來講哪個主題呢?

為什麼醫美、眼科手術那麼喜歡用飛秒、阿秒雷射,真的有比較好嗎?

使用雷射脈衝的光學電晶體真的有可能取代傳統電晶體嗎?

除了光學電晶體,最近很夯的矽光子技術,聽說裡面也有用到雷射,可以一起來介紹嗎?

歡迎訂閱 Pansci Youtube 頻道 獲取更多深入淺出的科學知識!

參考資料