本文轉載自宜特小學堂〈最新AEC-Q007規範搶先看 車用Board Level驗證手法大公開〉,如果您對半導體產業新知有興趣,歡迎按下右邊的追蹤,就不會錯過宜特科技的最新文章!

隨著全球環保政策日趨嚴格,預測 2035 年歐美市場的電動車比例將分別達到 85% 和 70% 以上。為確保電動車使用者的安全,車用電子的可靠度要求也愈發嚴謹。因此,專門規範車用 IC 上板至 PCB 焊點可靠度測試(BLR)的 AEC-Q007 規範正式發布。讓我們快速了解一下AEC-Q007到底包含了哪些內容吧。

儘管目前電動車市場成長幅度已逐漸放緩,不如前幾年增長速度快,但國際能源署(IEA)預測,到2035年,歐美市場的電動車比例將分別達到85%和70%以上。從中長期來看,只要各國持續引入更嚴格的環保規定,電動車市場就會繼續擴大。

而全球汽車電子最高殿堂-汽車電子協會(Automotive Electronics Council,簡稱AEC)近期宣告,已推出 AEC-Q007 規範,正式定義車用 BLR 可依循的驗證標準方向。

AEC 是什麼?

AEC 是於 1990 年由克萊思勒、福特汽車、通用汽車組成的組織,目的是要建立通用的汽車零件可靠度測試方法與品質系統標準。此協會全球僅 93 家為合格會員,皆是全球在汽車各領域翹楚,包括全球前 10 大的 Tier1 供應商 – APTIV、BOSCH、CONTINENTAL、DENSO、MAGNA、ZF 等,以及前 10 大的車用晶片 Tier 2 供應商 -INFINEON、INTEL、NVIDIA、NXP、QUALCOMM、STM、TI 等,而 Tier 3 供應商(也就是協助 Tier 2的服務公司)則包含 TSMC、UMC、GF、Amkor 皆為其成員。)

宜特科技也在 2022 年底正式成為 AEC 會員。

這些規範的主要焦點都是在零件層面進行各種測試。雖然 AEC-Q104 規範中的 Test Group H 提到了板階可靠度(Board Level Reliability,簡稱 BLR),但內容只是提供了一些參考規範,並未詳細說明有關 PCB 和菊花鍊(Daisy Chain)的設計規範。(如果您對這個規範有興趣,可以參考這篇文章:六大重點,秒懂車用多晶片模組AEC-Q104規範)

換句話說,以前的 AEC 文件都是針對零件測試的規範,直到 2024 年 3 月推出 AEC-Q007,才首次真正將零件和印刷電路板(PCB)結合起來,其中建議了 PCB 與 Daisy Chain 詳細的設計規範,並透過 BLR 驗證方式觀察焊點失效的情況。

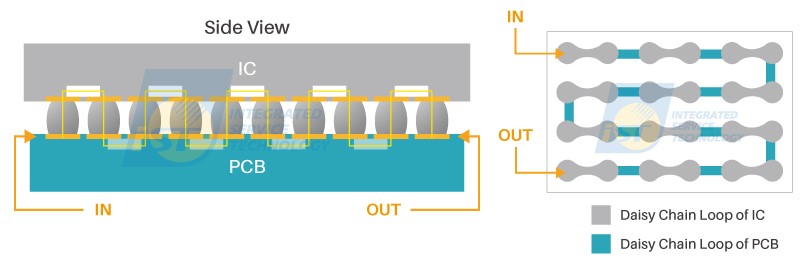

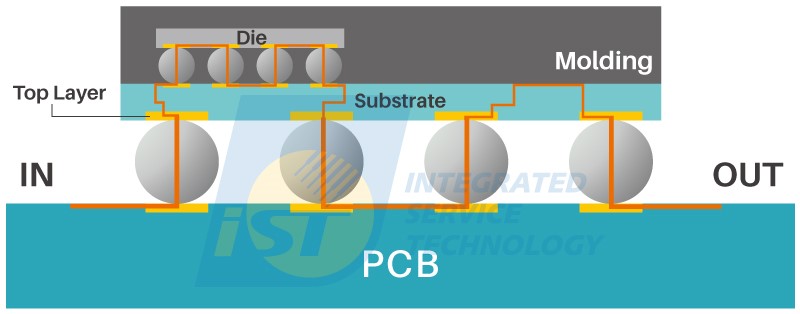

AEC-Q007 內容所提到的 Daisy Chain 設(圖一),其實就是我們經常聽到的板階可靠度測試,透過零件搭配 PCB,將錫球與 PCB 端設計成導通模式,進而形成迴路以便觀察焊點(Solder Joint)之壽命(延伸閱讀: 板階可靠度測試 Pass 或Fail,PCB 設計居然是關鍵),於測試過程中搭配測量儀器,即時獲得資訊來判斷焊點良率。

與完整的板階可靠度測試相比,AEC-Q007 規範僅聚焦於溫度循環測試 (TCT)下的焊點耐久性,而全面的 BLR 測試則涵蓋了三大應力條件:溫度循環測試 (TCT)、振動測試 (VB)、機械衝擊測試 (MS)。儘管 AEC-Q007 仍有範圍上的限制,但它仍是一個邁向提升汽車電子 PCB 可靠度的重要進展。透過納入 PCB 層級測試,AEC-Q007 可更深入解析元件間的相互作用及失效機制,特別是在熱疲勞條件下的影響,最終提升長期可靠度。

本文宜特科技將以 AEC 協會會員第一手觀察,逐一解析 AEC-Q007 規範中的三大要點:Daisy Chain 設計、PCB 設計和溫度循環測試。

一、驗證前之車用 Daisy Chain 如何設計

AEC-Q007 規範針對不同封裝形式中的 Daisy Chain 設計有個別的介紹,相較於其他國際規範大部分僅以文字帶過,對於初次想要學習 BLR 流程的使用者來說,AEC-Q007 規範非常容易理解與應用。本篇小學堂文章,宜特可靠度驗證分析實驗室,將以市場上較普及的球柵陣列封裝(Ball Grid Array, BGA)進行說明。

AEC-Q007 將 Daisy Chain 設計分成 4 個 Level,設計困難度以 Level 3 最簡易,Level 0 則最複雜,文中也提供建議指南,設計者可依據本身需求來設計 Daisy Chain。

因製程能力不斷提升,單一零件也從以往可能僅包含一顆晶片,逐漸發展到能容納多顆晶片。透過晶片與晶片或基板(Substrate)的層層堆疊,讓零件能擴充更多的 I/O。這些堆疊的晶片透過Solder Joint進行連結,以 BLR 角度來看,應該將零件內部等相似的 Solder Joint 結構一併考慮進來,以達到整體的可靠度,因此在 AEC-Q007 規範中,即針對不同類型零件提出不同的 Daisy Chain 設計建議。

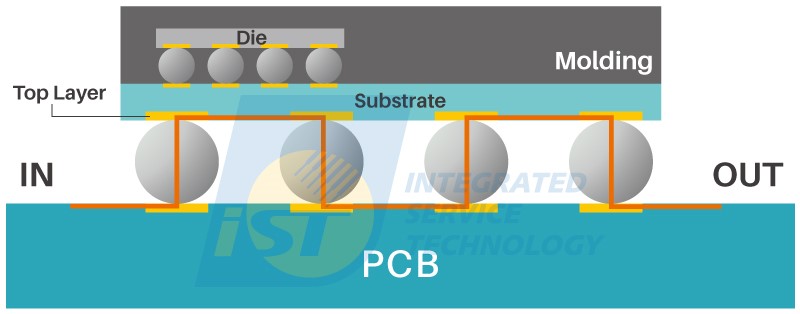

Level 3:透過零件基板(Substrate)的表層(Top layer)佈線,將錫球與PCB進行連結,這是 BLR 驗證最常見的 daisy chain 設計方式,主要可以觀察到零件表層線路、PCB 以及接點 Solder Joint 的異常狀況(圖二)。

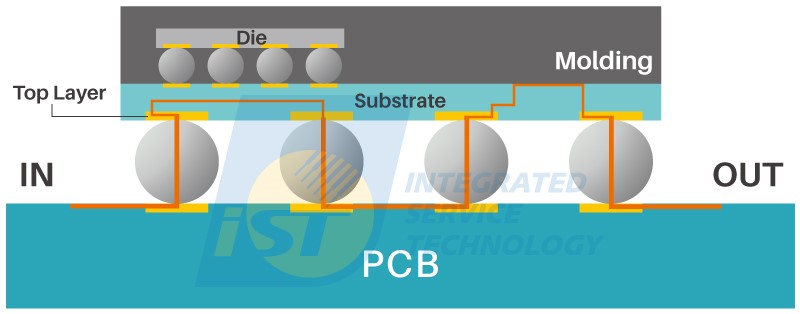

Level 2:因 Level 3 設計僅經過基板表層線路,當實際的產品基板線路較為多層複雜時,其可能會無法模擬部分基板失效情況,藉由將原本在零件底部的線路延伸至基板(Substrate)內層 (圖三),可延伸確認是否會因外在應力導致基板內層線路斷裂或脫層。

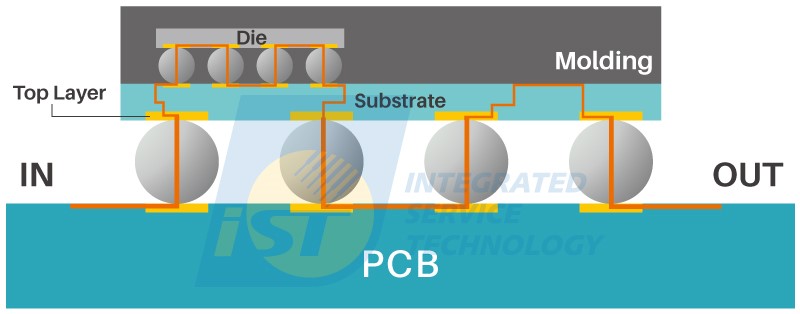

Level 1:將佈線持續延伸至零件內部,連結內部晶片之表面金屬層,觀察零件內部的Solder Joint(圖四)。就宜特觀察,這種 Daisy Chain 的設計方式被越來越多客戶接受。原因在製程能力提升後,堆疊層數增加勢必讓零件內 Solder Joint 承受更大的熱應力與機械應力。

Level 0:此種設計最為複雜,將 Level 1 設計方式再延伸至內部晶片(圖五),由於牽涉到晶圓設計製程,若使用者選擇 Level 0 設計,成本將會大幅提高。除此之外,BLR 即時偵測設備主要以低阻抗與低電流方式進行快速偵測,但此種設計的內部晶片常產生較高的阻抗,可能因超過偵測設備的規格,導致無法即時偵測,在設計前也須將這些因素考量進去。

圖 / 宜特科技

二、 驗證前之 PCB 設計

了解零件 Daisy chain 設計後,接下來就要討論 PCB。PCB 設計其實對於BLR壽命也佔了非常大的因素,PCB 層數越多也代表厚度越厚,層數越少則反之。厚與薄是否會影響到測試結果?答案是肯定的。

在溫度循環的環境下,因溫度讓整體產生熱脹冷縮的變化,反覆地針對 Solder Joint 進行溫度疲勞最終產生斷裂。假如 PCB 在熱脹冷縮的過程中,能和零件有一致的變形方向,就能增加其壽命,因此在設計 PCB 時,也建議考慮到與零件的匹配性

AEC 其實也有考量到零件最終使用的環境具備多樣性,PCB 層數與厚度難以固定規格,因此 AEC 不強制要求,讓供應商能以較貼近實際面的方式去設計PCB。對於產品資料蒐集也較具真實性,假若供應商無法獲得 PCB 規格的資訊,AEC 也提出一組 PCB 設計方針可供參考,其中較推薦的是 8 銅層與 1.6mm 的厚度。

三、正式進入車用可靠度測試手法:溫度循環測試

1. 測試目的:了解零件特性 而非通過驗證

當完成零件與 PCB 設計後,接下來就進入測試條件。AEC-Q007 首先提出的驗證方式為溫度循環,這裡先請讀者注意規範中的目的章節,開頭就提到是要蒐集零件 BLR 熱疲勞壽命的分佈數據,這代表此驗證是獲得樣品故障分析資訊,與我們常執行 BLR 驗證條件有些許不一樣。一般 BLR 測試條件,是以500或1000循環為標準,通過此循環即代表產品「通過驗證」;而 AEC-Q007 目的是「了解零件特性」,將資料蒐集做為未來使用者參考。

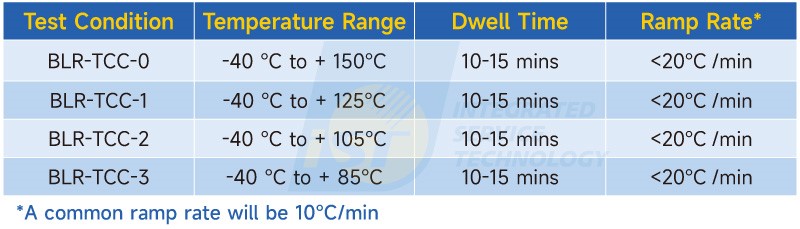

2. 測試條件:分為 4 級

溫度循環測試條件,參考 AEC-Q100 零件環境工作溫度等級進行分類,總共分為 4 級,最嚴苛為第 0 級。理想情況下,選擇的溫度條件等於或大於預期的應用操作溫度範圍(參考表一)。監控過程與判定方式則是參考 IPC-9701,高低溫駐留時間建議 10~15 分鐘。另外,規範中也提到溫度循環使用設備不應選擇快速升降溫,例如:雙氣槽式溫度衝擊與液槽式溫度衝擊。

3. 測試樣品數

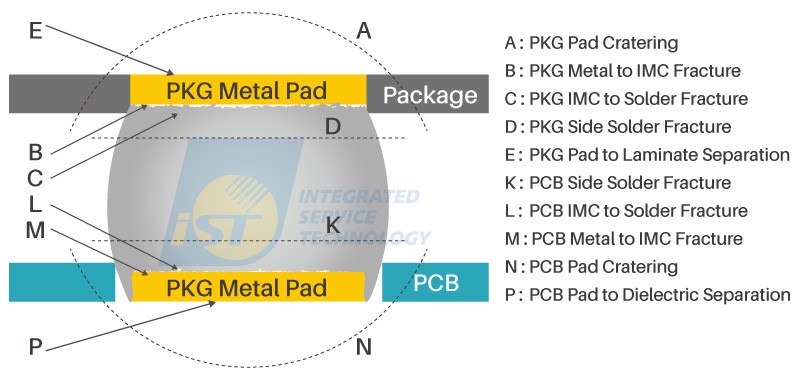

測試樣品準備數量應不小於 50+5 顆(包含故障分析),建議執行到所有測試樣品失效至 63.2%。假如執行一段時間後皆未故障,可停止於 3000 循環。AEC-Q007 有提到除了蒐集故障資訊外,對於已故障的樣品應進行故障分析,並記錄故障位置。針對 BGA 零件規範就定義了 10 種故障位置,若驗證過程未發生故障,也建議於每 500 循環,須將樣品取出進行切片或紅墨水分析。

4. SMT 定義參數

除了零件設計與測試條件,AEC-Q007 對於表面黏著技術(surface mount technology, SMT)也定義了設定參數。由於 SMT 的結果可能會影響可靠度的數據,SMT 後 Solder Joint 內會產生孔洞,孔洞的標準雖然有規範定義,但過大過小都有可能造成後續可靠度數據差異。規範中也建議 SMT 設定參數應接近供應商實際的量產條件,更詳細資訊可參考 AEC-Q007-002。

小結

AEC-Q007 首度跨出零件本體,搭配 PCB 驗證方式進行規範。目前雖然僅有溫度循環驗證方式,但這是因為車用零件在實際應用中會面臨各種溫度挑戰,如戶外環境、高低緯度以及接近發熱區域(例如引擎室)等。相較於消費型零件,車用零件的可靠度需克服更多溫度相關因素,因此「溫度」對於車用零件來說是最需要克服的關鍵因素之一。

宜特可靠度驗證實驗室針對 BLR 長期經驗觀察,Solder Joint 在長時間的溫度環境下,的確可能產生異常現象,AEC-Q007 的撰寫者以溫度為出發點是正確的,尤其是車用零件因考量到使用者安全性,必須更嚴謹看待。接下來,宜特預期 AEC-Q007 會持續提出其他的驗證項目,例如:機械衝擊、振動、濕度測試等等,以建置完整的驗證流程。

本文出自 www.istgroup.com