- 作者|理查.馬斯蘭(Richard Masland)

- 譯者|鄧子衿

如果你不知道目的地是哪兒,可能要設定其他目標。——尤吉.貝拉(Yogi Berra)

監督學習與無監督學習

我們每天都聽到機器學習能夠做到需要感知才能達成的任務:自動駕駛汽車、臉部辨識等。也有人擔心智慧機器失控所造成的危險,害怕有天它們利用遠勝於人類的智能,會掌控整個世界。不過這些討論絕大部分都沒有看到明顯的重點:機器學習的確能夠完成一些了不起的任務,但是研究人工智慧的傢伙全都深深了解到,現在最佳的人工智慧還比不上四歲的孩子。

原因在於,絕大部分著名的人工智慧演算法在學習技能時要人教,同時需要使用到極龐大的資料庫,並且得在超級電腦上執行。四歲幼兒只要知道幾個例子之後,自己就能夠學習。說真的,教自己小孩某些技能和概念時的確痛苦萬分,但是他們絕大部分知道的事物,都是基於基本的感知機制,自己教自己的結果,用他們小小的腦袋就足以完成。事實上,就算是多層級且具備反向傳播的感知器,比起我的小孫子還是差太多了。他不需要數不清的例子和教師,就能認得出自己的祖父。只要抱幾次就很快學會說「爺爺」這個詞。

人工智慧研究人員區分了監督學習與無監督學習。你應該記得之前提到那個標準的感知器需要教師。蘋果電腦的聲音識別軟體和咸諾斯基會說話的電腦也要。注重隱私權者所害怕的臉部辨識軟體也需要。你需要大量具備身分標籤的臉部照片,才能夠教軟體辨識臉部。電腦能夠辦得到是因為計算速度非常快,事實上,最近幾年機器學習獲得的成就,主要來自於最近(五年)有了能夠用來訓練的資料庫,以及大型的客製化電腦。腦中神經元運作的速度很慢,無法看這些電腦相比。

但是腦部的能力遠超出這些電腦。在赫柏原始的概念中,創造細胞群組的方式是無監督學習:在邊緣上連續的點本來就會一起出現,腦中的邊緣敏感細胞也是自己出現的。目前電腦科學家迫切的任務之一,是建造出訓練過程如大腦的機器。

電腦也是從錯誤中學習

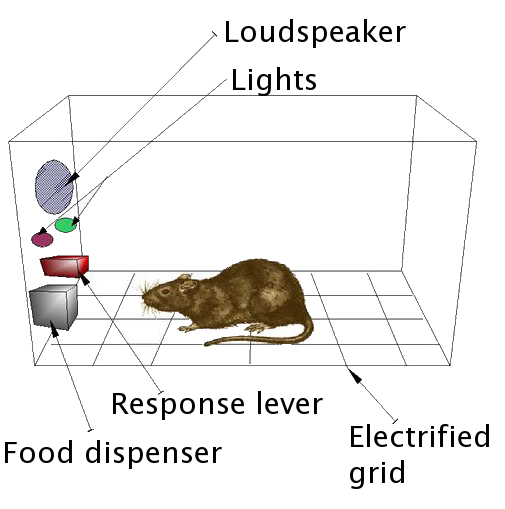

我很快就會回來談腦部,不過先說明另一種機器學習形式的例子,這種形式結合了神經網絡和一個新方法。電腦科學家大方的用神經科學的名詞來稱呼這類策略:增強原理(principle of reinforcement),最早有系統進行這方面研究的是偉大的俄羅斯生理學家帕夫洛夫(Pavlov),哈佛大學的史金納(B. F. Skinner)等後繼者發掘了其中的細節。電腦科學家稱這種這種演算法為「增強學習」(reinforcement learning)。「增強」的意思是某種行為會得到報償,如果電腦受到了報償,就會重複那種行為。這個過程讓正確的行為比較容易受到重覆,在神經網絡中的突觸會受到加強,你可以說這是一種反向傳播。增強學習與感知學習很像,只不過電腦會自己製造教師。

電腦也可以得到報償。在增強學習的過程中,電腦得找尋一個目標,它會隨便亂猜,剛開始都猜錯,但是如果某個猜測結果稍微接近目標,就會得到報償。電腦得到的報償不是一塊電腦狗糧,而是得到訊息:「幹得好,增強剛才你做出這個猜想時用到的突觸。」接下來電腦會繼續猜,這次會使用新的加權。接下來的步驟你可以想像出來:電腦會持續猜測,每次都調整加權,直到學得完成任務的方法。

人腦與電腦誰比較聰明?

增強學習已經精通了一項極為艱難的技術:下西洋棋,以及更為困難的圍棋。現在電腦的棋力超強,完全勝過人類,而且他們還是自己教自己下棋。我想到的一個演算法是 Alpha Zero,在二○一八年耶誕節前夕於《自然》雜誌上發表研究結果。研究人員只教 Alpha Zero 圍棋的規則:棋盤的模樣、下棋的方式等,之後演算法會自己和自己下西洋棋或是圍棋。這種作法聽起來違背直覺,重點在於每個「自己」並不知道另一個「自己」的思考內容,只知道對方下的棋步。也沒有教師,只有一些事先輸入的規則,讓電腦知道下的棋步是好是壞,以及判定輸贏的標準。四個小時後,電腦就具備了世界級的水準。

這真是非常了不起的成就,而且不只可以讓 Alpha Zero 下各種棋類,還可以讓它做別的事情。谷歌人工智慧團隊的大衛.希爾瓦(David Silver)展示了 Alpha Zero 利用遙控器操縱玩具直升機進行飛行特技,看到那個直升機進行筒狀翻滾飛行(barrel roll),真的讓人確信它有能力。

但是 Alpha Zero 真的比我的孫子聰明嗎?差得遠了(除非我孫子和它較量西洋棋)。電腦對於任務定義的範圍非常狹隘,而且體積要比我孫子的腦大多了,也不能光靠巧克力夾心餅乾就能運作。史密森尼學會(Smithsonian)的吳凱薩琳(Katherine Wu)估計,Alpha Zero 硬體運作功率約為一百萬瓦,我孫子的腦只需二十瓦。會在這裡提到神經網絡和增強學習,是因為這兩者都屬於概念驗證(Alpha Zero 內部採用了神經網絡),證明了這種邏輯運算的結果雖然距離腦還差得遠,但的確比較接近腦。

人類的腦部是否也採用了類似深度神經網絡或是 Alpha Zero 所運作的方式?當然有,只是慢得不得了。人腦這種電腦是演化經由無數時光打造而成,其中的突觸和連結都縮小到極致。如果由一堆計算晶片組成的笨重電腦能夠辦得到,人腦也可以。

人工智慧領域中的人很清楚我的孫子遠勝過他們的電腦,並且也正在努力改進。每個人都猜電腦會有多聰明。我認為電腦最後會很聰明,我絕對不會想要和電腦競爭。有各種巧妙的無監督學習模式應用在電腦中,唯一的問題是要花多少時間才能追得上人腦,以及機器完成任務的方式和真正的人腦有多相近。更重要的是,機器完成任務的經濟效率能夠比得上人腦嗎,我會屏息以待這些結果。事實上就目前來說,光是超越人類的電腦所需要消耗的能量之高,就讓我無須擔心會電腦會掌控世界了。