- 本文轉載自科技大觀園,原文為《AI 再現社群網路上情緒用語的男女差異,卻能助人理解字裡行間的真實情緒——清大資工陳宜欣專訪》

- 作者/科技大觀園特約編輯|許君咏

A:「我以為你會早點回來一起出門吃大餐。」

B:「沒辦法,事情很多忙不完」

A:「可是今天是很重要的日子耶,我以為你記得」

B:「老闆就臨時交代事情走不開,不然到底要我怎麼樣?!」

看到以上這段對話,你能感受到這兩人的情緒嗎?是期待、緊張、悲傷還是憤怒的呢?

應該可以感覺得到A帶著有些失望、悲傷的情緒,然而他並沒有說出「難過」、「傷心」等表示悲傷的字眼,那我們是怎麼得知的?

清華大學資訊工程學系副教授陳宜欣說:「社會文化讓我們收到特定用字時,會在潛意識進入同一個情境裡。」人類就像裝有好幾個 sensors,在經驗的累積之下,人們能夠在情境中,透過字句接收到情緒,於是她開始思考,如果人可以學習,那機器可以嗎?

從數據分析看出發言者的情緒

情緒反映著心理狀態,而語言又是情緒的載具之一。陳宜欣副教授和團隊想出了一種用機器學習來分析情緒的新方法,利用社群網路的大數據找出蛛絲馬跡,與過去不同的是,他們拿掉了情緒用字,從常見字裡的「特徵」找出情緒型態。

「許多我們認為是中性的字眼,其實和情緒有關。」陳老師說,例如,他們曾在標資料的過程中,發現「學校」這個字竟然有 80% 是帶著悲傷的。也有些令人出乎意料的發現,譬如我們通常認為「希望」是很正向的,然而分析結果卻是「悲傷」,這有可能是因為我們在說「希望如何如何」時,往往是在一個不太開心的狀態中才會這麼說。

以往語言及情緒相關的研究,大多是由心理學家訪談,再進行人為標註,然而容易受到主觀判定、字彙有限等影響。而陳宜欣老師的團隊,起初從臉書粉絲頁抓取資料,將留言或貼文底下表情符號作為情緒特徵。由於社群媒體常作為人們抒發的管道,他們也發現,情緒用字是會隨著時代、潮流改變的,例如有一陣子社會案件頻傳,在網路上「恐龍法官」這個詞經常伴隨著憤怒。然而,同一個詞只會有一種情緒嗎?這可不一定,來看看下面這兩句吧!

「謝謝團隊裡的每一個人,我們才能完成這個研究。」

「真是謝謝你,毀了我美好的一天。」

發現了嗎?一樣都是使用「謝謝」,第一句是開心的,但第二句卻是無奈的。

「語言有趣的地方是,人類在溝通時,會用所謂的諷刺文」陳老師笑著說。因此,除了詞本身,上下文也須納入考慮。也就是說,不同文字各有其表達的概念,組合起來後才會形成語意。在與人互動的過程中,語言是傳遞訊息的媒介,乘載著我們的情緒與想法。但並非每次的傳遞都是順遂的,有時我們會用中性的字眼包裝強烈的情緒,對方不見得能理解背後的含義;有時「說者無意,聽者有心」,明明你認為這句話沒什麼,但某些用詞卻造成他人的誤解。

例如文初 A 說的「我以為你會早點回來一起出門吃大餐。」便是用期待的情緒來隱藏悲傷、失望。而 B 最後回答的「不然到底要我怎麼樣?!」,或許他自己認為沒有什麼用意,但在 A 聽起來可能會以為 B 是帶著憤怒在說這句話的。

「人在溝通時,有時候講的話跟別人收到的不一樣。」陳老師這麼說。不僅聽者可能會誤解,有時甚至連自己都能夠騙過自己。陳老師表示,隨著研究,她也逐漸了解到,我們平常認為平和的說話方式,原來暗藏著許多「眉眉角角」。

訓練 AI 分辨情緒用詞,發現男女不同情緒表達方式

提到語言裡的「眉眉角角」,那男生和女生表達情緒的方式會不一樣嗎?

陳老師在收集資料時發現,把性別納入考量,得到的結果會更準確。比如說同樣是憤怒的情緒,女生比較常用「期待」的語氣來表示,例如「我以為⋯⋯」、「我想說⋯⋯」,而男生可能會用一些強烈的字眼,例如 f**k,或是等事情過去才表達。

後來他們分別訓練出男生和女生的情緒分析器,輸入只標註情緒但不區分性別的詞,果真得到不一樣的結果。像是原本帶著「期待」情緒的詞,女生的情緒分析出來是驚訝,但男生的卻是憎恨;帶「悲傷」的字,女生的結果卻是期待,男生的出來則是憤怒。

陳老師表示,可能是在社會文化薰陶下,不論男女在表達情緒時總習慣以「不直接」的方式包裝,尤其是負面情緒。

運用 AI 分辨情緒,找出躁鬱症徵兆

於是他們開始思考,這樣的發現是否能應用在男女表現差異較大的心理疾病上。後來,他們嘗試開發方法,能從社群平台發文動態中,偵測發文者的精神狀況,希望能協助受躁鬱症困擾的人。

躁鬱症又稱為雙極性情感疾患 (bipolar disorder),發作時會導致情緒失調,情緒會在狂躁(異常興奮)以及抑鬱之間擺盪。但有時女性躁鬱症患者會被誤診成憂鬱症,原因是當她狂躁時表現得比較像精神變好,與醫生認知的不同。

陳宜欣老師的團隊搜集了上萬則的動態發文,除了用字之外,也從生活型態,例如發文時間、頻率等等,從行為中找出一些規律,最後訓練機器學習演算法,綜合各項特徵來區分初期徵兆。希望可以透過早期發現,給予患者需要的幫助及治療。

洞見不鼓勵負面情緒的網路社群

從作情緒分析,到後來應用在心理疾病的偵測上,陳老師提及開始研究情緒語言的契機,當時,第一個博士班學生來找她時,抱怨怎麼都搞不懂女朋友到底在想什麼,有沒有辦法可以利用機器學習知道一句話背後的情緒。加上她是三個孩子的媽媽,小朋友表達情緒的方式更是非典型,陳老師笑著說,她會想像小孩內建一個 model,與他們相處的過程中,不斷 trial and error,就會發現有趣的事情。也因為去上媽媽教室及身心靈課程的關係,讓她時常用兩種觀點思考、相互結合。

在研究情緒的過程中,發現人在某些時候會害怕自己的脆弱被看見,究竟是為什麼呢?

陳老師分享,她在中央大學副教授陳永儀的 TED 演講中找到原因,其中有句話說「這個社會常常只獎勵正面情緒」,好像表現出樂觀、正向才是好的,但如同他們在研究中發現的,當我們用另外一種情緒包裝負面時,其實對方不見得接收得到,溝通上的誤會便發生了。於是陳老師想,如果我們都能直接說出心裡的感受,或許許多衝突或傷害便能夠被避免。

回到文章開頭 A 和 B 的對話,若 A 明確地向 B 說:「今天是我們很重要的日子,你沒有早點回來一起吃飯,讓我覺得有點難過。」B 在接收到 A 的情緒後,或許更能夠同理並說出自己的苦衷,使兩人的頻率一致,達成溝通。

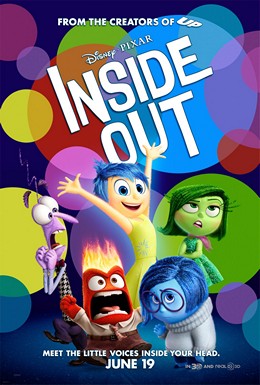

「我認為人際連結最好的方式是——適度表達悲傷」陳老師說,她在撰寫部落格時,觸及率最高的竟然是分享自己升等失敗的文章,就像電影《腦筋急轉彎》裡的角色憂憂 (Sadness) 。把悲傷說出來,除了讓他人了解你的需求外,也能使其他有過相同遭遇的人,知道自己不是孤單的。

以 AI 為鏡,可以看見自己

在人人都說 AI 可以改變世界的今日,AI 真的能解決人類面臨的種種問題嗎?

陳老師表示,不要期待 AI 能夠解決問題,真正能解決問題的是人,機器只是輔助的工具,但只要是工具都像一把雙面刃,然而,她相信 Nokia 的那個廣告標語「科技始終來自於人性」,在決定要做什麼之前,先想最壞、最極端的情況,若還可以接受才會繼續做,不論未來如何發展,最根本的初衷是要考慮人性。

而在作研究的歷程中,陳老師發現人的確會在某些情況下,提供一些本身也不知道的資訊,也就是說,我們可能連自己都不太了解自己。小時候常被叮嚀的「吾日三省吾身」,但若原本認為的就是錯的,再怎麼想可能都還是得到一樣的結果。因此,她希望 AI 能夠像一面鏡子,幫助人們看到不願看見的自己,能夠更了解自己。