本文由 量子音樂 委託,泛科學企劃執行

- 文/YC WANG

「玩射擊遊戲先看到火光,才聽到槍聲,還沒來得及反應就死了!」、「玩太鼓達人聲音和畫面不同步,玩得好痛苦!」你也曾有過類似的經驗嗎?

習慣使用藍牙耳機的人,對於「藍牙延遲」大約都不陌生。到底為什麼藍牙耳機會有聲音延遲的問題?隨著技術的進步,又有什麼新的方法能減少這個潛在惱人的困擾?挑選耳機,怎樣才能符合自己的需求?

泛科學這次訪問量子音樂創辦人蔡明耀(Hikari),請專家來一一解釋什麼是藍牙延遲,並對於不同屬性的用戶挑選最適合自己的藍牙耳機,提出一些建議。

聲音延遲……為什麼專業音樂人無法忍受?

「延遲會遇到的狀況其中一項是回音,你在錄 podcast 時,會聽到,Hi Hikari,然後馬上又再有回音 Hi Hikari。」量子音樂的 Hikari 也是一名混音師,他每天工作的日常除了音樂製作、聲音系統還有人工智慧的研發。

他表示,在工作上對於聲音的傳輸,需要嚴苛要求「低延遲」,尤其是在錄音室中,錄音要求延遲在 30 毫秒以下。目前大多錄音室都採用數位設備,數位設備較有機會造成延遲回聲等效果,無論是歌手錄音或 podcast 製作上,均難以接受明顯的聲音延遲。不過,除非經過特殊訓練,否則一般人耳僅能辨別出 60 毫秒以上的延遲。

相較於數位設備,類比器材的速度較快也不會造成延遲,但目前在聲音的編輯處理上,時常需要轉數位化,這也就是造成延遲的開始。

為何類比較不會有延遲的問題?類比音訊的輸出與輸入是透過線來傳輸,不需要經過類比、數位的轉換。但類比雖然速度快,在聲音調控上就完全要靠類比電路,操作不易,目前為了聲音編輯,大部分的聲音處理也主要採數位化,缺點就是有延遲的可能。

藍牙耳機延遲問題究竟可以如何改善?

其實除了 Hikari 提到在音樂製作上專業上不容出現的聲音延遲,在玩遊戲或看電影的時候,「看到火光之後慢半拍才聽到『砰!』」應該是選用藍牙耳機或喇叭的人都有過的經驗。

為什麼使用藍牙的音響系統,會有這種延遲問題呢?藍牙延遲簡單來說就是:「當藍牙訊號開始傳輸,到接收端收到訊號的時間差」。

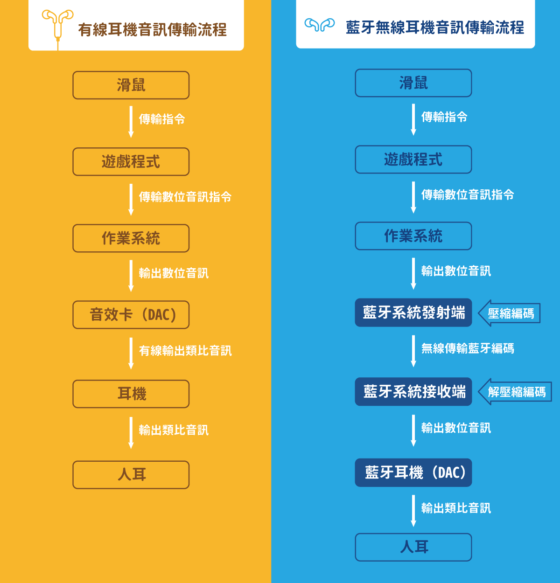

藍牙是無線傳輸,聲音源透過「藍牙立體聲音訊傳輸協議」(Advanced Audio Distribution Profile, A2DP)來傳輸訊號,並只能在有限的頻寬下,透過編碼壓縮的方式傳遞音樂訊號,而藍牙接收端(耳機、喇叭裝置)接收訊號後,便會解壓縮藍牙訊號、轉成數位音訊,最後再輸出給裝置上的DAC(數位類比轉換器),然後聲音就會傳到我們的耳朵裡了。

這段音訊訊號傳輸的過程所產生的時間差,便是所謂的藍牙延遲。

藍牙透過 A2DP 協議來傳輸訊號,一開始是以「能聽到不斷續聲音」而設計。為了避免遭到干擾,藍牙預備了一個的緩衝區(buffer),一個傳出一個接收,如果中間有斷音、不連續,就可以用緩衝丟出音訊,也因此而有延遲。但隨著藍牙耳機用途越來越廣泛,不再像過去只用在通話上時,藍牙延遲問題就需要被改善。這也是藍牙耳機難以應用於製作音樂、錄音、電競產業的主要原因。

其實,像是 Netflix或 YouTube 串流影片有調整延遲的協定,也就是設計當聲音變慢了,畫面也一起變慢,藉由「一起延遲」來解決影音不同步問題。然而,這樣的設計無法應用於電玩,因為遊戲的影像是即時生成,聲音馬上就出來了,因此延遲的問題就較為棘手。

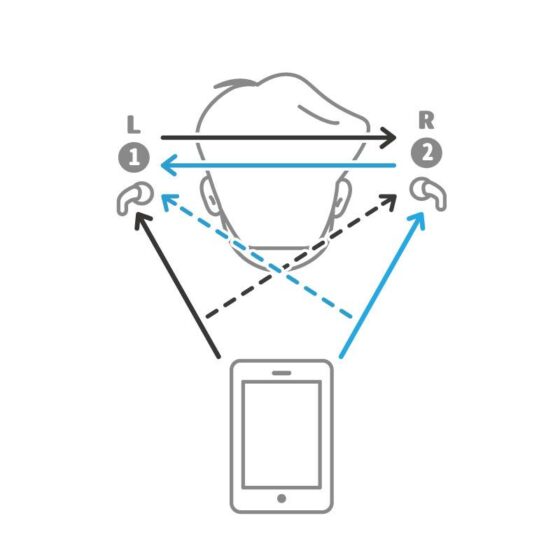

那要怎麼讓藍牙延遲不要這麼嚴重呢?改善的做法之一,在於改進通訊設計。過去藍牙的兩個耳機是兩個藍牙裝置,由裝置傳到 A耳機(主要耳機),再傳到 B耳機(副耳機)會造成二段延遲。

為了解決二段延遲問題,先是將雙邊耳機都設計成可以跟系統溝通的主要耳機,再用 Sniff(監聽)到通訊協定的作法,緩衝就不用設計的那麼長,能降低延遲、縮短傳輸的時間。

優化後就不一樣!藍牙低延遲排行公開

除了優化通訊設計,要改善藍牙延遲的問題,可以調整的細節很多,包括優化傳輸編碼以及天線、晶片優化等各項調整,就有機會維持可接受的音質,並有效改善延遲情況。

挑選藍牙耳機時,最常出現的討論當然還包括傳輸編碼的選擇。

藍牙傳輸的編碼,主要可分為四種常見規格:SBC、AAC、aptX、LDAC。在數據的封包傳輸量上,一般來說,SBC<AAC<aptX<LDAC。越後者理論上封包越大,越有機會延遲。

但除了考慮到延遲,實際應用還有支援度與音質的問題。

首先,討論支援度的部分。SBC、AAC 是普遍手機、電腦都具有的編碼規格,而 aptX則是高通所開發的一系列編碼(包括 aptX、aptX HD、aptX LL、aptX Adaptive)。目前 Android 手機普遍支援apt X、aptX HD規格,但 iPhone 就沒有支援aptX系列,僅支援SBC與AAC;另外,aptX LL雖然很快,但目前沒有任何手機支援。而 LDAC 則是 Sony 獨家的技術,目前僅有少數高階藍牙耳罩耳機有支援此項傳輸協定,音質好但延遲問題明顯。

前面描述的規格僅限於一般的規範,實際上還要看耳機的優化狀況。有些討論中常誤解認為 AAC 技術在傳輸速度必定輸給 aptX LL,但實際上考量到支援度,已經有開發團隊以優化 AAC 的方式來改善延遲問題。最知名的例子就是,在Apple生態系之下,iOS系統連接蘋果的藍牙耳機 AirPods Pro,經過優化的結果,就要比一般藍牙耳機透過 AAC 連接 iOS 延遲還要低上許多。因此加入「優化AAC」選項後,藍牙傳輸速度排名:優化AAC > aptX LL>AAC>aptX。

再來,討論音質的部分。影響音質的因素很多,耳機的整體配置都會有所影響,包括耳機共鳴體、驅動單體、組件搭配……等,再加上考慮到使用情境,若大多聽 KKBOX、Spotify、YouTube 等串流音樂,「優化 AAC」在音質與降低延遲取得平衡可以有很不錯的成效,提供使用者最佳的體驗。

怎麼選擇藍牙耳機?便利性、環繞音、低延遲

討論到最後,我們問到混音師 Hikari 對於藍牙耳機音質的評價,他坦率表示曾實際測試多款耳機。現有的藍牙耳機對專業混音師來說,完全難以達到工作所需要的音質,但他個人並不排斥在生活中使用。在通勤等生活情境中,藍牙耳機的「方便性」是他最在意的優點之一。

對一般消費者來說,選擇耳機主要要考量喜歡聽哪種頻率的音樂,例如中頻很好的耳機,拿來聽蔡琴的聲音很理想,但拿來打遊戲可能就聽不到敵方腳步聲的聲音。

對Hikari來說,選擇合適的耳機,跟使用情境與慣聽的音樂屬性有很大的關聯,對想一邊舒適地聽音樂、又可以通話,甚至想要輕鬆玩遊戲的人來說,無線藍牙耳機肯定是最好的選擇啦。

以下是他的推薦名單,如果你也有各種心頭好,也不妨推薦給我們吧!

Hikari推薦耳機名單

- 注重隔音、主動降噪(ANC),想隔絕外部噪音:

Airpods Pro、Sony WH-1000XM4 - 注重中低頻響應,適合電音、Dubstep聆聽且具備情境切換功能:

jlab jbuds air executive - 低價但擁有不錯音質的超高CP值耳機:

pamu scroll plus - 錄音與音樂製作,或是想要發燒耳機品質:

Sony MDR-900ST、BEYERDYNAMIC DT1770 pro (所有藍牙耳機都不適合,請乖乖用類比耳機)