- 文/Te-Yi Hsieh,現為英國University of Glasgow 博士生,主修 Neuroscience and Psychology。研究領域介於心理學、機器人學、神經科學的交界處。欲知更多研究相關資訊可關注:http://www.so-bots.com/

Twitter: @TeYiHsieh

人工智慧(artificial intelligence,AI)、機器人絕對是近年最火紅的話題之一。人們開始意識到科幻電影裡的場景可能即將在現實生活中發生,一則以喜一則以憂。喜的是科技進步帶來的便利性,例如,機器人也許能補足老年化、少子化社會,照顧者短缺的問題;憂的是,機器人會搶走我們的飯碗,甚至,有些人開始擔心智慧爆炸(intelligence explosion)註1的極端情境。

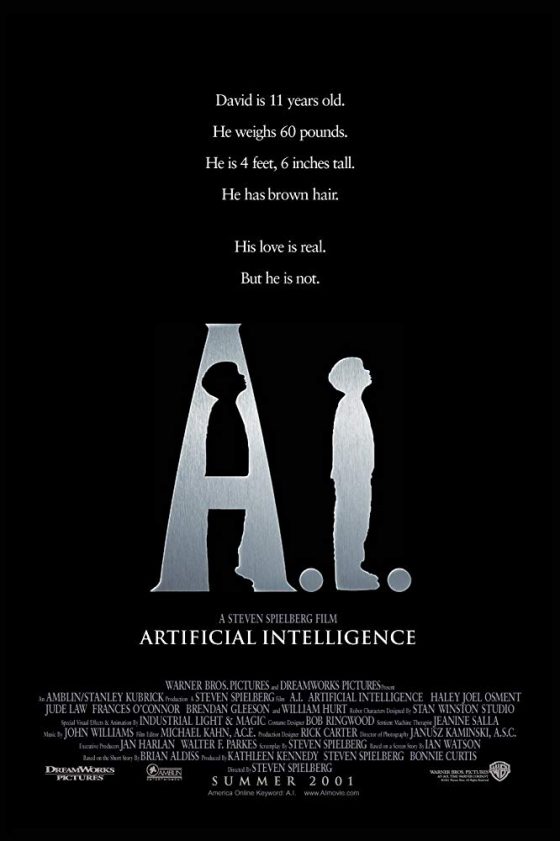

從社會的層面來看,這些似人非人的機器人,究竟會在我們生活中扮演怎樣的角色?當它們擁有人類的外型、語言、甚至情緒表達,我們會只視它們為無生命的機器、工具嗎?這個問題,我們可以從 2001 年的電影《A.I. 人工智慧》(A.I. Artificial Intelligence)談起。

人類能夠愛機器人嗎?《A.I. 人工智慧》

電影《A.I. 人工智慧》描述一個科技高度發展的未來世界(對現代來說仍是未來),一家機器人公司研發出第一個懂得「愛」的機器人小孩──大衛。在此同時,該公司的員工亨利與太太莫妮卡,正面臨親生兒子馬丁因絕症而冷凍睡眠的絕望中。這樣的家庭悲劇讓亨利成功為公司選中,成為這個新型機器人小孩的第一位使用者。

太太莫妮卡起初是憤怒且強烈反對。「沒有任何東西能取代我們的孩子!」她對亨利大吼。但日子一天天過去,大衛極盡真人的外貌、行為、情緒反應讓莫妮卡很難只把大衛當作一個「機器」對待,加上自己深知親生兒子馬丁也許永遠無法甦醒,莫妮卡開始放下心中的抗拒感,再次歡笑、重拾「當一位母親」的快樂。然而,這將是一個不可逆的決定,機器人小孩對特定對象的愛無法刪除,無法重灌,要是收養者事後反悔,機器人只能被送回原公司銷毀。

正當大衛要在新的家庭展開生活時,意想不到的事發生了──莫妮卡與亨利的兒子馬丁的病情好轉,並從冷凍中甦醒。馬丁返家後為整個家帶來了不定時炸彈。人類的手足、同儕之間都時常互相較勁了,更何況是人機之間。馬丁打從心底認為大衛不配分散媽媽對他的愛。而大衛雖然僅是單純想得到母親的愛,卻不懂人類世界複雜的社交方式,無心之間做了許多傷害媽媽、傷害馬丁的行為。最終,莫妮卡、亨利為了保護兒子的安全,做出了棄養的決定。

就在莫妮卡即將載大衛回公司銷毀的前一刻,她心軟了,她打開車門,叫大衛快逃往樹林,遠離人群、不要被任何人類抓住、不要被銷毀。

「問題不是製造學會愛的機器人,真正的問題是⋯⋯人類能不能愛它們?」

機器人是否「為人」,標準在哪?

機器人能不能學會愛、有沒有感受力、有沒有意識?這可以是一個難以得到共識的哲學思辨。首先,何謂愛?何謂感受?何謂意識?科學家目前對人類的意識如何運作、在腦中的神經活動中如何產生都爭辯不休了註2,我們如何輕易定論機器人有沒有辦法擁有意識、學會愛呢?

根據心理學家 Haslam、 Loughnan、 Kashima 與 Bain(2009)所進行的大眾實際調查,以及其形成的理論,一個簡單的答案是:機器人也許可以學會情緒「表達」,但它們沒有「情緒感受力」。

Haslam 及同事透過一系列調查研究,試圖找出「為人」(humanness)與「去人性化」(dehumanization)之間的界線。換句話說,找出有哪些重要因素,讓我們判斷一個對象「為人」;相對的,當沒有這些重要因素時,我們會把此對象判斷為非人。他們進行一連問卷調查研究,以及內隱聯結測驗(implicit association test,IAT)註3,測量參與者對四大類對象──人、機器人、動物、超自然事物──的想法及態度,並藉由比較「人」與「非人」對象的看法,歸納出哪些特質、心理狀態是專屬於「人」這個概念的。

結果發現,不管在東、西方的文化中,人們對「為人」的概念主要由兩個面向組成:

一是「人類天性」,包含有生命及無生命體本質上不同的所有特質,如情緒力(emotionality)、欲望(desire)、好奇心(curiosity)、自主行為能力(agency)等;

二是「人類特殊性」(human uniqueness),包含邏輯思考、推理等的認知能力,以及受社會、文化影響下的特質,如禮貌(politeness)、勤勉正直性(conscientiousness)等。

缺少「人類天性」的特質,一對象會變得冷酷、機械化;而缺少「人類特殊性」的特質,一對象會趨近於動物。因此,人類與機器人的主要差異在於「人類天性」。機器人可以擁有「人類特殊性」,可以推論、理性思考;但不具有「人類天性」,無法感知情緒、產生自主欲望。

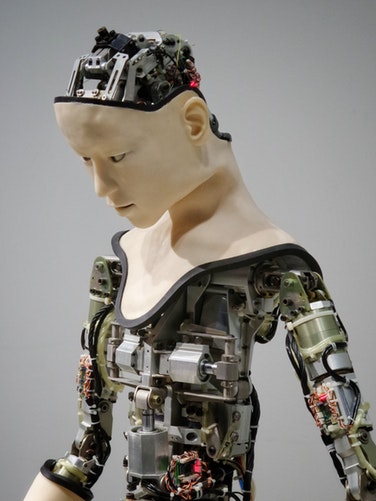

機器人也許可以有非常似人的外表、擬真的社交互動註4。但就本質上而言,它們的情緒表達再真實,都不是因為真的「感覺到」這些情緒而做出外顯反應,而是被設計、製造而得以如此。

既然我們認為機器人實際上無法感受、沒有痛覺、不會真的有負面情緒,為何電影《A.I.人工智慧》中莫妮卡會忍不下心將大衛銷毀?難道只是電影劇情需求嗎?不盡如此。從目前人機互動(human-robot interaction)的眾多實驗結果來看,我們對待機器人確實會比對待電腦、家電等機器時,有更擬人的互動,尤其是當機器人具有擬人特質時(例如外貌、情緒)。

人會同情機器人?

Seo 與同事設計的研究 (2015) 中,受試者需要與機器人 Nao 合作進行遊戲。在遊戲進行數分鐘後,Nao 開始出現一些故障的跡象(這當然是實驗者事先設計好的),像是動作、說話變得不流暢等等,這樣的故障會隨著時間越來越明顯。而在 Nao 出現故障的狀況後,它會表現出害怕跟擔憂的樣子,並向受試者說它很擔心實驗者發現它故障,會把自己的記憶消除、它不希望忘記跟受試者玩遊戲的快樂回憶。然而最終,實驗者還是出現、並在受試者面前把 Nao 更新了,更新後的 Nao 會展現完全不同的說話方式跟特質(這是為了讓受試者相信記憶真的被消除了)。

在這一連串的情境之後,受試者接著會填答一些問卷、回答他們在實驗中的感受。

結果顯示,人們確實會對這個 Nao 產生同情、同理的情緒,有些人甚至替 Nao 向實驗者求情。

然而該研究並沒有直接比較人們對機器人、人、非擬人機器(如電腦)的反應,再者,自陳式問卷一直是被受質疑的測量方式。因此,目前已有很多神經心理學家,使用腦造影技術如「功能性磁振造影」(functional Magnetic Resonance Imaging,fMRI)來了解我們與機器人互動時大腦的活動。

在我們腦中比機器更接近人,但仍不是人

如 Krach 與其同事(2008)的研究,他們透過 fMRI 的技術發現,人們腦中掌管「心智理論」(the Theory of Mind,ToM)註5腦區──主要包含內側前額葉皮質(medial Prefrontal Cortex, mPFC)與顳頂葉接合(temporoparietal junction,TPJ)──在與擬人機器人互動時,活化程度會比與機器手臂、電腦(不具人型外表)互動時高。但仍比不上與真實人類對象互動時的大腦活動。

換言之,機器人似人的外表,會讓我們的大腦認為它們—某種程度上──是具有心智(mind)的。機器人對我們來說,不會完全等同於電腦、手機等沒有擬人特質的機器,但也不會對待它們(機器人),全然像對待其他人類一樣。

然而,不同證據在 Chaminade 團隊(2012)的研究中也被發現了。Chaminade 與同事比較了受試者面對人、機器人、電腦等不同對象時的大腦活動狀態,卻發現負責心智理論(ToM)的腦區只在與人互動時有顯著的活動。

支持不同假說的結果存在於目前文獻中,尚無法達成一個定論。這或許是因為此領域的新穎性,我們需要更多的「重複驗證研究」(replicate study)來確立一個現象的真實性,加上不同研究者使用的機器人、作業、研究環境、指導語有些不同,都可能為研究結果帶來變數。可以確定的是,此領域的研究結果將會相當可期,AI 機器人等科技在未來社會的利用,可說是一個相當確立的趨勢。從心理學、神經科學的角度來看人機互動,不但對機器人設計能帶來幫助,同時也使我們更了解人腦的認知運作方式。

大衛最後實現願望了嗎?

說到這裡,也許有些讀者還相當在意,《A.I. 人工智慧》中機器人小孩大衛最後到底怎麼了?大衛被放逐後,踏上了旅程尋找木偶奇遇記中的藍仙女,希望她能把自己變成一個真實的男孩,因為大衛深信,唯有這樣才能真正得到母親的愛。然而這個心願當然沒有實現,兩千年過後,地球已完全結冰、人類也已滅亡,外星人挖出了冰層中的大衛,欣喜於發現這個相當「原始」的機器人的同時,也決定為大衛完成心願──讓母親莫妮卡重生,但只能存活一天。在這得來不易的一天中,大衛終於得以享受專屬於母子的快樂時光,沒有亨利、沒有馬丁。夜幕將至,母親即將再度陷入永恆長眠之際,對著他輕輕說:「我愛你,大衛,我一直很愛你。」大衛流下眼淚,彷彿長久以來的願望終於實現,也終於能隨著母親,一同長眠。

這樣有些令人惆悵的結局似乎也透露著,要機器處理人類的感情訊息何其困難(很多時候我們自己都無法理解了!)母親當然是愛著他的,但大衛直到最後一刻才明白。

以現在的技術,人類也許還無法製造出像大衛一樣,可以如此自然互動的社交機器人,但如果有一天我們的科技做到了,你會如何看待這些乍看與真人無異、但本質上截然不同的對象呢?

- 註 1:智慧爆炸(intelligence explosion)意指當人工智慧學會自我進化,其所擁有的智能將在極短的時間內超越人類所擁有、所能控制的情況(參考資料 1)。但也有意見主張智慧爆炸不可能出現(參考資料 2)。

- 註 2:有興趣了解神經心理學家關於「意識」的理論,可見參考資料 3 為一例。

- 註 3:「內隱聯結測驗」最早由 Greenwald 及其同事(1998)提出,是一種藉由測量受試者對特定詞組的反應,來得知其內隱態度的測量方式。此方法,相較於自陳式問卷,較能排除受試者想符合社會期許所造成的答題偏誤。

- 註 4:雖然這目前仍是非常難以達到的境界。人類的社交活動,仔細分析下來其實非常複雜且精細,包含了各種大大小小的社交線索。更有一派說法認為,人類大腦的認知能力遠超越其他物種就是為了應付複雜的社交場域—詳見參考資料 5。

- 註 5:「心智理論」意指在瞭解他人的心智狀態的功能。例如,站在別人角度思考、同理他人,都是會使用到心智理論的情境。

參考資料

- Ted Talk「人工智慧的長期未來」

- The implausibility of intelligence explosion

- Graziano, M. S., & Webb, T. W. (2015). The attention schema theory: a mechanistic

- account of subjective awareness. Frontiers in Psychology, 06. doi:10.3389/fpsyg.2015.00500

Haslam, N., Loughnan, S., Kashima, Y., & Bain, P. (2009). Attributing and denying humanness to others. European Review of Social Psychology, 19(1), 55–85. - Adolphs, R. (2009). The Social Brain: Neural Basis of Social Knowledge. Annual Review of Psychology.

- Seo, S. H., Geiskkovitch, D., Nakane, M., King, C., & Young, J. E. (2015). Poor thing! would you feel sorry for a simulated robot? Proceedings of the Tenth Annual ACM/IEEE International Conference on Human-Robot Interaction – HRI ’15. doi:10.1145/2696454.2696471

- Krach, S., Hegel, F., Wrede, B., Sagerer, G., Binkofski, F., & Kircher, T. (2008). Can machines think? Interaction and perspective taking with robots investigated via fMRI. PLoS ONE, 3(7), e2597. doi:10.1371/journal.pone.0002597

- Chaminade, T., Rosset, D., Da Fonseca, D., Nazarian, B., Lutcher, E., Cheng, G., & Deruelle, C. (2012). How do we think machines think? An fMRI study of alleged competition with an artificial intelligence. Frontiers in Human Neuroscience, 6. doi:10.3389/fnhum.2012.00103