文/歐陽太閒|就讀美國哥倫比亞大學電機工程研究所博士班,研究領域為系統生物學、高通量定序資料分析與癌症生物標記。

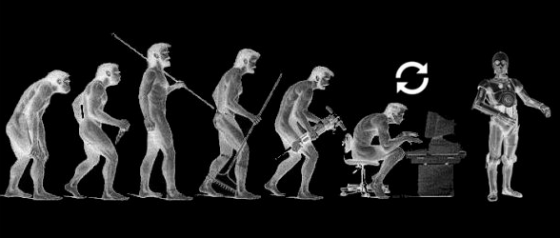

人工智慧(Artificial Intelligence, AI)廣泛地指有能力自行做出合理決策以解決現實世界中的複雜問題的人造系統,其可能有能力進行邏輯推理、計畫、知識學習、表達、自然語言處理(natural language processing)、感知(perception)和物理世界互動等。其相關研究曾在 1970 年代沉寂一時,但近十年來因為機器學習技術的進步、電腦運算與儲存成本的降低,以及大量的資料累積使其技術與應用快速發展,讓人工智慧系統不僅在以往被認為是人類專利的領域擊敗人類頂尖高手,例如 AlphaGo 戰勝了圍棋棋王,在實務應用上也獲得多項重大突破,例如程式化金融交易、異常金融操作自動預警已經獲得普遍應用,自駕車與無人機也已逐步邁向實用化,展現出人工智慧技術巨大的潛能,但也因此引出不少擔憂的聲音。

白宮提出人工智慧白皮書

為了因應人工智慧快速發展可能帶來的衝擊,許多國際組織均已提出討論,如聯合國、經濟合作暨發展組織(OECD)、亞太經濟合作組織(APEC)等。各國政府與人工智慧學會也提出研究報告,其中美國白宮科學技術委員會(National Science and Technology Council, NSTC)於今(2016)年 10 月提出的白皮書,除了介紹當前人工智慧發展的概況外,也對人工智慧對社會帶來的衝擊提出回應方針,本文將以該白皮書的建議為基礎,提供臺灣政府與企業或可參考的方向。

就政策涵蓋範疇而言,泛用人工智慧(Artificial General Intelligence,或稱強人工智慧)可能有能力進行人類大部分的工作,但目前還不知道要如何建立這樣的系統,也不確定還需耗費多長時間才能研發成功,故除了需持續投入資源研究外,短期內不會對社會和政策造成太大影響。然而能解決特定問題的弱人工智慧則已經逐漸出現在日常生活中,除了熱門的自駕車外,能自動規劃行程的導航系統、購物網站的商品推薦功能都可以算是這樣的系統,而導入人工智慧的領域正在快速增長,並深入日常生活各層面,這才是政策上應該重視的部分。

人工智慧的挑戰

人工智慧在公領域的應用正在起步,例如在美國匹茲堡(Pittsburg)城市內實驗將交通號誌交由人工智慧即時調控,讓交通等待時間和汽車廢氣排放改善了 21 ~ 42 %;華特瑞德國家軍事醫療中心(Walter Reed National Military Medical Center)已經導入人工智慧協助診療;芝加哥大學、南加州大學和史丹佛大學分別啟動嘗試藉人工智慧解決失業、輟學、遊民、貧窮等社會問題的研究計畫;美國政府亦提出資料導向司法(Data Driven Justice)和(shutterstock) 警察資料計畫(The Police Data Initiative),以藉人工智慧技術改善司法與警察體系的效率;在野生動物保育、國土監測方面的例子則有多國合作的海龜保育計畫「龜聯網(The Internet of Turtles)」。

然而人工智慧的快速發展可能對社會帶來全新的挑戰。人工智慧在日常應用的普及化將可能導致教育水平和工資偏低的民眾失業,同時增加所得差距;也將改變現有的企業管理方式與成本結構,例如亞馬遜公司除在物流倉庫中導入機器人外,也已經開始讓人工智慧系統指揮倉庫中的人類員工工作、提升效率。相對而言,落後的企業將需要負擔更高的成本,難以和領先者競爭。

由於無人駕駛的交通工具將和有人駕駛的交通工具分享有限的道路和空域,因此需要修訂現有監理法規。若用於訓練人工智慧的資料品質不良,使得系統產生偏見,則可能導致其做出不公平的決策,例如法院的人工智慧輔助系統可能提出錯誤的司法建議,或者企業招募部門的系統審核求職申請時歧視申請者。人工智慧若應用於攸關生命與財產的領域,任何錯誤的決策或者系統遭受入侵都可能造成重大損失。

全心齊力突破挑戰

因此應對人工智慧帶來的挑戰並非易事, 需要產、官、學共同投入。公部門方面,政府應加強投資於相關研究與人力的訓練。目前美國非機密性的人工智慧研究計畫由聯邦政府的網路與資訊科技研發計畫(The Networking and Information Technology Research and Development Program)統一主管,去年投注在相關科技研發的經費是 11 億美元(新臺幣 348 億元),今年預估可達 12 億。同時也應該加強開放資料,但不僅僅是將檔案掃描成 PDF 放上網站,而是要將開放資料標準化成適於機器學習的格式(Open Data for AI),以便利各部門和民間人工智慧的發展。

因為工業界對於具有專才的研究人員需求快速增長使得薪水提升,因此應增加研究獎助預算、獎學金、實習機會、增聘教授與研究人員以吸引相關領域專家服務。而將人工智慧系統導入現實應用可能帶來無法預知的問題,一般政府部門除可聘用人工智慧專才改進現有系統外,也應邀集各領域專家協助新監管條例的建立與現有法規的修改,將使用人工智慧的裝置與載具納入法規的管理,並且對人工智慧系統的效能、可靠性和安全性訂出標準,保障公眾的安全也確保競爭的公平。也同時應加強政府與企業的資訊交流與合作,掌握最新的研究與應用進展,以及時做出回應。面對以人工智慧為基礎的自動化對經濟與就業市場的衝擊,則應制定政策使人工智慧帶來的經濟利益可以雨露均霑、公平分配,並研擬勞工就業問題的對策。

教育方面,學校應訓練更多具有資料科學專長的專家,如電腦科學家、經濟學家、資料庫與軟體工程師、資料分析家與圖書館員等。並且強化軟體開發課程中的相關方法、實務應用以及道德考量的訓練,並大力舉辦整合工業、社會、政府的人工智慧與資料科學競賽,確保勞動力熟悉其在各領域的實務應用。因為相關應用將進入生活中的所有層面,所以為確保民眾有足夠的資料素養(data-literacy)可以了解自身權益和參與相關政策的討論,資料科學教育可從小學開始。為了應對經濟衝擊,學校與職業訓練機構應提供學生與再進修人士學習相關技能的課程。

無論是政府或企業,發展人工智慧系統時都需要審慎評估其安全性,並使系統不會遭受入侵或不當運用,以免帶來生命財產的損失。人工智慧系統在研發、訓練和應用上都需要滿足公正、可問責(accountable)的要求,確保其的透明性、可控性和安全性,若發生意外時才可以釐清責任歸屬和保障民眾的權益。

人工智慧的發展與應用或許可以改善民眾生活,甚至帶動新一輪的經濟成長,但其影響也將遍及生活的所有層面,並帶來大量無前例可循的挑戰。這些挑戰不僅僅限於技術,更涉及道德、經濟、法律、社會,且發展速度極快,值得各界及早投入研究並提出對策。

〈本文選自《科學月刊》2016 年 12 月號〉

什麼?!你還不知道《科學月刊》,我們 46 歲囉!

入不惑之年還是可以當個科青