就在不久前的2015年6月22日,第三使徒薩基爾(Sachiel)襲擊了第三新東京市,製造狄拉克海的第十二使徒亦將出現,人類面臨空前的危機……[1]。等等!看過<新世紀福音戰士>動畫的人,或許在心裡都曾有過這樣的疑惑:「狄拉克海?那是什麼?可以吃嗎?」然而,要解答這個問題,我們得回溯到上個世紀。

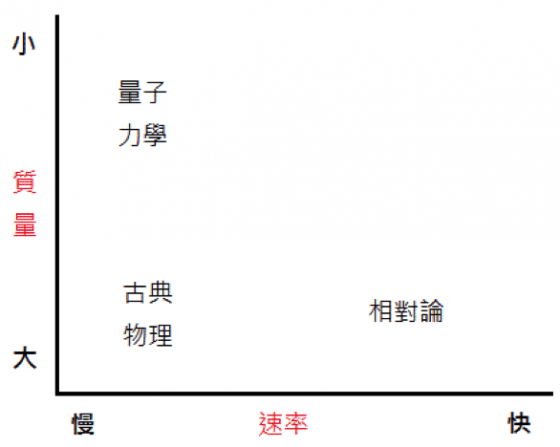

二十世紀初,物理學有了莫大的進展。愛因斯坦(Albert Einstein)先後提出了狹義與廣義相對論,革命性地改變了我們對於時間、空間和重力的認知。請各位回想在國、高中學習物理的經驗,你可能見過如下問題:

政客坐在以時速二十公里面對你駛來的車裡,你為了阻擋車子前進而以時速五公里正面飛撲到引擎蓋上(以上劇情純屬虛構,如有雷同實為巧合),那麼政客會覺得你用多少的時速撲上來?

先不論上述物理(或是情節)帶給你的痛苦回憶,愛因斯坦眉頭一皺,發覺這個問題並不單純:當車子與你均以接近光速移動時,答案就不是那麼顯而易見了—-因為除了閃電俠外,任何有質量物體的移動速率都不能等於或快過光速,政客也不該測到你以超光速飛撲而來。簡單來說,狹義相對論就是在處理此類議題——當物體運動極快、接近光速時的物理。

另一方面,從光電效應、氫原子結構等一連串的物理研究埋下根基,到薛丁格(Erwin Schrödinger)發表了著名的波動方程式,量子力學漸趨成熟。在那之前,只要討論到物體的運動(例如中學課本裡那些移動的火車),牛頓的運動定律必定會反覆出現。

然而,那些我們習以為常、但是背得要死的運動公式,在原子的世界裡並不適用。像那麼小的物體,我們必須用另一套方法,也就是薛丁格方程式來描述其行為。在量子力學的世界裡,所有物體(粒子)的能量都有同樣的最小單位量。以日常生活熟悉的卡路里為例,如果我們能夠量測出一卡路里的食物,我們就也可以找出兩卡路里的食物有多少;那麼,要量出1.5卡路里應該也不會是問題。甚至,只要儀器夠靈敏,我們應能測出1.44158卡和1.44159卡中間的1.441585卡。但是,量子力學跳出來說No!我們不能無限地分下去;小到一個地步就不能再分了——能量有不可分割的最小單位。一言以蔽之,量子力學講的是極微小物體的物理。

相對論與量子力學,被稱為近代物理學的兩大支柱,大大拓展了物理的疆界,讓我們從處理日常生活範疇的古典物理,更進一步開始有能力研究移動極快的、或者質量極小的物體。以簡單的示意圖表示,大致如下:

你可能會忍不住狐疑、總覺得圖裡右上方有些缺憾。恭喜你!這也是接下來的物理學家嘗試解決的問題—-將相對論與量子力學結合。1928年,物理學家狄拉克(Paul Dirac)修改了薛丁格方程式,使其符合狹義相對論,而導出知名的狄拉克方程式。然而,此方程式仍存在著問題。當我們試著解開方程式時,無可避免會得到以下結論:

其中E代表物體(質量極小的粒子)的能量、m為質量、c是光速,p則稱為動量,我們將其定義為![]() ,裡面的v表示物體的速度。你可以發現,當v是零、物體靜止時,我們會得到耳孰能詳的相對論公式E=mc2 。但問題在,如上式子一定會有一組解為

,裡面的v表示物體的速度。你可以發現,當v是零、物體靜止時,我們會得到耳孰能詳的相對論公式E=mc2 。但問題在,如上式子一定會有一組解為![]() ,能量是負的!

,能量是負的!

負能量代表什麼意思呢?我們並不太清楚。就像腹部的肥肉只有增加的份,永遠不可能沒有、甚至比沒有還少一樣!於是,為了解決負肥肉負能量的問題,「狄拉克海」的概念被提出了。狄拉克假設,能量有正有負,就像地表有山有谷一樣,但是所有負能量的狀態都被粒子填滿了;亦即,我們其實生活在一個所有低於海平面的峽谷都被海水填滿的世界,只看得到海平面以上(也就是能量為正)的粒子。

但是,狄拉克海裡偶爾可能會出現泡泡,就像你在游泳時偷放屁那樣,又因為海平面是不變的,一旦少了負能量粒子去填補這個空洞,我們看上去就會以為是多了個正能量粒子(減掉-1會等於加上+1)—-為了方便,我們把這個少了負能量粒子的空洞稱為「反粒子(antiparticle)」。1932年,安德森(Carl Anderson)從宇宙射線的觀測中發現了「反電子(後來被稱為正子 positron)」的存在,狄拉克方程式的可靠性獲得證實。他們也因此分別得到1933與1936年的諾貝爾獎。然而,因為一些細節上的問題,狄拉克海的詮釋後來漸不再被使用,但反粒子、以及反物質(antimatter,由反粒子組成的物質)的存在卻是毋庸置疑了。

話說從頭,那麼在<新世紀福音戰士>裡,為什麼四號機在啟動機關發生意外後,展開的狄拉克海會讓整個「聯合國直屬特務機關NERV第二支部」及23778平方公里的內華達州消失不見呢?欲知詳情,待下回分解。

- 註:[1] 動畫<新世紀福音戰士(Neon Genesis Evangelion)>的劇情。

參考資料:

- David Griffiths (1987) Introduction to Elementary Particles, 1st edition